Архитектура когнитивных систем и их пластичность

Автор: Павлова А.Д., Гаврилов Д.А., Щелкунов Н.Н.

Журнал: Труды Московского физико-технического института @trudy-mipt

Рубрика: Информатика и управление

Статья в выпуске: 3 (67) т.17, 2025 года.

Бесплатный доступ

Осуществляемый в настоящее время широкомасштабный переход к интеллектуальным и роботизированным техническим системам требует осознания и развития соответствующих технологий проектирования, обеспечивающих этот переход на системной основе. Особое внимание требуют системы, обладающие когнитивными функциями, обеспечивающими обучение и адаптивное поведение на основе опыта в процессе взаимодействия с динамической средой. В данной работе авторы поставили себе цель разобраться со смысловым значением когнитивной системы или когнитивного автомата (когнимат) и рассмотреть их возможные архитектурные конструкции, представляющие структурный скелет и композицию этих систем нового поколения. Отдельный вопрос связан с определением подходящей теоретической основы, обеспечивающей представление архитектуры и свойств когнитивного домена, и микроархитектуры или внутренней организации агентов и когнитивных инструментов, которые являются главными компонентами этого домена. При этом основными требованиями, которые предъявляются к когнитивным системам или когниматам, являются: целенаправленность их поведения (присуща всем системам по определению системы), возможность их саморегуляции и адаптивного поведения на основе опыта, полученного в процессе взаимодействия с динамической средой (самообучение). Третья, решаемая в работе задача, связана с нахождением параллелей между архитектурным обликом когнитивной сферы систем нового поколения (искусственные системы) – с одной стороны, и организацией и работой нервной системы млекопитающих и человека (естественные системы) – с другой. Такие параллели призваны выявить то общее, что объединяет живые и искусственные системы, и могут оказать существенное влияние на развитие взглядов и теоретических оснований, так необходимых для понимания организации и деятельности этих систем.

Архитектура когнитивных систем, когнитивные модели, когнитивный элемент, интеллектуальный агент, обучение с подкреплением, метод «исполнитель-критик», функция ценности, стратегия, функция обучения, функция подкрепления, параметризация функций, нейронные сети, глубокое обучение

Короткий адрес: https://sciup.org/142245839

IDR: 142245839 | УДК: 004.81

Architecture of cognitive systems and their plasticity

The current large-scale transition to intelligent and robotic technical systems necessitates the understanding and development of corresponding design technologies that ensure this shift is implemented systematically. Special attention is required for systems possessing cognitive functions that enable learning and adaptive behavior based on experience gained through interaction with a dynamic environment. In this work, the authors aim to clarify the conceptual meaning of a cognitive system or cognitive automaton (cognimat) and explore their possible architectural designs, which represent the structural framework and composition of these next-generation systems. A separate issue involves defining an appropriate theoretical foundation that provides a representation of the architecture and properties of the cognitive domain, as well as the microarchitecture (or internal organization) of agents and cognitive tools that serve as key components of this domain. The primary requirements for cognitive systems or cognimats include: goal-directed behavior (inherent to all systems by definition), selfregulation and adaptive behavior based on experience acquired through interaction with a dynamic environment (self-learning). The third objective addressed in this work is identifying parallels between the architectural structure of the cognitive sphere in next-generation systems (artificial systems) and the organization and functioning of the nervous systems of mammals and humans (natural systems). Such parallels are intended to reveal commonalities between living and artificial systems, which could significantly influence the development of perspectives and theoretical foundations essential for understanding the organization and operation of these systems.

Текст научной статьи Архитектура когнитивных систем и их пластичность

1. Терминология

Текущий этап цифровой трансформации состоит в широком внедрении технологий искусственного интеллекта в разнообразные технические и информационные системы. Эти технологии являются источником делового превосходства и рыночных конкурентный: преимуществ одних компаний и производств перед другими. Они являются средством построения комфортной и безопасной социальной среды и доверенного взаимодействия предприятий, населения и органами государственной власти между собой.

Одним из результатов текущего этапа цифровой трансформации является появление информационных и технических систем нового поколения, обладающих повышенными когнитивными способностями, в том числе способностью саморегуляции и адаптации к окружающей среде в результате взаимодействия с ней (когнитивные системы).

Для обозначения когнитивных систем предлагается использовать термин «когнимат» (cognimat). Его происхождение связано с сокращением словосочетания когнитивный или познающий автомат. В литературе встречается довольно популярный термин «анимат» (animat): производный от словосочетания автомат-животное. Когнимат имеет более широкое толкование, так как включает в себя возможность охвата когнитивных способностей человека, не подвластных животному миру.

В фантастических произведениях можно встретить также термин «дроид», который аналогичен когнимату. Он, так же как и когнимат, не обязательно человекоподобный, и может не иметь механизмов для перемещения. Можно использовать его, но мы предпочитаем применять предложенный термин, так как он явно указывает на наличие в системе когнитивных способностей.

Термин «когнимат» созвучен с терминами «ког», «когнитом» и т.д., используемыми российским нейрофизиологом, академиком К. В. Анохиным для построения гиперсетевой теории сознания [1].

2. Архитектура когнитивной системы

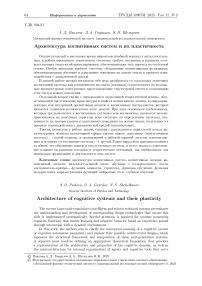

Состав возможных когнитивных способностей искусственных систем огромен и продолжает расширяться. С другой стороны, все когнитивные системы имеют общую характеристику: появление на функциональном архитектурном уровне системы новой функциональной области (рис. 1), который будем называть когнитивным доменом.

Обычные, исполняемые на компьютерах функции - это детерминированные процессы, которые выполняются на основе заранее определенных алгоритмов и очищенных данных. Такие функции выполняют задачу без контекста «понимания» их смысла («осмысления»), В силу детерминированности обычных функций нет необходимости в их представлении на функциональном уровне системы.

Когнитивные функции - это процессы, характерные для человеческого мышления, они связаны с восприятием, анализом, хранением и использованием информации для принятия решений в контексте «осмысления» обстановки. Когнитивные функции работают по принципу адаптации и нелинейной обработки данных, они могут изменяться на основе опыта посредством обучения. Рассмотрение организационных особенностей когнитивных функций, связанных с «осмыслением» и обучением, требует их представления на функциональном уровне в отдельном когнитивном домене.

Рис. 1. Архитектура когнитивной системы

Отличительной особенностью когнитивного домена является то, что он оперирует не с данными, а с метаданными, т.е. с данными о данных. Информация для этого домена поступает в форме векторов (дескрипторов) данных, каждый элемент которых представляет и описывает некоторый признак, свойство данных, или отношения и связи между данными. Когнитивные элементы работают с той частью дескриптора данных, которая имеет смысл (целесообразна) по отношению к цели, решаемой системой. Эти соображения лежат в основе гипотезы об архитектурной параметризации когнитивного домена, суть которой состоит в том, что параметризация данных и функций когнитивного уровня - присущий, а потому обязательный фактор КС.

Программный уровень - это среда исполнения обычного прикладного программного обеспечения. Конечно, с помощью обычного программирования можно решить какие-то задачи по интеллектуальной обработке, но это частные единичные разработки, не носящие системного подхода к архитектуре когнитивного домена.

В своих выводах к работе [1], К. В. Анохин писал: «... мозг в своей максимально нереду-цируемой сущности является когнитивным органом, состоящим из специфических когнитивных элементов, объединенных специфическими когнитивными связями и реализующим специфические когнитивные процессы и взаимодействия обладающего им когнитивного агента - то еств разумом (mind)».

Это означает, что когнитивный домен принципиально отличен от домена программного обеспечения, так как имеет свою оригинальную организацию (архитектуру) цифровой обработки данных, ориентированную на эффективное выполнение когнитивных целенаправленных функций. Да и сами данные имеют трактовку, отличную от данных программного уровня: в процессе обработки система наделяет их особыми смысловыми метками (оценками, «смыслами»). Смыслы фиксируют отношение между данными и окружением с одной стороны и когниматом - с другой, в контексте целенаправленной деятельности. Динамическое окружение также важно для системы, как и сами данные, полученные в этом окружении. Подытожим сказанное.

Во-первых, когнитивный домен - это принципиально объектно-ориентированная среда. В отличие от программ и данных, «живущих» в прикладной программной среде, в когнитивном домене мы оперируем когнитивными объектами, такими как агент, функция ценности, стратегия и другие когнитивные инструменты и объекты. Объекты, процессы и данные в когнитивной среде наполнены смыслами.

Во-вторых, когнитивный домен имеет структурированную архитектуру, элементами которой являются когнитивные объекты. В свою очередь, когнитивные объекты имеют свою внутреннюю структуру и так далее, что соответствует общему принципу системного проектирования. Структуру верхнего уровня можно назвать когнитивным ландшафтом системы, в котором функционируют объекты.

Главным объектом в когнитивном домене является агент. На рисунке 1 в состав системы входит только один когнитивный агент, что уже дает ей право называться когнитивной. В реальной системе когнитивных агентов может быть много (мультиагентная среда).

В-третьих, теоретической основой для построения архитектоники когнитивного домена и когнитивных объектов послужила теория обучения с подкреплением (RL, reinforcement learning), которая является частью машинного обучения (ML, machine learning) - более обширного теоретического направления. Обучение с подкреплением рассматривает принципы организации целенаправленных систем, обучающихся в процессе взаимодействия со средой, что является одним из основных отличительных свойств, характеризующих когнитивные системы. Далее мы будем придерживаться терминологии и обозначений, используемых в RL.

В общем случае когнитивная система (рис. 1) включает:

-

• одного или несколько возможно взаимодействующих друг с другом агентов и другие используемые агентами когнитивные процессы, структуры и механизмы;

-

• прикладное программное обеспечение, которое:

-

— реализует когнитивные объекты и механизмы (носители когнитивных компонентов) ;

-

— реализует детерминированную часть логики работы системы (изделия);

-

— организует связь и оперативное управление с рабочими инструментами (драйверы и управляющие модули);

-

• рабочие инструменты, находящиеся в управлении когнитивной системы: сенсоры, исполнительные устройства и т.д.

Агенты, в свою очередь, состоят из когнитивных элементов, примерами которых являются: функции ценности состояния v(s), действия q(s,a) и стратегии поведения 7г(а|Д. Функции ценности образуют систему ценностей агента, которая является основой для ориентирования агента в окружении. Стратегии служат для принятия решений и поведения агента в зависимости от ценностной ситуации окружения. Ценность - одно из основных понятий когнитивной системы, позволяющая определить отношение текущей ситуации к решаемой системой задаче, то есть «смысл» происходящего.

Когнитивная система взаимодействует с внешней средой и, на основе полученного опыта, обучается выполнять свои функции все лучше и эффективнее. Управление взаимодействием с внешней средой и обучение возлагается на агентов, когнитивные структуры и механизмы когнитивного уровня. Все программы и инструменты нижележащих уровней образуют тело когнитивной системы, находящееся под полным контролем и управлением со стороны объектов когнитивного уровня. Программное обеспечение можно трактовать как «мягкая» часть тела. Когнитивный уровень контролирует внутреннее состояние и выполняет функцию управления телом, которое следует рассматривать как внутреннюю среду системы. Вместе с внешней средой она образуют среду когнитивной системы (окружение), которая контролируется подсистемами когнитивного домена.

Окружающая среда агента состоит из внутренней среды (программное и аппаратное обеспечение, включая тело самого агента и других когнитивных структур) и внешней среды когнитивной системы (окружение системы). Следуя логике К. В. Анохина [1], когнитивный домен системы выполняет ту же роль, что и когнитом мозга.

Агент, как когнитивная функция - это бестелесная сущность. Вместе с этим агент как реальный объект должен быть реализован в той или иной форме (носитель или тело агента), будь то выполняемая на компьютере программа, или интегральная программируемая логическая схема. На рисунке выше предполагается программная реализация агента.

В такой постановке среда когнитивной системы (как внутренняя, так и внешняя) является средой для любого агента когнитивной системы. Так как носители когнитивных компонентов (тела) находятся на программном уровне, являющемся средой агента, их внутренние состояния могут быть контролируемы и управляемы со стороны агентов как когнитивных функций, если это предусмотрено архитектурой когнитивной среды. Любой агент может контролировать и свое собственное внутреннее состояние (самоконтроль). Возможность контроля над своим внутренним состоянием является основой для выделения себя из внешнего окружения.

Теория обучения с подкреплением рассматривает агентов как когнитивные функции (бестелесные сущности), предполагая, что их тела включены в состав среды, с которой агент взаимодействует.

Будем считать, что телесная часть (носитель) когнитивных объектов находится в программной среде. А в когнитивном домене находится его когнитивная компонента, которая бестелесна. Этот взгляд аналогичен тому, как может быть интерпретирована компьютерная программа: с одной стороны, это математическая или логическая функция (функциональный уровень), с другой - это программный код, который требует размещения в физической памяти и исполнения на реальном процессоре (программно-аппаратный уровень). Напомним, что в отличие от детерминированной функции программы, когнитивная функция и ее данные несут смысловую нагрузку, которая формируется самой когнитивной системой в процессах оценивания и обучения. Эти смыслы означают, какое отношение они имеют к целенаправленному поведению агента, а значит, и к самой системе в целом.

Следует заметить, что данные в информационных системах также наделяются некоторыми метками, называемыми значениями, но эти значения формирует программист и «держит» их в своей голове. Следует заметить, что понятие термина «значение» отличается от понятия термина «смысл», который несёт личностный характер. В отличие от этого когнитивные объекты формируют смыслы, и формируют они их сами, а иногда эти смыслы непонятны и скрыты от проектировщиков.

Объект, который как целое одновременно имеет два представления, находящихся в разных понятийных пространствах, называют дуальным, двойным или, просто дуалом. С этой точки зрения, и программы, и агенты являются дуалами.

Важность дуалов состоит в организации стыка (перехода) между разными уровнями и концепциями их рассмотрения. Если программа организует переход от аппаратного уровня к программному уровню, то когнитивные элементы - от программного уровня к когнитивному домену функционального уровня.

Мы используем термин «когнитивный», который не следует приравнивать к термину «ментальный». Последний имеет более широкий смысл, чем «когнитивный» и включает его как частный случай.

Если «когнитивность» связана с разумностью обработки, то «ментальность» включает в себя также множество психических процессов, протекающих в мозге млекопитающих. О переходе от когнитивных систем к ментальным системам говорить рано, хотя уже существуют предпосылки, формирующие возможность этого перехода. В любом случае этот переход связан с наделением когнитивных систем инструментами и способностями чувственного осмысления данных.

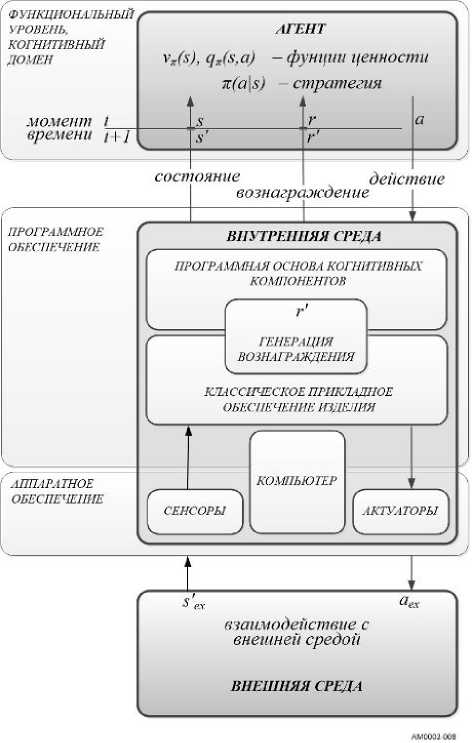

3. Общий алгоритм работы агента

Агент (рис. 2) непрерывно в циклической форме взаимодействует с окружающей средой (окружение), обучается и принимает решения на основе своего опыта и реакции среды. Роль окружающей среды агента выполняет всё, что лежит вне агента на программном и аппаратном уровнях и вне системы и в той или иной степени подконтрольно ему.

Рис. 2. Временная диаграмма циклической работы агента

Агент циклически взаимодействует со средой, используя три типа сигналов: состояние s, вознаграждение г и действие а. Агент выбирает действия, а окружающая его среда, как внутренняя, так и внешняя, прямо или опосредованно реагирует на них, предлагая агенту новые ситуации и состояния, которые возможно сопровождаются выраженными в числовых значениях вознаграждениями г. Набор возможных действий агента зависит от состо- яния: a G A(s~). Агент оценивает полученную в резулвтате последнего действия ситуацию, обновляет свои функции ценности и стратегию поведения и толвко затем осуществляет выбор последующего действия, стремясв максимизировать общее ожидаемое вознаграждение (доход), с учетом обесценивания отдаленных вознаграждений, планируемое получить в будущем:

∞

Gt = rt+i + 7 • rt+2 + 72 • tt+3 +----= ^7 k • rt+k+1, (1)

k=0

где 7 G [0,1) - коэффициент обесценивания определяет ценность будущих вознаграждений с текущей точки зрения. Вознаграждения обычно формируются внутренней средой когнитивной системы, как ответная реакция на внутреннее представление состояния s окружающей среды агента.

Для циклического взаимодействия агента со средой, примем следующее соглашение. Пусть надстрочный символ «‘» обозначает шаг t + 1, следующий за шагом t. Сим вол «‘‘» обозначает шаг t + 2 и т.д. Будем считать, что отчет шагов в обратном направлении (назад по времени) обозначается тем же надстрочным символом, но со знаком «минус» перед ним, например: надстрочный символ «-‘» отсылает к шагу t — 1.

В интересующем нас случае непрерывной работы когнитивной системы агент, как правило, берет во внимание (учитывает) только сигналы, недалеко отстоящие от текущего шага взаимодействия (близорукий агент), будь то прогнозирование вперед, или учет уже полученного опыта через заглядывание назад. В такой ситуации относительная система обозначения шага, к которому относится сигнал, более компактна. При необходимости будем использовать обычную нотацию с явным указанием номера шага в подстрочной позиции.

Предполагается, что среда находится в некотором текущем (или стартовом) состоянии s {st). Агент генерирует текущее (или стартовое) действие a (а^, тем самым завершая текущий (или стартовый) цикл (шаг) работы t и переходит к следующему шагу t +1 (красная вертикальная линия обозначает начало нового цикла). Новый шаг начинается с наблюдения за реакцией среды (1 - Восприятие s’ и г’). Среда реагирует на действие агента а переходом из текущего состояния s (st) в следующее состояние s’ (st+1) и формированием сопровождающего переход вознаграждения г’ (rt+1):

а : s —7 s'. (2)

Агент производит оценку ценности нового состояния v(s') (2 - Оценка s') или ценности действия q(s',a) и обрабатывает вознаграждение г', формируя внутренний сигнал подкрепления 5 (3 - Обработка г'). По результатам этой обработки, а также других расчетных действий осуществляет обновление (обучение) функций v'(s), q'(s,a) и стратегии 7r'(a|s) для состояния s или пары (s,a) (4 - Обновление v, q, л). И, наконец, используя обновлённую стратегию л', выбирает но вое действие a' ~ л'(a|s') (5 - Выбор a'). Для эпизодического случая цикл повторяется, пока не будет достигнуто конечное состояние sp.

Внутри агента также изображена структурная диаграмма, иллюстрирующая последовательность работы агента. Дуговая стрелка вверх указывает на возможное использование целевой стратегии л(a|s) для выбор а действия a ~ л(a|s), используемого при формировании функции ценности действия q(s,a) (например, при Q-обучении или SARSA [2,3]). Дуговая стрелка вниз указывает на использование поведенческой стратегии лe(a|s) для выбора действия a ~ лe(a|s), воздействующего на окружение агента (использование). Если целевая и поведенческая стратегии совпадают, то мы имеем случай агента с единой стратегией, в противном случае - с раздельной стратегией. Подстрочный символ Е при поведенческой стратегии указывает на необходимость ее смягчения, например, с помощью механизма Е-жадности, что позволяет случайным образом выбирать нежадные действия с целью исследования окружения.

4. Параметризация данных и аппроксимация функций

За почти столетний период развития теории обучения с подкреплением RL разработано множество различных методов когнитивной обработки данных, используемых для реализации целенаправленных и самообучающихся агентов. Их анализ и классификация требует больших усилий и времени, а их описание - не одну статью. И работа в этом направлении постоянно ведётся [2-4].

Прежде чем перейти к основному, интересующему нас RL-методу, несколько слов о важности параметризации и аппроксимации функций для обучения с подкреплением. Как правило, функции ценности и стратегии сложны, то есть их не удается выразить аналитическими формулами. Поэтому до конца 1980-х специалисты работали в основном с табличным представлением функций, когда обучение функций производилось прямым изменением её значений в соответствующих ячейках таблицы, адресуемых s и а. Переход к задачам с большим числом состояний, а также к задачам с непрерывными наблюдениями, потребовали нового подхода к представлению функций, которым стала технология параметризации и аппроксимации.

Согласно этой технологии исходные функции v(s), q(s,a) и 7r(a|s) подлежат замене на более простые и допускающие параметризацию функции v(s, w), q(s,a, w) и ^(a|s, 0) соответственно, которые могут лишь приближенно соответствовать исходным функциям. При этом параметры w и 0 являются вещественными векторами размерности dw и dd соответственно:

r(x(s), w), x еН^, w еП^, (3) q(x(s),a, w), x е Щу w е П^,а е A(x(s)) (4)

%(a|x(s)), x ЕН^ ,9 ЕПМ . (5)

Задача обучения состоит в нахождении таких значений векторов w и 0, чтобы как можно более точно приблизить параметризованные функции к оптимальным. В этом случае мы теряем в точности вычисления значений параметризованных функции, но теперь вместо хранения огромных таблиц, нам необходимо хранить только векторы параметров w и 0.

Состояние окружения s может быть чем угодно, в задаче обработки изображения (техническое зрение) это отдельный видеокадр, в задаче звуковой обработки - спектрограмма за короткий промежуток времени и т.д. Не вся содержащаяся во входном сигнале информация важна для агента. Обычно она подвергается предварительной обработке с выделением существенных для агента вектором признаков x = x(s), x е Hdx. Полученный после такой обработки вектор признаков размерности dx поступает агенту на дальнейшую обработку. По сути, агент оперирует не состояниями, а их представлениями.

Представление состояния среды вектором признаков x(s) объединяет множество похожих друг на друга состояний Si в одно агрегированное состояние s*. Это множество состояний Si имеет одно и то же внутреннее представление x(s*) и для агента состояния Si становятся неразличимы между собой, что уменьшает количество подлежащих анализу вариантов представлений. Изменение ценности любого состояния из множества Si неизменно влечёт изменение ценности всех других состояний этого множества, даже если агент его не посещал. Агент, принимая для обработки представление x(s*), оперирует множествами схожих состояний одновременно.

Выбираемое исполнителем действие а также может иметь внутрисистемное векторное представление у е Hdy, элементы которого yi являются отдельными признаками действия а (например: выполняемая операция, адресация элементов системы и т.д.). Этот вектор можно интерпретировать как отдельную команду, генерируемую исполнителем, тогда как само действие выполняется исполнительными элементами системы, находящимися на более низком архитектурном уровне в моторном тракте.

Признаки yi несут смысловое содержание действия. В целом, векторное представление действия у кодирует и координирует параллелвное и согласованное функционирование от-делвнв1х, прежде всего исполнительных, но не только, элементов системы, организуя их для эффективной и целенаправленной общесистемной деятельности по достижению цели. Параметризация действия дает возможность закодировать большое множество возможных действий небольшим количеством кодирующих признаков. Последовательность закодированных векторов у, у’, у’’, ... может быть интерпретирована как программа. Процесс обучения исполнителя рассматривается как формирование программы. Декомпозицию вектора признаков (команду) есть смысл делать до момента, когда каждый признак y i будет сам являться некоторой независимой микрокомандой для определённого исполнительного программно- аппаратного уз л а.

5. Метод «исполнитель — критик»

Среди разнообразия различных RL-методов особый интерес для нас представляет семейство алгоритмов, называемых методом «исполнитель - критик».

В 1983 году Саттон, Барто и Андерсон [5] предложили использовать подкрепляющий сигнал 6, формируемый обученной функцией ценности r(x, w), впоследствии названной критиком, для передачи в другую часть системы, представляющую стратегию 7r(a|x, 0) и названную исполнителем. Сигнал 6 усиливал эффективность обучения стратегией по сравнению с её обучением прямыми методами, например по методу градиента стратегии [3].

Метод «исполнитель-критик» (ИК) допускает различные частные алгоритмы построения исполнителя и критика, которые хорошо дополняют друг друга, обеспечивая эффективное выполнение возложенных на них функций. Критик должен качественно оценивать текущее состояние среды, как результат уже совершенных и прогнозируемых агентом действий, а также вырабатывать управляющий сигнал 6, необходимый как для обучения собственной функции ценности, так и для коррекции стратегии исполнителя. Исполнитель должен обоснованно производить выбор действий и формировать свои внутренние управляющие сигналы для прямой коррекции стратегии. На обе компоненты в равной мере распространяется функция корректировки и обучения своих алгоритмов (функция обучения) в зависимости от своих внутренних управляющих сигналов и общего управляющего сигнала 6, формируемого критиком.

Параметризация - необходимый шаг для нейросетевой реализации КС, когда векторные параметры w и 0 описывают силу синаптической связи нейронов в блоках, образующих критика и исполнителя. Вектор x = x (s) - это внутреннее представление состояния среды s в форме набора признаков.

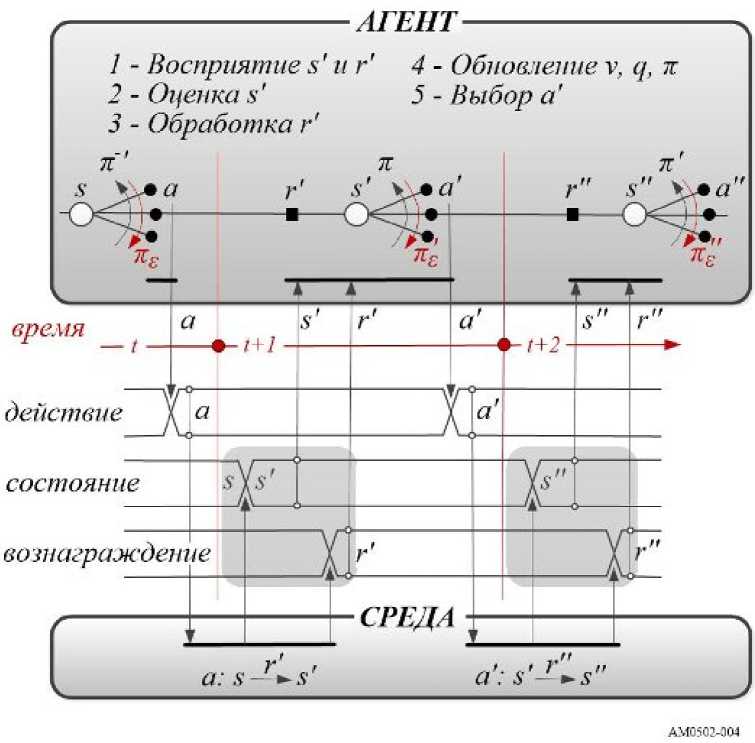

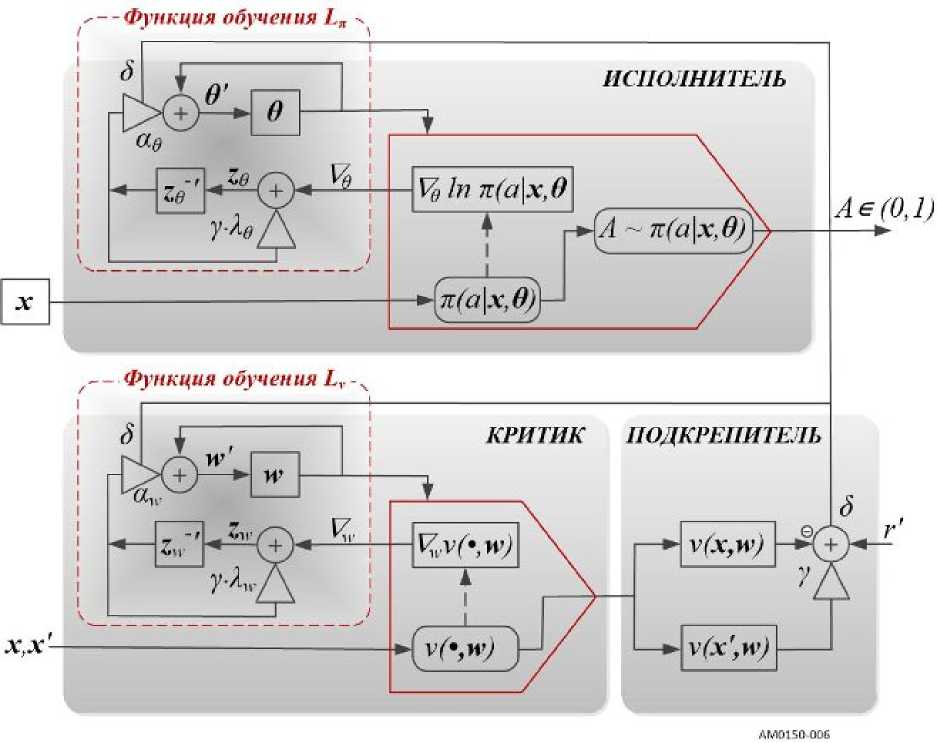

Предлагаемый нами вариант модифицированной архитектуры «исполнитель - критик» представлен на рис. 3. Отличительной особенностью данного варианта архитектуры ИК является выделение блока подкрепления, который обычно включают в состав критика. Выделение функции подкрепления в отдельный блок указывает на его особую роль. Эта роль состоит в формировании управляющего сигнала подкрепления 6, в нашем случае зависящего от значения функции ценности V ( x , w ), вознаграждения г’ и обесцененного сигнала цели у • G(x').

Цель G(x') в блоке подкрепления может формироваться разными способами, и привлекать для этого различные когнитивные элементы. В нашем случае в качестве цели использовано прогнозируемое значение функции ценности состояния V(x‘, w) для нового состояния x‘ = x(s’) с использованием еще не обученной на данном шаге функции ценности, на рисунке 3 показано пунктиром.

G(x) = V(x, w). (6)

Это широко используемый простейший вариант формирования цели методом временной разницы TD(0) (temporal-difference), обладающий ясностью и простотой реализации.

Рис. 3. Модифицированная архитектура метода «исполнитель - критик» с параметризацией

Разбиение критика на два блока требует введения новых имен для этих блоков. Этими именами могли бы быть оценщик и подкрепитель. Наверное, это не корректно, но мы пока сохраним для одного из них название критик. В работе мы будем использовать именно такой вариант архитектуры метода «исполнитель - критик». Исполнитель обучается стратегии действий, которые максимизируют общий ожидаемый доход (1), что приводит к увеличению сигнала подкрепления 6. Критик обучается точности оценки состояния, стремясь уменьшить сигнал подкрепления 6.

Существует гипотеза, что нечто подобное структуре ИК встроено в мозг человека [6]. Область мозга, занимающаяся обработкой сенсорной информации и формированием эмоционального ощущения, расположена в вентральной части стриатума (выделено розовыми полосками). Функционирование этой области очень похоже на то, чем занимается критик. Другая область мозга, которая в основном занята выбором действий, сконцентрирована в дорсальной части стриатума (обозначено голубыми полосками), деятельность этой области аналогична функциональности исполнителя. Считают, что дорсомедиальный стриатум (ДМС) отвечает за целеустремлённое поведение, тогда как дорсолатеральный стриатум (ДЛС) регулирует привычное поведение. Основным нейромедиатором в стриатуме является глутамат (Glu), играющий важную роль в таких когнитивных функциях, как запоминание и обучение [6].

Средние шипиковые нейроны этих структур дополнительно получают на свой вход дофамин (DF) [7], выполняющий роль нейромодулятора, который существенно влияет на функционирование этих нейронов. Источником дофамина являются: компактная часть чёрного вещества (SNpc) и вентральная области покрышки (VTA), расположенные в среднем мозге (выделены серым цветом). Дофамин связывают с сигналом подкрепления 6, что объясняет его существенную роль в обучении. Морфология этих областей сильно отличается от строения нейронных сетей полосатого тела. Это обстоятельство стало причиной для выделения подструктуры формирования ошибки подкрепления из состава критика и образования блока подкрепления, связанного с ядрами среднего мозга.

6. Правила обучения исполнителя и критика

Набор правил обучения для параметризованного метода «исполнитель - критик» для непрерывных задач с бутстрэппингом и следами приемлемости, представлен ниже [2]. Критик использует полуградиентный метод (его градиент не учитывает влияния вектора обучаемых параметров w на целевую функцию G(x') = К(x‘, w)), а исполнитель -настоящий стохастический градиент стратегии (рис. 4). Обучение состоит в пошаговом приближении векторных параметров w и 0 к оптимальным значениям.

8 = г' + у • v(x', w) — v(x, w);(7)

Zw = у • Aw • Zw' + Vwv(x, w);(8)

w' = w + aw • 8 • zw;(9)

ze = 7 • Ae • z—' + Velwv(a, x, 0);(10)

0' = 0 + ae • 8 • ze.(11)

Гиперпараметры: у G [0,1) - коэффициент обесценивания (1), aw, aw G (0,1) - размеры шагов обучения, Aw, Ae G [0,1] - коэффициенты затухания следа приемлемости для критика и исполнителя соответственно.

Система правил (7 - 11) описывает пластичность предлагаемой модели ИК. Правило (7) раскрывает работу подкрепителя. Оно обеспечивает связность между отдельными блоками исполнителя и критика, образуя когнитивный блок КС более высокого порядка. Правила (8, 9) определяют функцию обучения Lv (8, w, zw) критика, а правила (10, 11) - функцию обучения L^ (8, 0, ze ) исполнителя. Правила (8, 10) представляют затухающие следы приемлемости критика zw, dzw = dw и исполнителя ze, dze = de- Следы приемлемости запоминают прошлый опыт, в качестве которого выступают затухающие градиенты ценности Vwv(x, w) или градиенты логарифма стратегии Veln?r(a|x, 0). Правила (9, 11) - это итоговые пошаговые обновления векторов w и 0, параметризующих критика и исполнителя соответственно.

Затухание следов приемлемости zw и ze осуществляется за с чет коэффициентов у и A. Произведение коэффициентов учитывает затухание значения отдельных составляющих следа в n-шаговых итерациях за счет их удаления от текущего момента назад в прошлое, так как их значимость в настоящем падает. В практике можно использовать составной коэффициент A# = у • A, но в теоретических работах их явное указание желательно, так как они учитывают разные обстоятельства затухания.

Следы приемлемости запоминают прошлый опыт, в качестве которого выступают градиенты самой функции Vwv(x, w) или логарифма стратегии Ve lmv(alx, 0 ), что обусловлено использованием стохастического градиента спуска. Градиенты могут быть как положительными, так и отрицательными, что отражает их вклад в следы приемлемости как в сторону их увеличения, так и в сторону их убывания.

В работе используется структурно-функциональная форма представления моделей. Такое представление более содержательно, чем символьная форма, так как позволяет наглядно отследить обратные связи, возможные задержки и их влияние на логику работы и структуру модели в целом. Более того, такая форма приближает нас к нейросетевой реализации, к которой мы стремимся, дает возможность более адекватно сопоставить модель с функциональностью мозга млекопитающих. Последний функционирует как алгоритмический механизм, который принимает и обрабатывает входную информацию, как непрерывный поток данных.

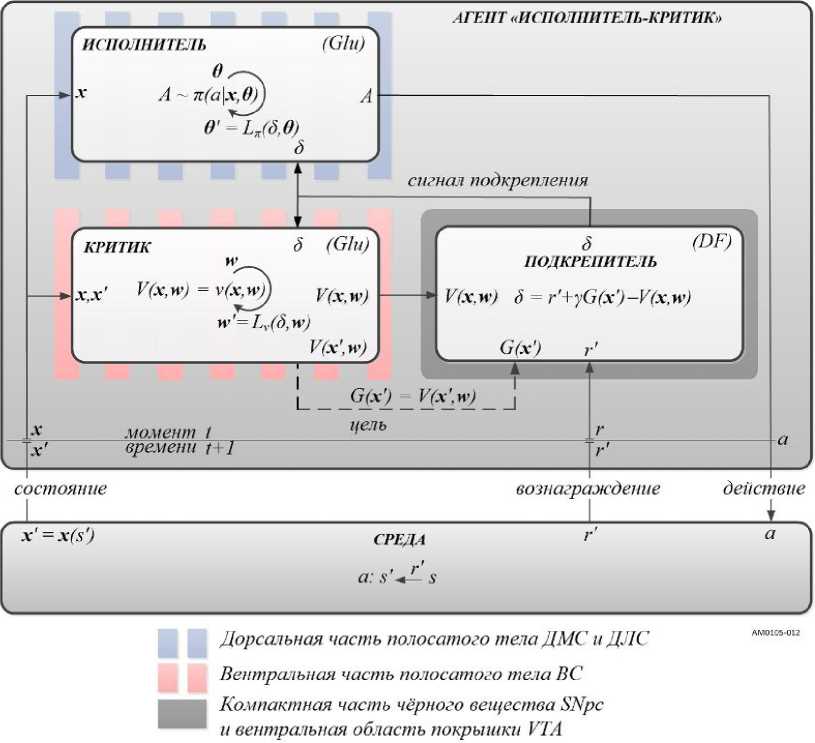

Рис. 4. Общая структурно-функциональная схема ИК-модели

Функции обновления L„ и Щ по отношению к обучаемым блокам носят локальный характер. Они гипотетически моделируют сложные внутриклеточные биохимические процессы, происходящие в нейронных сетях живых систем.

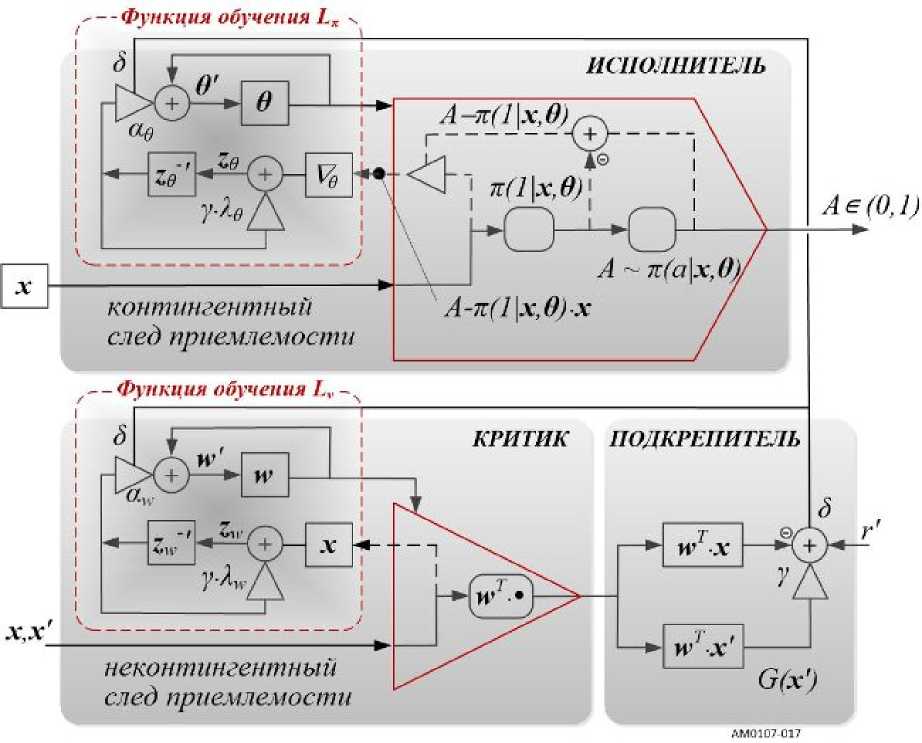

7. Модель в линейном приближении

Предположим, что формируемая критиком параметризованная функция ценности v(x, w) является линейным приближением от входного вектора x с весами w : v(x, w ) = wT • x. то есть представляет собой взвешенную сумму признаков х. скалярное произведение или свёртку. Надстрочный знак «Т» означает операцию транспонирования. Соответственно v(x‘,w) = wT • х ‘ и градиент по параметру w : Vw v(x, w ) = x, определяется входным векторным сигналом х, который является вектором внутреннего представления состояния среды x(s). Теперь правило (8) имеет вид

Z w = 7 • Аш • z w‘ + х . (12)

Так как внутреннее представление формируется входной первичной сенсорной сетью, сигнал x аналогичен пресинаптической активности, а вектор w - синаптической силе связи нейроподобного блока критика.

Пусть исполнитель состоит из набора параллельно функционирующих нейроподобных блоков {Aj }, каждый из которых формирует выходной бинарный сигнал Aj, соответствующий одному из действий множества 4(x(s)). В качестве нейроподобного блока тт( Aj|х, Oj ) с действием Aj = 0 или 1 используем хорошо известный блок Бернулли [2], генерирующий бинарный сигнал Aj с вероятностью:

Aj = 1 : 7r(1|x, Oj ) = 1 — 7r(0|x, Oj ) =

1 + е^ •x ’

В линейном случае скалярное произведение OjT • x на входе блока Бернулли (13) определяет вероятноств его срабатв1вания (генерация Aj) согласно логистической (сигмоидальной) функции [3]. Градиент логистической функции Velmr(Aj|x, Oj) = (Aj-л(1|х, Oj)) • x и правило (10) преобразуется к виду ze = 7 • Ae • z/ + (Aj — тт(1|х, Oj)) • x.

Структурно-функциональная схема ИК-модели в линейном приближении имеет вид

Рис. 5. Детализированная З-блочпая модель с блоком Бернулли в линейном приближении

Здесь исполнитель изображен в форме одного блока Бернулли с опусканием индекса j. Детализированная модель работает по обновленным правилам обучения:

8 = г' + 7 • (wT • x‘) — (wT • x);(15)

zw = 7 • Aw • zw' + x;(16)

w' = w + aw • 8 • Zw;(17)

ze = 7 • Ae • ze' + (Aj — tt(1|x, Oj)) • x;(18)

O' = O + ae • 8 • ze.(19)

Правило (18) раскрывает влияние выходного состояния блока Aj на след приемлемости. При условии Aj = 1 множите ль перед х равен 1-7r(1|x, Oj ) и всегда положителен. В результате след приемлемости исполнителя получает приращение, равное ослабленному сигналу

7r(0|x, Oj ) • x. При Aj = 0 множитель при х равен 0-л(1|х, Oj ) и всегда отрицателен, что приводит к вычитанию ослабленного приращения л(1|ж, Oj ) • x следа (18). В правилах обучения следа критика (16) такого влияния нет. По этой причине след приемлемости исполнителя называется контингентным, а след критика - неконтингентным следом приемлемости, (см. рис. 5).

Критик представляет сенсорную часть КС, исполнитель - моторную, а подкрепитель - ассоциативную компоненту КС. Схема на рисунке 5 раскрывает активно обсуждаемые в научной среде гипотетические механизмы 2- и 3-факторной пластичности [8-10]. Алгоритмы Lv и Щ лежат в основе 2-факторной модели пластичности нейронной сети (правило Дональда Хебба 1949 г. [8]), которая учитывает только предсинаптическую (первый фактор) и постсинаптическую (второй фактор) активность синапса. В нашем случае эти факторы скрыты в градиенте (12) и (14), так как только при взаимной активности возникает не нулевой градиент. Сигнал 6 является третьим фактором в 3-факторной модели пластичности [9].

В работе [10] приведен обзор по возможным моделям синаптической пластичности в корковых нейронных сетях млекопитающих, констатирована важность связи нейрофизиологии с RL-теорией, обоснованы пути использования глубоких нейронных сетей DNN: «Хотя многие процессы, определяющие синаптическую пластичность, ещё предстоит изучить, обнадеживает тот факт, что мы достигли стадии, на которой знания из области молекулярной, клеточной и системной нейробиологии, а также теории обучения с подкреплением и глубоких искусственных нейронных сетей дополняют друг друга и теперь могут быть интегрированы в единую систему обучения в мозге».

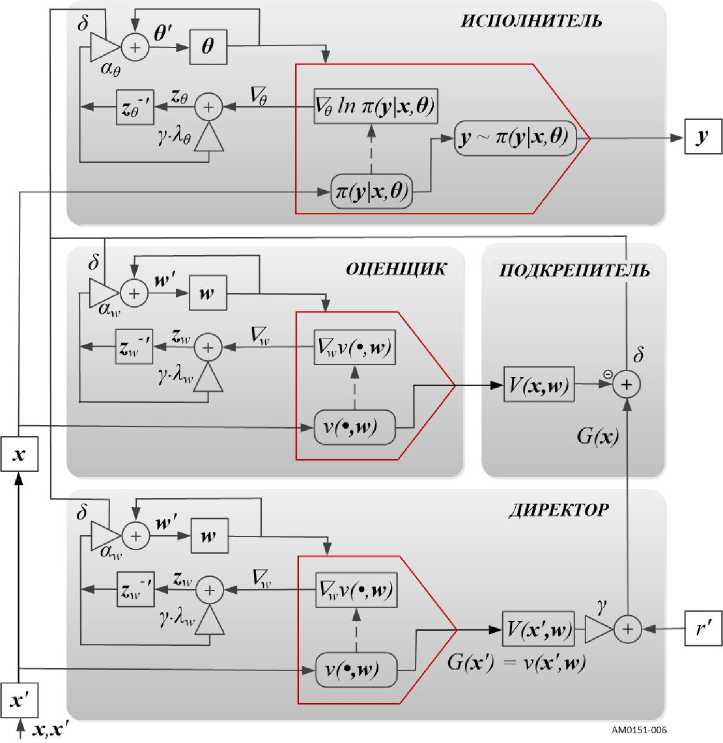

8. Обобщение архитектуры ИК

В модели (рис. 5) на блок критика падает удвоенная вычислительная нагрузка, что может снизить скорость обработки сигнала. Критик используется не только для оценки ценность текущего состояния v(x, w ), но и для формирования прогноза ценности нового состояния v(x', w ), которое, в нашем случае, служит в качестве цели G(x' ). Если функцию формирования цели G(x’) возложить на новый блок, работающий параллельно критику, то часть нагрузки он возьмет на себя. На рисунке б представлена 4х блочная модель ИК с потоковой обработкой сигнала х. Для сохранения общности мы вернулись к модели, работающей по общим правилам (7) - (11).

Модель образует полную и самодостаточную функциональную систему, для определения которой необходимы четыре составляющие: оценщик текущего состояния, директор, подкрепитель и исполнитель. Директор - новый элемент модели формирует оценку последнего состояния х‘ с учётом полученного на этом шаге вознаграждения г’, возможно, с учетом последнего выполненного действия A. Алгоритм работы директора может отличаться от алгоритма работы оценщика, его функция состоит в оценке направления движения к цели. Вместе с этим, алгоритм семантически должен быть согласован с работой оценщика, то есть, функция ценности оценщика и целевая функция директора семантически должны быть близки.

Предугадывается возможность перехода от функции ценности v(x, w ) к системе функций ценностей, состоящей из взаимоувязанного и согласованного набора функций Vi(x, w ), вычисляемых по разным правилам и образующих систему нейроподобных блоков оценки текущего состояния с разных точек зрения. Вектор v = (щ,и2,...) на выходе системы ценностей формирует поле внутреннего для КС эмоционального напряжения. Значение (состояние) этого напряжения зависит от текущего состояния внутренней и внешней среды КС. Оно определяет потенциально возможное направление и мотивационную силу поведения системы. Эмоционально схожие напряжения имеют близкие векторы, в качестве меры близости может быть часто используемая в эмбеддинге метрика косинусного сходства.

Ранее уже говорилось, что выбираемое исполнителем действие а также может иметь внутрисистемное векторное представление у, элементы которого yi являются отдельными признаками действия а() и несут его смысловое содержание. Выбор векторного представления, актуалБного для данной задачи, осуществляется путем обучения. Работа подкрепителя никак не зависит от типа решаемой задачи. Важно, чтобы на вход подкрепителя поступали от оценщика и директора актуальные оценки, которые согласованы между собой на достижение одной и той же цели. Когнитивный блок директора во многом функционирует аналогично оценщику. Отличие состоит в обработке вознаграждений, которые также должны соответствовать достигаемой в текущий момент цели. Выбор и согласование работы четырех базовых блоков между собой может быть возложено на отдельную метамодель ИК, которая функционирует в среде состояний системы ценностей и принимает решение о формировании конкретной цели, соответствующих ей оценках, вознаграждениях и актуализирует связи между ними.

Рис. 6. Обобщенная архитектура метода «исполнитель - критик»

9. Выводы

Машинное обучение ML и, в частности, обучение с подкреплением RL - теоретическая основа когнитивных систем. Модель «исполнитель - критик» - одна из центральных идей обучения с подкреплением RL, самостоятельное и самодостаточное решение, интеллектуальный движок КС. Выступает в качестве системообразующего фактора, интегрирующего и синхронизирующего согласованную и целенаправленную работу отдельных когнитивных элементов (когов) системы. Может быть использована в качестве отдельного когнитивного элемента (кога) для построения более сложных интеллектуальных моделей.

Представление данных в формате векторов признаков и параметризация функциональных блоков когнитивного домена - обязательный фактор КС. Такое представление полно- стью соответствует гипотезе архитектурной параметризации когнитивной системы.

Раскрв1тв1 возможнв1е правила обучения модели. Правила включают как локальные внутри блочные обратные связи, так и глобальные между отдельными блоками циклы, образующие целостную непрерывно взаимодействующую с внешней средой интеллектуальную целенаправленную систему. Раскрыты гипотетические модели контингентных и неконтингентных следов приемлемости. Предложенная в работе 4-блочная модель ИК обобщает архитектуру модели, раскрывает её потенциал и возможные пути развития.

Рассматриваемая в работе архитектура КС и алгоритмы внутриблочной обработки составляющих её когнитивных элементов имеют большое сходство с архитектоникой головного мозга и организацией нейрофизиологических процессов в мозге живых существ (естественные системы). Этот удивительный факт открывает большие возможности для дальнейшего изучения как архитектуры и микроархитектуры когнитивных систем с одной стороны, так и организации когнитивных процессов животных - с другой. Успехи одной из сторон могут оказать огромное влияние на развитие другой в части понимания как структуры когнитивного домена, так и заложенных в него когнитивных механизмов и протекающих в нем когнитивных процессов.

Задача оценки и предсказания критика аналогична задаче павловского или классического обусловливания, формирующей предсказательные казуальные связи между признаками, предвосхищающими возникновение важных событий. Задача управления исполнителя аналогична задаче инструментального или оперантного обусловливания, которое формирует целевое поведение, ведущее к увеличению вознаграждения.

Теория RL хорошо сочетается с учением физиолога Н.П. Павлова о рефлексах, с теорией функциональных систем физиолога П. К. Анохина и разрабатываемой нейробиологом К. В. Анохиным теорией сознания [1]. Она служит математической основой для становления новой дисциплины - вычислительной нейрофизиологии, разрабатывающей математические модели нейронных структур мозга и его пластичности.