Концептуальная модель агентов искусственного интеллекта для управления системами связи с подвижными объектами

Автор: Гребешков А.Ю.

Журнал: Инфокоммуникационные технологии @ikt-psuti

Рубрика: Новые информационные технологии

Статья в выпуске: 1 (89) т.23, 2025 года.

Бесплатный доступ

В статье рассматривается проблема применения искусственного интеллекта для организации управления системами связи с подвижными объектами. Предложено решение по применению агентов искусственного интеллекта, которые взаимодействуют с окружением в виде систем подвижной связи с учетом контекста управления и автономности маневренных объектов. Новизна предлагаемого подхода заключается в применении семантики для выражения смыслового содержания команд и контекста управления, что позволяет использовать различные способы коммуникации между агентами с помощью семантической сети и в перспективе применять как языковые модели, так и голосовое управление подвижными объектами с генерацией новых команд на основе машинного обучения. Проведено исследование и определена концептуальная модель агентов искусственного интеллекта для управления, отличающаяся использованием двухуровневой иерархической схемы агентов с разными системными ролями в контексте взаимодействия с окружением и использованием сценарного подхода для управления знаниями. Рассмотрены имеющиеся аналоги агентов искусственного интеллекта, обозначены их отличия по сравнению с предлагаемой концептуальной моделью. Разработана классификация агентов искусственного интеллекта для управления системами связи с подвижными объектами с точки зрения их свойств и коммуникации с окружением. Приведен пример разработанных запросов прикладного сценария использования знаний и результатов при обращении агентов искусственного интеллекта к системе управления знаниями по обслуживанию и применению телекоммуникаций. Использование предлагаемой модели позволяет перейти к управлению на основе знаний с использованием агентов искусственного интеллекта.

Агент искусственного интеллекта, контекст управления, подвижный объект, прикладной сценарий использования знаний, семантическая сеть

Короткий адрес: https://sciup.org/140312333

IDR: 140312333 | УДК: 004.823:654.1 | DOI: 10.18469/ikt.2025.23.1.11

Conceptual model of artificial intelligence agents for controlling mobile object communication systems

The present article is concerned with implementing artificial intelligence agents in order to control mobile object communication systems. The fundamental premise is that artificial intelligence agents interact with their environment through semantic communications and possess semantics-based structures within a dedicated context of mobile network management. Semantics is discussed as the most general formalism for describing management as a process of observation and decisionmaking with an agent-based action. The novelty of the proposed approach is determined by the use of semantics to express the semantic content of control commands, which allows to use different ways of communication between agents with the help of a semantic network and to apply both large language models and voice control of a mobile object with the generation of new commands on the basis of machine learning in future. The present study hypothesizes that a semantic and context-based management approach is optimal for artificial intelligence agents in applied mobile telecommunications management scenarios. The conceptual model of artificial intelligence agents for management that emerges from this hypothesis encompasses roles within the context of management tasks and interfaces for context-dependent interaction with the knowledge management system or other agents. The conceptual model of artificial intelligence agents for management is defined, characterized by the use of a two-level hierarchical model of agents with different system roles in the context of management tasks, taking into account the interaction with the knowledge management system within the framework of the scenario. Machine learning methods are regarded as external to artificial intelligence agents. The classification of artificial intelligence agents for mobile telecommunication systems management encompasses reflection agents, self-learning agents, and goal-oriented agents. The special section includes an example of the agents’ queries for the applied scenario of telecommunication management knowledge and format of resulting information.

Текст научной статьи Концептуальная модель агентов искусственного интеллекта для управления системами связи с подвижными объектами

На сегодняшний день методы и технологии искусственного интеллекта (ИИ, AI, Artificial Intelligence), включая машинное обучение (MO, ML, Machine Learning), используются повсеместно в большом количестве цифровых экосистем, в распределенных вычислительных системах («облачные» вычисления), в программно-определяемых системах связи [1]. С учетом опыта построения систем автономных подвижных объектов [2] объективно возникает задача повышения интеллектуальности управления путем применения современных технологий ИИ с использованием мультиагентных технологий с учетом подвижности центра управления. При условии сохранения предсказуемой реакции управляемого объекта на команду управления (стимул) необходимо предусмотреть возможность автономизации агента управления с сохранением коммуникативности с другими объектами, с изменением целеполагания при управлении на основе знаний и с учетом сбора и обработки информации о состоянии телекоммуникационных систем.

Существующие работы в области управления телекоммуникациями пока недостаточно подроб- но рассматривают применение ИИ-агентов управления подвижными, в частности, высокоманевренными объектами, при условии коллективного понимания всеми участниками управления контекста или среды взаимодействия. Поэтому целесообразно разработать концептуальную модель агента искусственного интеллекта или ИИ-агента управления системами связи с подвижными объектами при условии взаимодействия с системой управления знаниями по управлению.

Анализ и разработка модели агента искусственного интеллекта для управления подвижными объектами

Согласно ГОСТ 71476-2024 [3], под ИИ-аген-том понимается «Автоматически действующий объект, который воспринимает свое окружение, реагирует на него, а также предпринимает действия для достижения своих целей». Анализируя процесс принятия решений при управлении и технической эксплуатации систем связи, можно обоснованно предположить, что в любом случае ИИ-агент управления должен поддерживать механизм рассуждения или «reasoner» [4] для демонстрации лицу, принимающему решения (ЛПР)

хода своих рассуждений. ЛПР может использовать ИИ-агента в качестве «подсказчика-консультанта» для определения действий в текущей ситуации. Здесь ИИ-агент выступает в системной роли рефлекторного агента окружения с точки зрения искусственного интеллекта или ИИ-агента наблюдателя с точки зрения взаимодействия с внешней средой. Здесь ИИ-агент формирует модель окружающего мира непосредственно на основе сбора данных о состоянии подвижных объектов.

Для формирования управляющих воздействий ИИ-агент выступает в роли обучающегося агента или агента-познавателя с точки зрения взаимодействия с внешней средой, если он способен самостоятельно запускать процедуру обучения или переобучения и воспринимать результаты обучения других обучающихся ИИ-агентов с помощью трансферного обучения («переноса обучения», transfer learning) для модификации своего поведения. Обучающийся ИИ-агент способен анализировать информацию от множества рефлекторных агентов окружения. Обучающийся ИИ-агент выполняет функции центра управления.

Все рассмотренные выше типы ИИ-агентов используют в гетерономных системах управления. Можно отдельно классифицировать в рамках ИИ-системы целеориентированного ИИ-агента управления (агента-познавателя), который поддерживает функцию полезности, позволяющую определить действия или сценарий, ведущий к достижению цели управления. Такие ИИ-агенты могут использоваться как в гетерономных, так и в автономных системах управления [5].

Восприятие окружения ИИ-агентом производится по схеме «сверху вниз» для агента-по-знавателя и(или) по схеме «снизу-вверх» для агента-наблюдателя. При схеме «сверху вниз» осуществляется оценка текущего состояния и, при необходимости, вырабатывается реакция на стимулы (команды) в рамках понимания ИИ-агентом цели управления и контекста управления.

Под контекстом управления (факторы функционирования ИИ-агента) понимается сочетание семантически определенных факторов [6; 7], которые существенно влияют на коммуникации ИИ-агента в рамках «мира» или «сцены». Под «миром» («сценой») понимается описание состояния системы связи с помощью принятых терминов. К факторам здесь относятся декларативные требования, свойства, обстоятельства, совокупно необходимые для коммуникации ИИ-агента. Примером факторов являются требования и параметры взаимодействия объектов, показатели качества услуг связи (Quality of Service, QoS), описание целеполагания и метрики, оценивающие качество достижения цели, а также термины и условия соглашение об уровне обслуживания (Service Level Agreement, SLA).

В системе управления основным признаком функционирования ИИ-агента является его коммуникация с окружением, в том числе ЛПР, поскольку объективно выражает как результаты действия ИИ-агента в качестве познавателя, так и результаты восприятия ИИ-агентом факторов среды функционирования в качестве наблюдателя. В этом смысле в системе управления не должны присутствовать агенты без возможности сформировать к ним запрос. Также для обеспечения управляемости принимается, что ИИ-агент в качестве познавателя должен иметь связь по крайней мере с одним ИИ-агентом – наблюдателем в рамках отношения «ведущий – ведомый», а в случае трансферного обучения – «учитель – ученик» соответственно.

Для описания коммуникаций ИИ-агентов с учетом предлагаемой классификации целесообразен семантический метод, позволяющий в доступных для ЛПР выражениях описать, интерпретировать и отразить в концептах и атрибутах содержательную сторону и формальные аспекты управляемых телекоммуникационных систем, в том числе цели и смысл функционирования самого ИИ-агента в его взаимодействии с другими ИИ-агентами. Практически семантика позволяет интерпретировать функционирование ИИ-агента в части извлечения информации, верификации системы, обеспечения управляемости, что в совокупности определяет надежность системы управления, основанной на применении ИИ-агентов. Здесь допускается различный формализм семантик возможных миров, с помощью которого описывается определенная модель для анализа контекста ИИ-агентами в специфических терминах или концептах. Количество «миров» (а в общем случае множеств «миров») может быть, к примеру, равно двум, где первый «мир» определяется согласием ЛПР с результатами деятельности ИИ-агента, а другой «мир» соответствует несогласию ЛПР с результатами деятельности ИИ-агента.

При подходе «снизу вверх» ИИ-агент в роли наблюдателя ситуативно реагирует на стимул, т.е. сетевое событие в роли рефлекторного агента окружения на основе сенсорных данных и согласно заложенной модели поведения. В рамках этого подхода формируется «terminal level» [8], на котором формируется описание свойств наблю- даемых объектов, из которых далее формируется «мир» («сцена») и определяется контекст. Здесь обеспечивается также семантическая интероперабельность, которая позволяет ИИ-агентам «осознавать» контекст сенсорной информации, чтобы обрабатывать смысловое содержание «сцены» или «мира» в консенсуальном согласии с другими ИИ-агентами. Это обеспечивает в целом семантическую совместимость платформ ИИ-агентов и «миров»ИИ-агентов.

В отличии от архитектуры интеллектуального агента [9], дополнительно для семантической коммуникации агента с ЛПР предлагается применять интерфейс «человек-машина» (человекомашинный интерфейс), ЧМИ с помощью языковой модели [10]. Известно, что в языковых моделях точность и содержательность ответа зависит от контекста и точной формулировки вопроса и используемых «подсказок» в запросах с учетом объёма обучающих данных. Обучающие данные могут содержать сведения, отражающие множество различных точек зрения на объект управления с учетом уровней управления, информационных моделей управления, используемого набора сущностей, детализации описания атрибутов и поведения объектов управления, контекста управления (штатная или нештатная ситуация) [11]. Языковые модели в общем не предназначены для обеспечения выполнения логически обусловленной последовательности действий, что является очевидным условием обеспечения эффективного управления телекоммуникационными системами. В результате можно ожидать, что результаты применения языковых моделей «как есть» для управления телекоммуникационными системами не будут последовательным и обоснованным образом формировать политику управления.

Для устранения отмеченных недостатков в рамках предлагаемого подхода языковая модель будет дополнительно настроена с помощью онтологии предметной области управления телекоммуникациями по аналогии с решением [12]. Указанный подход снижает риски использованиям неполностью определенных либо неизвестных (и, соответственно, требующих дополнительного определения) концептов и их атрибутов при описании ЛПР задач управления ИИ-агенту. Одновременно обеспечивается и логический вывод и(или) решение на основе онтологии в дополнение к результатам обучения языковой модели. Языковая модель в дальнейшем может быть использована для создания системы голосового управления подвижными объектами и обеспечения интеллектуальной коммуникативности.

Для обеспечения адаптивности ИИ-агентов в отличие от предложенного ранее интеллектуального агента управления, поддерживавшего фиксированный алгоритм диагностики системного уровня SLD [13], предлагается применять сценарный подход, основанный на знаниях. С той же целью, в отличие от агента Интернета вещей (Internet of Things, IoA) [14], через контекстозависимый интерфейс можно получить доступ не к одной, а к нескольким взаимно-отображаемым онтологиям предметной области.

Наличие онтологии как элемента настройки обеспечивает как упорядоченное управление классификацией знаний, так и управление процессами получения знаний. Применение онтологии позволяет реализовать функции логического вывода для верификации структуры команд и поведения агентов. Следует отметить, что существует и обратный процесс, при котором с помощью используемой языковой модели можно расширять онтологию предметной области на основе вопросов по компетенциям (Competency Question) [15].

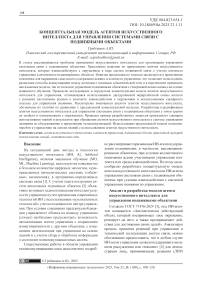

С учетом вышеизложенного можно предложить концептуальную модель ИИ-агента на рисунке 1. Эта модель рассматривается как типовая модель ИИ-агента в системе управления.

Рисунок 1. Концептуальная модель ИИ-агента для управления системами связи с подвижными объектами

Это означает, что ИИ-агент – наблюдатель и обучающийся ИИ-агент будут иметь одинаковую концептуальную модель с отличием только в системной роли, которая определяется логикой поведения ИИ-агента. С помощью логики поведения ИИ-агент адаптивно реагирует на изменения окружения с помощью модификации поведения. Логика ИИ-агента поддерживает функцию обработки данных, функцию планировщика и функцию обмена информацией. Функция обработки данных на основе сведений «мира» («сцены») и «подсказок» ЛПР формирует решение по управлению с поддержкой механизма рассуждений с использованием результатов машинного обучения. Функция планировщика предназначена для определения последовательности действий ИИ-агента при реакции на поступление информации «мира», например принятие решения о применении и(или) изменении модели машинного обучения, обращение для настройки к новой онтологии через контекстно-зависимый интерфейс. С помощью функции обмена информацией ИИ-агент коммуницирует с другими агентами в рамках «мира» («сцены») с помощью обмена сообщениями («запрос-ответ»).

Методы искусственного интеллекта и(или) машинного обучения, рассматриваются как внешние по отношению к ИИ-агенту. Метод ИИ (МО) может выступать формальной ссылкой для предварительно «обученного» ИИ-агента в роли рефлекторного агента окружения. Метод ИИ (МО) активизируется для фактического предобучения, обучения или переобучения ИИ-агента.

Память и кэш-память представляют собой совокупность сохраняемых упорядоченных данных и(или) правил в семантическом и в знаковом (цифра, знак) виде. В общем случае память и кэш-память являются семантическими, при этом данные в кэш-памяти наиболее актуальны по статусу и имеют минимальное время доступа и обновления [16; 17].

Контекстно-зависимый интерфейс (КЗИ) предполагает формирование интеллектуального адаптивного интерфейса для коммуникации с системой знаний и коммуникации с другими ИИ-агентами. Такой интерфейс является многомодальным [18] с учетом контекста применения ИИ-агента, в том числе описания метаданных, контекста «мира» или «сцены», контекста пользователя [19]. С помощью КЗИ осуществляется коммуникация с другими ИИ-агентами, в том числе с системой управления знаниями.

Организация использования знаний для обслуживания и управления телекоммуникациями

Использование знаний необходимо для поддержки процессов создания, хранения и обслуживания знаний, генерируемых в процессе эксплуатации и управления телекоммуникационными системами [20]. Целью использования знаний является повышение эффективности стратегического менеджмента наряду с поддержанием высокого качества оперативного управления телекоммуникациями. Для этого требуется использовать лучший опыт с помощью предоставления услуг в области знаний, при этом услуги предоставляют- ся в виде прикладных сценариев использования знаний предметной области. Каждый прикладной сценарий относится к области управления и предполагает предоставление набора услуг (сервисов) по работе со знаниями в различных процессах управления телекоммуникациями.

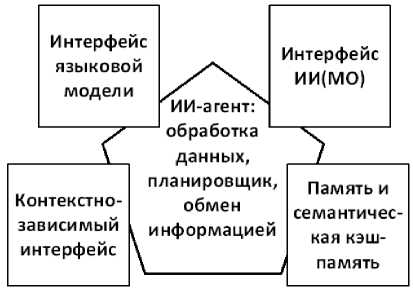

В целом функциональная схема управления знаниями для обслуживания и применения телекоммуникаций состоит из шести функциональных блоков, как показано на рисунке 2. Блок формирования знаний напрямую или опосредованно предоставляет возможности моделирования знаний, аннотирования знаний, извлечения знаний, поиска и объединения знаний, аргументации знаний и проверки знаний для поддержки преобразования исходных данных, генерируемых в процессах эксплуатации и управления сетью, в знания. Блок хранения знаний обеспечивает возможность создания базы знаний для эксплуатации и управления телекоммуникациями. Блок хранилища (базы) знаний обеспечивает обновление знаний, управление процессом создания знаний, управление версиями сценариев и управление классификацией знаний для обеспечения ценности знаний по эксплуатации и управлению телекоммуникациями.

Рисунок 2. Функциональная схема управления знаниями [12]

Блок управления исходными данными по областям знаний предоставляет такие возможности, как управление жизненным циклом исходных данных и управление качеством исходных данных. Блок формирования знаний является ключевым в рассматриваемой схеме. Моделиро- вание знаний определяется, к примеру, моделью онтологии знаний для эксплуатации и управления телекоммуникациями, чтобы семантически формализовать весь процесс построения знаний. В свою очередь онтология определяет конкретные значения концептов (терминов) и их отношения, например отношения между причиной неисправности сети, явлением неисправности сети, классификацией тяжести последствий неисправности сети в области устранения неисправностей.

Проверка (валидация) знаний предполагает комплексный анализ качества знаний по выбранным метриками оценки качества знаний, включая точность информации, сведения о результатах применения. ИИ-агент в роли целеориентированного агента-познавателя взаимодействует с рассматриваемой структурой в рамках подхода «сверху-вниз» способом, который будет рассмотрен далее.

Разработка схемы взаимодействия между ИИ-агентами для представления окружения подвижных устройств

В процессе управления ИИ-агенты формируют представление о «мире» или «сцене», как модели окружения, с учетом контекста. При этом интерпретация одной и той же информации от ИИ-агентов – наблюдателей и ИИ-агентов с функцией познавателя в общем случае может отличаться, поскольку, например, ИИ-агенты используют различные прикладные сценарии использования знаний или результаты машинного обучения (переобучения). При этом ИИ-агенты должны коммуницировать посредством семантических сетей применительно к коммуникациям, например в рамках перехода к сетям 6G [21]. В отличие от архитектуры генеративного ИИ-агента [22], предполагается, что компонент «Planning», транслирующий выводы ИИ-агента в планы более высокого уровня, может быть реализован в виде прикладного сценария на рисунке 2. При этом ИИ-агент сохранит возможности наблюдения и возможности синтеза результатов наблюдения с учетом контекста для формирования представления о «мире» в качестве ИИ-агента познавателя.

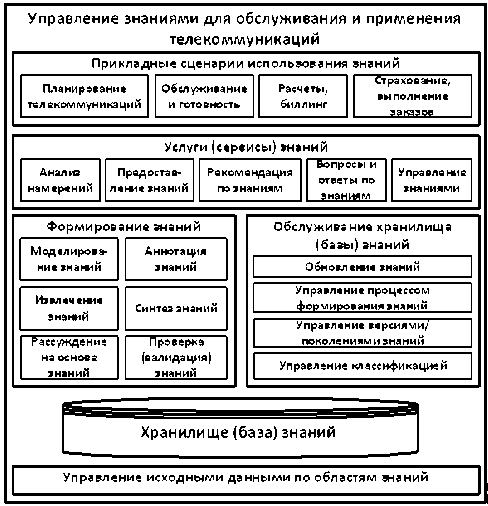

С учетом имеющейся информации становится актуальной задача создания обобщенной семантической модели для управления подвижными объектами. Согласно нотации [7] формальное представление ИИ-агентов о «мире» или «сцене» показано на рисунке 3. Здесь уровень T (Time) представляет собой совокупность моментов времени наблюдения. Уровень O (Observation) представляет собой уровень функционирования

ИИ-агентов – наблюдателей за сетевой ситуацией, уровень A (Alternatives) соответствует уровню ИИ-агентов познавателей, которые формируют альтернативное видение «мира» уровня O на основе контекста данных от ИИ-агентов – наблюдателей. Пусть начиная с момент времени t0 до момента времени ti ИИ-агент – наблюдатель собирал по два набора данных, каждый из которых характеризует два объекта в составе одной сети или сетевого домена.

Рисунок 3. Схема формирования представления ИИ-агентов об окружении (с учетом [7])

Тогда можно говорить о множестве сцен на соответствующем уровне O = { O 11 , O 21,..., O 1 i , O 2 i } . Это множество данных о «сцене» или «мире» интерпретируется двумя ИИ-агентами – позна-вателями, что порождает множеством альтернатив на уровне познавателей, следующего вида: A = { A 111 , A 211 , A 121 , A 221 ..., A 11 i , A 21 i , A 12 i , A 22 i } •

Здесь первый знак индекса соответствует уровню A ИИ-агента (1 или 2) на рисунке 3, второй знак индекса соответствует номеру сцены (или ИИ-агента – наблюдателя), третий знак индекса соответствует моменту времени наблюдения. Здесь возникает проблема комбинаторного увеличения количества интерпретаций «сцен» в связи как с увеличением количества ИИ-агентов, так и с представлением о том, что действительно «знает» ИИ-агент.

Указанная проблема в контексте формальных логик рассмотрена в работе [23] в рамках анализа эпистемического сценария, когда допускается ситуация, в которой можно понять, что известно, а что неизвестно ИИ-агенту. Это позволяет явным образом описывать знание или незнание ИИ-агента о каком-то факте предметной области.

Следствием того, что допускается ситуация «незнания» и становится создание эпистеми-ческого сценария. Чтобы сократить количество копий «миров» и предотвратить комбинаторный экспоненциальный рост модели в связи с раз- личными сочетаниями «знаний» и «незнаний», используется семантика структур знания, синтаксическая и диаграмматическая эпистемическая логика, что не исчерпывает существующее количество подходов к моделированию сценариев применительно к схеме на рисунке 3.

В любом из рассмотренных случаев необходимо рассмотреть проблему организации коммуникации ИИ-агентов управления, поскольку без коммуникации невозможно совместная реализация сценариев. В рассматриваемом случае анализируются технологический и содержательные аспекты коммуникации.

На технологическом уровне совокупность автономных подвижных (маневренных) устройств с ИИ-агентами находится в определенной геометрической области, где существует техническая возможность обмена данными и командными слова-

связи для адаптации сцепления между ИИ-аген-тами при изменении местоположения;

aij – элемент матрицы связности между i -м и j -м ИИ-агентами на графе G ;

xi,x j – состояние (положение) i -го устройства с ИИ-агентом и j -го устройства с ИИ-агентом соответственно.

gi (—) = “

ij— если | | w || > k;

w

w

— если 11 — < k i .

где gi ( w ) - нелинейная функция, аппроксимирующая размеры зоны связности между агентами;

w – описывает внешние возмущения, связанные с устройством с ИИ-агентом, которые способны вывести ИИ-агента за пределы зоны связ-

ми от подвижного центра управления, используя каналы и средства радиосвязи. Для этого используется т.н. сдерживающее управление [24; 25], где ИИ-агент – познаватель выполняет функции ведущего объекта и центра управления, для чего занимает высшее положение в иерархии многоагентной системы.ИИ-агент–наблюдательвыполняетфунк-ции ведомого объекта, и занимает низшее положение в иерархии многоагентной системы, причем ИИ-агент – наблюдатель находится в зоне действия ИИ-агента – познавателя.

Пусть устройство с ИИ-агентом – наблюдателем способно изменять своё направление перемещения по отношению к ИИ-агентам – наблюдателям. При более общей постановке задачи существует возможность перемещения устройства с ИИ-агентом – наблюдателем относительно ИИ-агента – познавателя. Тогда для каждого ИИ-агента – наблюдателя существует ориентированный путь на ИИ-агента – познавателя на графе связности G из N ИИ-агентов, из которых M ИИ-агентов относятся к наблюдателям. Тогда существует воздействие на ИИ-агента – познава-теля u i , определяющее степень взаимодействия с ИИ-агентами – наблюдателями, что определяется

ности;

k i – скалярные величины, определяющие ус-

ловную ширину «зоны связности» подвижных устройств с ИИ-агентами.

Под зоной связности понимается не только об-

ласть физической доступности, но в более узкой трактовке – зона, в которой действует та или иная стратегия управления подвижными объектами.

Следует отметить, что часть выражения (1), N а именно ctKS aj (xi — xj) описывает ситуацию .j=1

передачи устройствами значений своих выходов на соседние устройства, а часть выражения (1)

вида

c 2 g i K E a J ( x i k J = 1

—

xJ)

J

ненулевое

следующим выражением:

N u, = cK\a„ (x,.

i i ij i j=1

- x/) +

<

+ c 2 g i K S a j ( x i

I J = 1

-

^

x j] ,

J

воздействие на ИИ-агент – познавателя, например, при реализации сценария использования знаний на рисунке 2.

Для коммуникации между ИИ-агентами используется язык коммуникации агентов ACL (Agent Communication Language) [26], который имеет формализацию семантики, позволяющую применять ACL как протокол. В рамках системы управления структурирование и определение формата сообщений не являются существенными ограничением многоагентной модели, напротив, определение политики и протокол взаимодействия позволяют создать верифицируемую семантическую модель коммуникации [27], основанную на допустимой последовательности обмена сообще-

где c 1 , c 2 – коэффициенты в виде постоянных для описания связи (сцепления) между устройствами с ИИ-агентами;

K g R p x n — матрица коэффициентов обратной

ниями и относящуюся к семантическим моделям политик общения (conversational policy).

В целом коммуникация между ИИ-агентами в процессе машинного обучения ранее рассмотрена в [28] и, согласно предложенной классификации, рассматривается здесь как централизованное обучение с децентрализованным исполнением. При

этом, с учетом фактора неопределенности в сведениях о «мире» («сцене») допускается использование метода рекурсивного вывода, когда по крайней мере ИИ-агент – познаватель получает представление о состоянии других ИИ-агентов – познавателей. В целом коммуникация между ИИ-агентами соответствует случаю обучения коммуникации (Learning Communication), когда ИИ-агенты могут обмениваться информацией с помощью коммуникационных протоколов, например, через прямые сообщения.

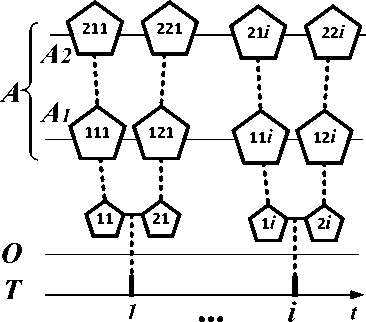

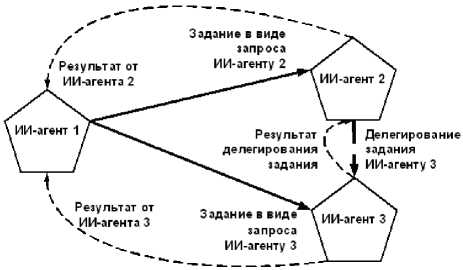

На содержательном уровне должна обеспечиваться семантическая интероперабельность [29]. Здесь семантика отражает содержательную сторону или смысл данных, которые поступают на уровень O . Свойство семантической интероперабельности позволяет рефлекторным ИИ-агентам окружения, являющимися агентами – наблюдателями, «осознавать» смысл информации и уже на стадии наблюдения обрабатывать данные с учетом их смыслового содержания. Это особенно важно при использовании различных единиц величин при прямых измерениях, либо при косвенных измерениях. Схема коммуникаций между ИИ-агентами в виде запросов и результатов исполнения заданий приведена на рисунке 4.

Рисунок 4. Cхема обмена сообщениями ИИ-агентов в системе управления

Пусть в рассматриваемом случае ИИ-агент 1 выдает задание на исполнение в виде запроса ИИ-агенту 2 и ИИ-агенту 3. ИИ-агент 1 может быть агентом – познавателем, а ИИ-агент 2 и ИИ-агент 3 являются агентами – наблюдателями.

В рамках рассматриваемого подхода, ИИ-агент 2 при недостатке информации для исполнения запроса от ИИ-агента 1 может обратиться за сведениями к ИИ-агенту 3. В рамках рассматриваемой схемы это рассматривается как делегирование задания от ИИ-агента 1 как объекта верхнего уровня иерархии. В свою очередь, ИИ-агент 3 воспринимает и выполняет делегированное задание как информирование ИИ-агента 2 в части недостающей информации.

В результате ИИ-агент 2 и ИИ-агент 3 направляют результаты выполнения задания в сторону ИИ-агента 1. В результате ИИ-агент 2 и ИИ-агент 3 направляют результаты выполнения задания в сторону ИИ-агента 1, причем ИИ-агент 2 предоставляет не только свои наблюдения, но и данные, полученные от ИИ-агента 3.

Таким образом появляются две пересекающиеся области данных в рамках одного и того же прикладного сценария использования знаний, когда собственные данные от ИИ-агента 2 дополнены данными от ИИ-агента 3. Делегирование в целом не является обязательным, но такой вид коммуникации следует учитывать при применении ИИ-агентов для управления системами связи с подвижными объектами.

С учетом обозначений международно-признанного стандарта ISO/MEC 20005:2013 рассмотрим формат запроса. Пусть используется автономный целеориентированный ИИ-агент – познаватель, причем его автономность предполагает способность изменять свою целевую область использования и/или цель управления, если этого требует взаимодействие с системой управления знаниями. Здесь можно исходить из предположения что автономный целеориентированный ИИ-агент может «не знать» о новых сценариях. В результате, получив новый прикладной сценарий, ИИ-агент может изменить целеположение в рамках процесса управления.

Запрос от автономного ИИ-агента – познавате-ля может формироваться, например, в контексте управления QoS. Здесь задание в виде запроса на получение результатов измерения обозначается как QOS-MEASUREMENT.request . Предварительным условием является наличие такого управления взаимным перемещением, при котором имеется связка ИИ-агентов в контексте обеспечения QoS и управление обеспечивается согласно формуле (1) на графе связности G . Тогда пример описания запроса от ИИ-агента 1 к ИИ-агенту 2 на рисунке 4 может иметь вид:

QoS-MEASUREMENT.request {

QoS-MEASUREMENT RequestorID, QoS-MEASUREMENT AgentProfileID, QoS-MEASUREMENT AgentMeasurementList,

{

Параметр запроса QOS-MEASUREMENT. RequestorID содержит идентификатор ИИ-агента как источника запроса, параметр QOS-MEASUREMENT AgentProfileID содержит метаинформацию или ссылку на роль и контекст агента в рамках запроса сценария, параметр QOS-

MEASUREMENT AgentMeasurementList содержит список терминов или концептов, в зависимости от контекста измерения, и связанных с ними атрибутов т.е. значений концептов онтологии предметной области [30].

В случае обнаружения результатов измерения ИИ-агенту 1 направляется требуемая информация в виде ответного сообщения следующего вида:

QoS-MEASUREMENT.confirm { QoS-MEASUREMENT RequestorID, QoS-MEASUREMENT ProfileID, QoS-MEASUREMENT ServiceID, QoS-MEASUREMENT ReportList, {

В рассматриваемом ответе содержится обозначение ответа на запрос QOS-MEASUREMENT. request , которое содержит список параметров. Параметр QOS-MEASUREMENT RequestorID содержит идентификатор ИИ-агента – источника запроса, параметр QOS-MEASUREMENT ProfileID содержит метаинформацию прикладного сценария измерения, например сценарий распознавания цели. Параметр QOS-MEASUREMENT ServiceID содержит идентификатор услуги управления, например услуга классификации цели по принципу «свой – чужой», параметр QOS- MEASUREMENT ReportList содержит перечень данных или ссылку на массив данных с результатами измерений для оказания услуги. Запрос прикладного сценария из системы управления знаниями производится аналогично.

В рамках ГОСТ Р 71840–2024 [31] рассмотренные на рис. 4. запросы и процедуры коммуникации между ИИ-агентами могут быть реализованы на платформе обмена данными интернета вещей DEP (Data Exchange Platform), а схемы коммуникации между ИИ-агентами относятся к глобальным службам.

Для тестирования предлагаемого решения предлагается использовать положения ISO/IEC TR 29119-11:2020, Part 11 в части руководства по тестированию систем искусственного интеллекта. Целесообразно провести тестирование входящих данных, которые поступают для обработки ИИ-агентом – наблюдателем на непрерывность, целостность, отсутствие выбросов. Далее выполняется индивидуальное тестирование ИИ-агентов – наблюдателей и ИИ-агентов агента – познавателя по дополнительно разрабатываемым UNIT-тестам (автономные испытания) с учетом потока обработки информации в модели управления, например, согласно документу [32]. Далее проводится интеграционное тестирование

(комплексное испытание) по аналогии с тестированием мультиагентных сред для автономных агентов [33]. Автономное и интеграционное тестирование допускается проводить с применением больших языковых моделей для разработки поведенчески ориентированных тестов [34].

Для ИИ-агентов индивидуально тестируется корректная интерпретация выражений на естественном языке и подсказок (prompts), при этом следует убедиться, что ИИ-агенты не допускают недозволенного поведения как в контролируемом, так и в автономном режиме. При интеграционном тестировании следует проверить, каким образом ИИ-агенты использует базу знаний, следуя сценариям или обрабатывая запросы, требующие использования знаний. Особо проверяется способность ИИ-агентов и системы к планированию своих действий, в рамах сценариев, требующих принятия решений и реализация этих действий.

Следует удостовериться в высокой степени интеграции и эффективном использовании ИИ-агентами аппаратного обеспечения, программных библиотек и интерфейсов программных приложений при выполнении задач управления или ответе на запросы других ИИ-агентов или ЛПР. Содержание тестов и проформа тестирования определяется программой и методикой испытаний системы управления. Тестирование онтологии производится на стадии разработки и внедрения в части проверки логического вывода и проверки на непротиворечивость [35]. Окончательно комплексное тестирование управления системами связи с подвижными объектами можно провести по методике для сети 5G O-RAN [36].

Заключение

Новизна предлагаемого подхода заключается в применении семантики для выражения смыслового содержания команд и контекста управления, что позволяет использовать различные способы коммуникации между агентами с помощью семантической сети, прежде всего, языковые модели, а в перспективе – команды голосового управления. Предполагается, что предлагаемый подход позволит создать искусственный язык общения «машина – машина» для целей координации и управления поведением подвижных объектов, что расширит автономность их поведения через интеллектуальную коммуникативность и применение методов трансферного обучения (transfer learning). Предложена концептуальная модель агентов искусственного интеллекта для управления, отличающаяся использованием двухуровневой иерархической схемы агентов, состоящей из агентов с разными системными ролями в контексте задач управления и взаимодействия с окружением, в том числе с системой управления знаниями на основе сценарного подхода. Предложена общая классификация ИИ-агентов для управления подвижными объектами. Предложены схемы коммуникации между ИИ-агентами с учетом их системных ролей. Определены возможные параметры запросов и результатов обработки запросов для обслуживания и последующего применения при управлении подвижными объектами, в том числе с учетом подвижности центра управления.