Метод трехмерного захвата движений человека на основе компьютерного зрения

Автор: Обухов А.Д., Дедов Д.Л., Суркова Е.О., Коробова И.Л.

Журнал: Advanced Engineering Research (Rostov-on-Don) @vestnik-donstu

Рубрика: Информатика, вычислительная техника и управление

Статья в выпуске: 3 т.23, 2023 года.

Бесплатный доступ

Введение. Проведенный анализ существующих подходов к отслеживанию тела человека выявил наличие проблем при захвате движений в трехмерной системе координат. Отмечена перспективность систем захвата движений на основе компьютерного зрения. В существующих исследованиях по безмаркерным системам захвата движений рассматривается позиционирование только в двумерном пространстве. Поэтому целью исследования являлось повышение точности определения координат человеческого тела в трехмерных координатах за счет разработки метода захвата движения на основе компьютерного зрения и алгоритмов триангуляции.Материалы и методы. Представлен метод захвата движений, включающий калибровку нескольких камер и формализацию процедур обнаружения человека в кадре с использованием сверточной нейронной сети. На основе полученных от нейронной сети скелетных точек осуществляется трехмерная реконструкция модели тела человека с использованием различных алгоритмов триангуляции.Результаты исследования. Проведены экспериментальные исследования по сравнению четырех алгоритмов триангуляции: прямого линейного переноса, линейного метода наименьших квадратов, L2 триангуляции и полиномиального методов. Определен оптимальный алгоритм триангуляции (полиномиальный), обеспечивающий погрешность не более 2,5 пикселей или 1,67 сантиметров.Обсуждение и заключение. Выявлены недостатки существующих систем захвата движения. Предложенный метод направлен на повышение точности захвата движений в трехмерных координатах с использованием компьютерного зрения. Полученные результаты интегрированы в программное обеспечение позиционирования тела человека в трехмерных координатах для удаленного мониторинга, использования в виртуальных тренажерах и системах захвата движений.

Захват движений, виртуальная реальность, триангуляция, компьютерное зрения, машинное обучение

Короткий адрес: https://sciup.org/142238875

IDR: 142238875 | УДК: 004.9 | DOI: 10.23947/2687-1653-2023-23-3-317-328

3D human motion capture method based on computer vision

Introduction. The analysis of approaches to tracking the human body identified problems when capturing movements in a three-dimensional coordinate system. The prospects of motion capture systems based on computer vision are noted. In existing studies on markerless motion capture systems, positioning is considered only in two-dimensional space. Therefore, the research objective is to increase the accuracy of determining the coordinates of the human body in three-dimensional coordinates through developing a motion capture method based on computer vision and triangulation algorithms.Materials and Methods. A method of motion capture was presented, including calibration of several cameras and formalization of procedures for detecting a person in a frame using a convolutional neural network. Based on the skeletal points obtained from the neural network, a three-dimensional reconstruction of the human body model was carried out using various triangulation algorithms.Results. Experimental studies have been carried out comparing four triangulation algorithms: direct linear transfer, linear least squares method, L2 triangulation, and polynomial methods. The optimal triangulation algorithm (polynomial) was determined, providing an error of no more than 2.5 pixels or 1.67 centimeters.Discussion and Conclusion. The shortcomings of existing motion capture systems were revealed. The proposed method was aimed at improving the accuracy of motion capture in three-dimensional coordinates using computer vision. The results obtained were integrated into the human body positioning software in three-dimensional coordinates for use in virtual simulators, motion capture systems and remote monitoring.

Текст научной статьи Метод трехмерного захвата движений человека на основе компьютерного зрения

Научная статья

Введение. Проведенный анализ существующих подходов к отслеживанию тела человека выявил наличие проблем при захвате движений в трехмерной системе координат. Отмечена перспективность систем захвата движений на основе компьютерного зрения. В существующих исследованиях по безмаркерным системам захвата движений рассматривается позиционирование только в двумерном пространстве. Поэтому целью исследования являлось повышение точности определения координат человеческого тела в трехмерных координатах за счет разработки метода захвата движения на основе компьютерного зрения и алгоритмов триангуляции.

Материалы и методы . Представлен метод захвата движений, включающий калибровку нескольких камер и формализацию процедур обнаружения человека в кадре с использованием сверточной нейронной сети. На основе полученных от нейронной сети скелетных точек осуществляется трехмерная реконструкция модели тела человека с использованием различных алгоритмов триангуляции.

Результаты исследования . Проведены экспериментальные исследования по сравнению четырех алгоритмов триангуляции: прямого линейного переноса, линейного метода наименьших квадратов, L2 триангуляции и полиномиального методов. Определен оптимальный алгоритм триангуляции (полиномиальный), обеспечивающий погрешность не более 2,5 пикселей или 1,67 сантиметров.

Обсуждение и заключение . Выявлены недостатки существующих систем захвата движения. Предложенный метод направлен на повышение точности захвата движений в трехмерных координатах с использованием компьютерного зрения. Полученные результаты интегрированы в программное обеспечение позиционирования тела человека в трехмерных координатах для удаленного мониторинга, использования в виртуальных тренажерах и системах захвата движений.

Информатика, вычислительная техника и управление

Original article

3D Human Motion Capture Method Based on Computer Vision

Artem D. Obukhov B, Denis L. Dedov , Ekaterina O. Surkova , Irina L. Korobova

Tambov State Technical University, Tambov, Russian Federation

Introduction. The analysis of approaches to tracking the human body identified problems when capturing movements in a three-dimensional coordinate system. The prospects of motion capture systems based on computer vision are noted. In existing studies on markerless motion capture systems, positioning is considered only in two-dimensional space. Therefore, the research objective is to increase the accuracy of determining the coordinates of the human body in threedimensional coordinates through developing a motion capture method based on computer vision and triangulation algorithms.

Materials and Methods. A method of motion capture was presented, including calibration of several cameras and formalization of procedures for detecting a person in a frame using a convolutional neural network. Based on the skeletal points obtained from the neural network, a three-dimensional reconstruction of the human body model was carried out using various triangulation algorithms.

Results. Experimental studies have been carried out comparing four triangulation algorithms: direct linear transfer, linear least squares method, L2 triangulation, and polynomial methods. The optimal triangulation algorithm (polynomial) was determined, providing an error of no more than 2.5 pixels or 1.67 centimeters.

Discussion and Conclusion. The shortcomings of existing motion capture systems were revealed. The proposed method was aimed at improving the accuracy of motion capture in three-dimensional coordinates using computer vision. The results obtained were integrated into the human body positioning software in three-dimensional coordinates for use in virtual simulators, motion capture systems and remote monitoring.

Acknowledgements: the authors would like to thank the editorial board of the journal and the reviewer for their professional analysis and recommendations for correcting the text of the article.

Funding information. The research was done on grant of the Russian Science Foundation No. 22–71– 10057,

Введение. В области компьютерного зрения в настоящее время достигнут значительный прогресс. Разработаны технологии, позволяющие решать задачи обнаружения объектов, определения их состояния, геометрической оценки изображенного на кадре пространства и многие другие. Благодаря этому компьютерное зрение получило широкое распространение в различных сферах деятельности человека, начиная от здравоохранения и образования, заканчивая сферой развлечений. Достаточно перспективным направлением является применение технологий компьютерного зрения для трехмерной реконструкции и позиционирования различных объектов, в том числе и людей. Существует достаточно большое количество систем для определения абсолютного положения человека в пространстве, которые можно разделить по следующим категориям:

-

- системы, использующие инерциальные датчики и позволяющие определить величину их перемещения, а также изменение углов между ними, что предполагает использование гироскопов и акселерометров [1]. Известным представителем данной категории является Noitom Mocap Perception Neuron [2], включающий до 32 инерциальных датчиков;

-

- лазерные системы позиционного слежения, основанные на использовании базовых станций, установленных на противоположных сторонах помещения и излучающих инфракрасные лучи, которые позволяют точно определять положение и ориентацию датчиков в пространстве. Примером таких систем являются комплекты виртуальной реальности от компании HTC [3], обладающие погрешность до 0,1 мм;

-

- системы, использующие магнитные датчики [4], основанные на применении магнитного поля для захвата движения человека, которые предполагают наличие носимых датчиков на теле пользователя. К данной категории относится Polhemus Liberty — портативная электромагнитная система отслеживания движений, считающаяся одной из самых быстрых (частота дискретизации 240 Гц);

-

- оптические системы на основе маркеров — определяют положение объектов по маркерам с использованием набора камер. Примером является Vicon, обладающий достаточно низкой погрешностью: средние абсолютные ошибки отслеживания маркера составляют 0,15 мм при статических испытаниях и 0,2 мм (с соответствующими угловыми ошибками 0,3°) — при динамических испытаниях [5];

-

- безмаркерные оптические системы, основанные на использовании компьютерного зрения и машинного обучения. Примерами таких технологий являются OpenPose, MediaPipe, Movenet. С их помощью движения человека могут отслеживаться с точностью до 30 мм [6].

Анализируя перечисленные категории систем захвата движений, можно сделать вывод, что большинство решений, используемых для распознавания человеческих действий и движений предполагает наличие различных носимых устройств, таких как сенсоры или перчатки. Основная масса этих устройств являются громоздкими из-за большого количества датчиков и необходимости проводного подключения. Некоторые такие системы обладают высокой точностью, но при этом не могут быть использованы из-за размеров или наличия электромагнитных помех [7]. Инерциальные системы имеют ряд проблем, связанных с накоплением ошибок, что ограничивает их использование только относительным позиционированием в пространстве.

Поэтому большой популярностью пользуются оптические системы для распознавания и отслеживания действий пользователя. Для получения информации о действиях и положении пользователя используются кадры, полученные с камеры. Среди оптических систем стоит отметить те, которые используют маркеры (пользователь может быть одет в специальную одежду или на нем закреплены определенные метки), что затрудняет их использование в реальных условиях и больше применимо для специально подготовленных помещений (например, киностудий).

Системы, не использующие какие-либо маркеры, позволяют пользователям более свободно взаимодействовать с окружающей средой и больше подходят для применения в реальных условиях. К существенным недостаткам систем этого направления можно отнести относительно невысокую точность, ненадёжность и низкую производительность. Во многом это может быть обусловлено недостатками алгоритмов компьютерного зрения, используемых для распознавания человека в кадре, а также следующими причинами: изменчивостью внешнего вида человека и условий освещения, частичными окклюзиями из-за наслоения объектов в сцене, сложностью человеческой скелетной структуры.

В основе работы безмаркерных систем захвата движения, как правило, используется алгоритм оценки позы человека. Подходы к решению задачи оценки позы человека можно разделить на нисходящие и восходящие. В нисходящих подходах сначала происходит обнаружение людей в кадре, затем оценка позы каждого найденного человека. Алгоритмы, которые относятся к восходящим подходам, на первом этапе выполняют поиск частей тела в кадре, затем производят их группировку в позы. Как правило, для этой задачи применяются сверточные нейронные сети, такие как YOLO (You Look Only Once) [8], SSD (Single Shot Detection) [9], R–CNN (Region CNN) [10] и другие. Они позволяют распознавать множество различных объектов, включая человека или отдельные части тела с высокой точностью. Однако одним из недостатков решений, перечисленных выше, можно назвать их низкую производительность и медленную работу. Для решения этой проблемы существуют специальные фреймворки (MoveNet [11], MediaPipe [12], OpenPose [13]), также использующие нейронные сети, оптимизированные для работы в режиме реального времени.

Информатика, вычислительная техника и управление

Необходимо отметить, что вышеуказанные алгоритмы, технологии и подходы безмаркерных систем захвата движения позволяют осуществить позиционирование в двумерном пространстве, что затрудняет как определение расстояния до объектов и их размеров, так и отслеживание сложных движений, когда, например, руки пользователя скрыты его телом. Существующие решения в области стереокамер могут быть эффективны, но не отличаются большой точностью при значительном удалении объекта от камеры, что происходит при отслеживании всего тела человека. Кроме того, они не решают проблемы окклюзий. Таким образом, актуальным направлением исследований является разработка метода захвата движений с использованием нескольких камер и технологий компьютерного зрения. При реализации многокамерных систем захвата движений неизбежно возникает проблема совмещения объектов с нескольких изображений, т.е. необходимость выполнения триангуляции. Среди методов триангуляции можно выделить линейные и итеративные линейные алгоритмы.

Линейная триангуляция наиболее распространённый подход к выполнению реконструкции объектов в трёхмерном пространстве, включающая такие методы как линейно-собственный метод, линейный метод наименьших квадратов, прямое линейное преобразование, отличающиеся разной степенью устойчивости к шуму [14].

Итеративные линейные методы представляют собой более надёжную версию линейной триангуляции. Обычные линейные методы могут быть менее точны при решении задач триангуляции совокупности точек, так как при решении систем минимизируемая ошибка не имеет геометрического смысла (не учитывает форму скелета и правила соединения точек). Основная идея итерационных линейных методов заключается в адаптивном изменении весов линейных уравнений таким образом, что взвешенные уравнения соответствуют ошибкам. К итеративным линейным методам можно отнести L2 и L∞ триангуляцию [15].

Таким образом, в рамках данного исследования ставится следующая задача: необходимо разработать метод захвата движений человека, позволяющий позиционировать тело пользователя в трехмерных координатах с минимальной погрешностью и с использованием технологий компьютерного зрения. Предлагаемый метод может использоваться как замена существующих систем захватам движений, так и входить в состав других алгоритмов, например, для последующей классификации состояния человека. Целью данной работы является повышение точности определения поз и координат человеческого тела в трехмерных координатах за счет разработки методов захвата движения на основе компьютерного зрения. Для достижения поставленной цели необходимо формализовать основные этапы процесса захвата точек тела человека с нескольких камер, интегрировать алгоритмы триангуляции, выбрав среди них оптимальный с точки зрения точности, осуществить программную реализацию предложенного метода.

Материалы и методы. Решение задачи трехмерного позиционирования человека в пространстве включают следующие основные этапы:

-

- предварительная калибровка набора камер;

-

- реализация процедур обнаружения человека в кадре и расчет скелетных точек;

-

- расчет трехмерной реконструкции модели тела человека.

Рассмотрим их более подробно.

Процесс калибровки включает в себя выполнение системой камер нескольких снимков калибровочного шаблона, на котором можно легко выделить ключевые точки с известными для них относительными положениями в пространстве. После осуществляется расчет внутренних и внешних параметров для каждой камеры. Внутренние параметры постоянны для конкретной камеры, внешние — зависят от расположения камер относительно друг друга [16]. Поэтому данный шаг необходимо выполнять перед первым использованием системы камер в заданном расположении.

Для вычисления значений координат точки в трёхмерном пространстве необходимо знать координаты её проекций на изображениях и проективные матрицы камер [17]. Проективная матрица P некоторой камеры может быть представлена в виде комбинации матриц A (содержащей внутренние параметры камеры) и R (вращения), а также вектора перемещения T , которые описывают изменение координат из мировой системы координат в систему координат относительно камеры:

P = A[ R | T ] =

0 Сх Г 11 fy cy r 21

0 1 L Г 31

r _ Г r12

r r22

У r32

t 1 t 2

t 3 J

,

где (x, y) — координаты проекции трёхмерной точки на изображении в пикселях; (cx,cy) — координаты

центральной точки камеры; ( fx , fy ) — фокусное расстояние в пикселях.

На втором этапе необходимо получить непосредственно ключевые (скелетные) точки тела человека на каждой их камер. Для извлечения скелетных точек тела из кадра возможно применение различных технологий машинного обучения, например, MoveNet, MediaPipe, OpenPose и других [18]. В рамках данного исследования предлагается использовать высокоэффективный и производительный модуль Pose из библиотеки MediaPipe. MediaPipe Pose использует машинное обучение для высокоточного отслеживания позы тела человека, определения трехмерных ориентиров и маски сегментации фона на всем теле из видеокадров RGB. Данный подход позволяет отслеживать до 33 точек и обеспечивает работу в реальном времени на большинстве современных устройств.

Таким образом, в рамках второго этапа формируется набор из 33 точек для каждой i -ой камеры:

{ X j = Uu yvV y^ | j e {1,2,...,33}, i e {1,2,..., K } } , (2) где uij — координата j -ой точки по оси X на i -ом изображении; vij — координата j -ой точки по оси Y на i -ом изображении; K — общее количество камер и изображений.

На третьем этапе выполняется расчёт положений ключевых скелетных точек в трёхмерном пространстве. Для получения данных о положении скелетных точек человека в пространстве выполняется триангуляция — нахождение координат трёхмерной точки по координатам её проекций. Триангуляция — одна из важнейших задач в компьютерном зрении, её решение является решающим этапом в 3D-реконструкции и влияет на точность всего результата [19].

В основе трехмерной реконструкции точек объекта по значениям положений проекций точек на изображениях со всех камер лежит эпиполярная геометрия. Основная её идея заключается в том, что 3D-точки в сцене проецируются на линии в плоскости изображения каждой камеры — эпиполярные линии. Эти линии соответствуют пересечению плоскости изображения с плоскостью, проходящей через центры камер и 3D-точку. Данная идея обеспечивает условие для поиска пар соответствующих точек на двух изображениях: если известно, что точка x на плоскости первого изображения соответствует точке x ' на плоскости другого изображения, то ее проекция должна лежать на соответствующей эпиполярной линии. Согласно этому условию, для всех соответствующих пар точек x о- x ' будет справедливо следующее отношение:

x ' Fx = 0, (3)

где F — фундаментальная матрица, имеющая размер 3 х 3 и ранг равный 2.

Для некоторой точки X , заданной в трёхмерном пространстве, справедлива следующая формула проецирования, выражающаяся в однородных координатах:

x = pX , (4)

где xi = w(ui,vi,1)T — однородные координаты некоторой точки на плоскости i-го изображения (полученной с i-ой камеры в ходе второго этапа), включающие положение на изображении ui (по оси X) и vi (по оси Y); w — коэффициент масштабирования; Pi — проекционная матрица i-й камеры, полученная на первом этапе.

Для упрощения вычислений проекционная матрица камеры зачастую представляется в следующем виде:

P 1 T

P 2 T P 3 T

( P i е К 3 х 4 ) ,

-

(5)

-

(6)

-

(7)

где pijT — j -ая строка матрицы Pi .

Следовательно, уравнение (4) может быть представлено следующим образом:

wU = p iT X , wVi = P 2 T X , w = p i 3 T X .

Так как w — коэффициент масштабирования, получаем следующую систему уравнений: u i p 3 T X - p iT X = 0, u i p 3 TX - p t TX = 0.

Так как X является однородным представлением координат в трёхмерном пространстве, то для их вычисления необходимо получить xi и Pi как минимум для двух камер. Для решения системы уравнений (7) рассмотрено 4 алгоритма [14]:

-

— прямой линейный перенос (DLT);

-

— линейный метод наименьших квадратов;

-

- L2 триангуляция;

Информатика, вычислительная техника и управление

-

— оптимальный (полиномиальный) метод.

DLT относится к линейным алгоритмам триангуляции, главным достоинством которого является простота его реализации. Так, например, в библиотеке компьютерного зрения OpenCV существует готовая реализация данного алгоритма в методе triangulatePoints.

Линейный метод наименьших квадратов также относится к линейным и состоит в том, что система однородных уравнений (7) сводится к системе, состоящей из неоднородных уравнений, для решения которой используется метод наименьших квадратов.

L2 триангуляция является итеративным методом трехмерной реконструкции, решение которой сводится к минимизации ошибки перепроецирования:

У d ( x , x i ) ^ min,

где xi — координата проекции оцениваемой точки на изображении; xi — координата проекции, вычисленная по формуле (4) для уже рассчитанной пространственной точки; d(•) — расстояние между двумя точками.

Алгоритм оптимальной (полиномиальной) триангуляции относят к неитеративным подходам. Для его решения требуется полином шестого порядка. Критерий минимизации для выполнения трёхмерной реконструкции в данном методе можно определить следующим образом:

E d ( x i , X i ) ^ min, (9)

где X i — эпиполярная линия, соответствующая точке x i .

При использовании системы из двух камер для минимизации ошибки (9) необходимо выполнить следующую последовательность действий:

-

- параметризировать пучок эпиполярных линий на первом изображении с помощью параметра t . Таким образом эпиполярная линия на первом изображении может быть выражена как X 0 ( t );

-

- используя фундаментальную матрицу F , вычислить соответствующую эпиполярную линию X 1 ( t ) на втором изображении;

-

- выразить функцию расстояния (9) как функцию от t ;

-

- выполнить поиск значения t , при котором (9) стремится к минимуму.

Используя методы элементарного исчисления, можно свести решение задачи минимизации к нахождению корней полинома шестого порядка. Вычисление предполагаемой пространственной точки осуществляется с помощью метода прямого линейного переноса (DLT) [17].

Подводя итог третьему этапу, получим, что после успешного решения системы (7) и получения мировых координат ключевых точек целевого объекта (тела человека) формируется следующее множество точек H :

H = { X JV i ( xy = PX? ) } , (10)

где X j — мировые координаты скелетной точки тела человека, полученные после решения задачи триангуляции, выраженные в сантиметрах.

Таким образом, задача оптимизации в данном исследовании при использовании двух камер сводится к нахождению такого метода триангуляции MT : { x j } ^ H , при котором ошибка перепроецирования стремится к минимуму:

2 K

ЕЕ d ( x4 , x4 )

R = ij-- > min. (11)

K

Результаты исследования . Решение задачи оптимизации (11) осуществляется при выполнении триангуляции двумерных точек объекта, полученных с изображений нескольких камер, в рамках данного исследования — с двух камер с использованием различных алгоритмов, перечисленных в предыдущем разделе.

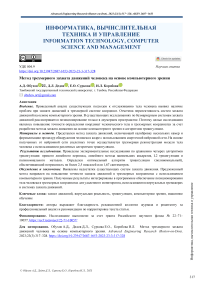

Перечисленные методы триангуляции были реализованы с использованием библиотек OpenCV и NumPy. Для сравнения алгоритмы были интегрированы в программное обеспечение, реализующее метод трёхмерного захвата движений. Пример работы метода для реконструкции всего скелета человека представлен на рис. 1.

Рис. 1. Пример работы метода, включающий распознавание человека на двух камерах и построение трёхмерного скелета

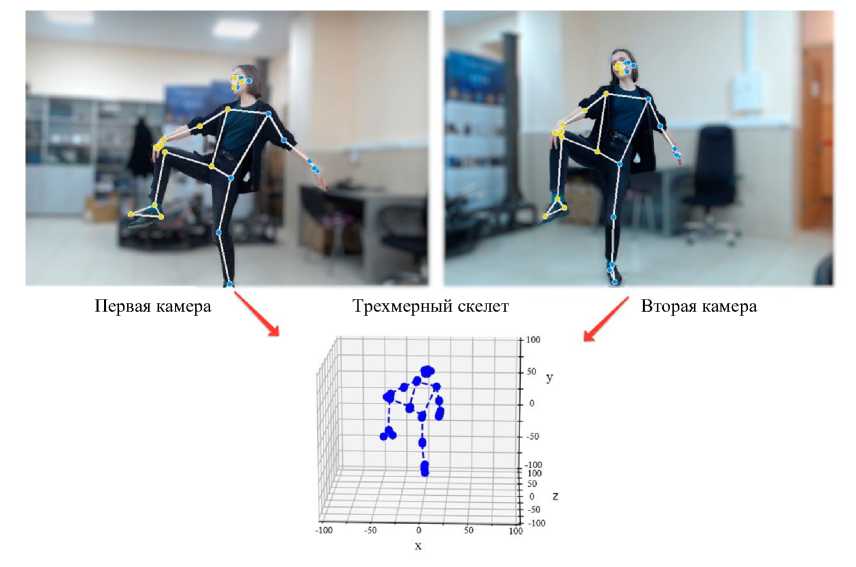

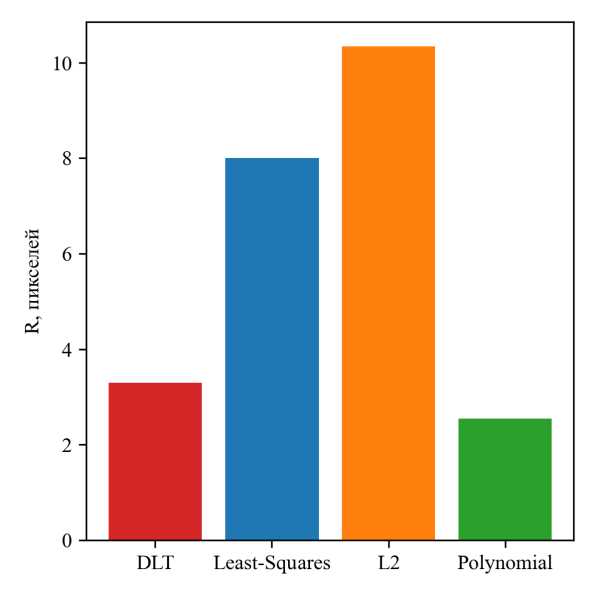

Затем было выполнено сравнение данных алгоритмов по значению функции ошибки перепроецирования (11) для всех точек скелета с двух изображений. Проведено сравнение выбранных методов триангуляции по величине ошибки, а также по времени получения решения (вычислительной сложности) для всей совокупности точек скелета. Сводные сравнительные диаграммы представлены на рис. 2.

а)

Рис. 2. Сравнение методов триангуляции по метрикам: а — по ошибке перепроецирования; б — по времени вычислений

б)

Для выбранных методов триангуляции также проведен ряд экспериментальных тестов, в ходе которых для каждого подхода замерялись рассчитанные длины конечностей пользователя и абсолютное отклонение полученных значений от реальных. Сравнение представлено в таблице 1.

Таблица 1

Сравнение точности определения размеров конечностей в процессе триангуляции

|

Сегмент тела |

DLT |

Least-Squares |

L2 |

Polynomial |

Реальное значение |

|

Предплечье |

25,2 ± 1,6 |

30,8 ± 0,2 |

26,6 ± 0,5 |

24,3 ± 0,4 |

26 |

|

Голень |

42,2 ± 2,0 |

65,3 ± 1,1 |

44,6 ± 0,7 |

38,7 ± 1,8 |

41 |

|

Бедро |

45,7 ± 2,7 |

59,5 ± 0,49 |

48,7 ± 1,3 |

44,1 ± 0,6 |

45 |

|

Среднее отклонение |

2,43 |

14,58 |

2,26 |

1,67 |

0 |

|

Представлены средние значения (в сантиметрах) после в выборке из 10 измерений ± среднее отклонение в выборке |

|||||

Разработанное программное обеспечение включает следующие модули:

-

- для работы с устройствами ввода (камерами);

-

- для выполнения калибровки и получения основных параметров камер;

-

- для синхронизации нескольких камер;

-

- для распознавания объектов (тело и руки пользователя);

-

- для анализа расположения найденных скелетных точек;

-

- для построения визуализации в режиме реального времени.

При реализации программного обеспечения использовался язык программирования Python, библиотеки OpenCV и Matplotlib. Функционирование системы осуществляется в нескольких потоках: один отвечает за получение данных с камер, второй — за визуализацию, третий — за отправку полученных мировых координат тела человека во внешние системы или модули. Использование унифицированного протокола с пакетом данных в формате JSON позволяет интегрировать программное обеспечение в сторонние системы (например, игровые среды разработки Unity, Unreal Engine и т.д.) [20, 21].

Информатика, вычислительная техника и управление

Обсуждение и заключение. Проанализируем результаты сравнения алгоритмов триангуляции по выбранным метрикам, представленные на рис. 2 и в таблице 1.

В ходе сравнения обнаружено, что оптимальным алгоритмом для трехмерной реконструкции является полиномиальный метод. Значение ошибки составляет порядка 2,55 пикселей. В реальных испытаниях при определении роста человека ошибка составила не более 3 %, с учетом того, что MediaPipe Pose не фиксирует верхнюю точку головы и она рассчитывается примерно на основе положения глаз. При измерении конечностей погрешность составила от 0,9 см до 2,3 см, средняя — 1,67 (таблица 1). Таким образом, реальные испытания подтверждают правильность выбора полиномиального метода.

Далее сравним полученные результаты с существующими исследованиями, например, описанными в работе [22]. Авторы также используют обученные сети (OpenPose) для реализации безмаркерной системы распознавания человека, процедуру калибровки камер, извлечение скелетных точек, но располагают камеры рядом друг с другом для имитации стереозрения. Это ключевое отличие позволяет распознавать в рамках данного исследования позы человека, когда одни части тела перекрывают другие. Кроме того, использование MediaPipe Pose позволяет отслеживать 33 скелетные точки, а не 18, как в методе на основе OpenPose. Полученные значения ошибок в целом соответствуют существующим исследованиям (наилучший результат в работе [22] составляет 2 см), что позволяет сделать вывод о возможности практического использования предложенного подхода. Прочие безмаркерные системы, например, на основе Kinect [23], также показывают сравнимые результаты по величине погрешности измерений (2–5 см). Таким образом, полученное решение в целом соответствует по точности существующим разработкам.

Сравнение времени вычисления набора точек, представленное на рис. 2 справа, показывает, что алгоритм DLT обеспечивает наибольшую производительность, однако, все алгоритмы показывают приемлемые результаты (для обеспечения быстродействия в 30 и даже 60 кадров в секунду). Поэтому данная метрика не является определяющей.

Разработанное программное обеспечение может использоваться в различных предметных областях прежде всего, как замена систем захвата движений, основанных на инерциальных датчиках. Преимуществами предлагаемого решения являются низкие экономические затраты на реализацию и доступность (переход от узкоспециализированных костюмов motion capture к распространенным средствам на основе камер), возможность параллельного захвата моделей тел нескольких пользователей [24].

Научная новизна исследования состоит в комплексном подходе к формализации процесса трехмерного позиционирования человека с использованием технологий компьютерного зрения, включая предварительную калибровку набора из нескольких камер, формализацию процедур обнаружения человека в кадре с использованием произвольной нейронной сети для получения скелетных точек, а также расчет трехмерной реконструкции модели тела человека с использованием различных алгоритмов триангуляции. Исследование включает все необходимые расчетные формулы и подробно изложенные этапы, позволяющие достичь поставленной цели — повышения точности определения поз и координат человеческого тела в трехмерных координатах с использованием технологий компьютерного зрения. Представленные теоретические результаты достаточно универсальны и могут быть использованы для практической реализации систем захвата движений, основанных на различных моделях нейронных сетей, а не только MediaPipe Pose.

Список литературы Метод трехмерного захвата движений человека на основе компьютерного зрения

- Lind C.M., Abtahi F., Forsman M. Wearable Motion Capture Devices for the Prevention of Work-Related Musculoskeletal Disorders in Ergonomics – An Overview of Current Applications, Challenges, and Future Opportunities. Sensors. 2023;23(9):4259. https://doi.org/10.3390/s23094259

- Sers R., Forrester S., Moss E., Ward S., Ma J., Zecca M. Validity of the Perception Neuron Inertial Motion Capture System for Upper Body Motion Analysis. Measurement. 2020;149:107024. http://dx.doi.org/10.1016/j.measurement.2019.107024

- Bauer P., Lienhart W., Jost S. Accuracy Investigation of the Pose Determination of a VR System. Sensors. 2021;21(5):1622. http://dx.doi.org/10.3390/s21051622

- Irshad M.T., Nisar M.A., Gouverneur P., Rapp M., Grzegorzek M. AI Approaches towards Prechtl’s Assessment of General Movements: A Systematic Literature Review. Sensors. 2020;20(18):5321. http://dx.doi.org/10.3390/s20185321

- Merriaux P., Dupuis Y., Boutteau R., Vasseur P., Savatier X. A Study of Vicon System Positioning Performance. Sensors. 2017;17(7):1591. https://doi.org/10.3390/s17071591

- Nakano N., Sakura T., Ueda K., Omura L., Kimura A., Iino Y., et al. Evaluation of 3D Markerless Motion Capture Accuracy Using OpenPose with Multiple Video Cameras. Frontiers in Sports and Active Living. 2020;2:50. https://doi.org/10.3389/fspor.2020.00050

- Coronado E., Fukuda K., Ramirez-Alpizar I.G., Yamanobe N., Venture G., Harada K. Assembly Action Understanding from Fine-Grained Hand Motions, a Multi-camera and Deep Learning Approach. In: Proc. IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS). New York, NY: IEEE; 2021. P. 2628−2634. http://dx.doi.org/10.1109/IROS51168.2021.9636715

- Tausif Diwan, Anirudh G., Tembhurne J.V. Object Detection Using YOLO: Challenges, Architectural Successors, Datasets and Applications. Multimedia Tools and Applications. 2023;82(6):9243–9275. https://doi.org/10.1007/s11042-022-13644-y

- Wei Liu, Anguelov D., Erhan D., Szegedy C., Reed S., Cheng-Yang Fu., et al. SSD: Single Shot MultiBox Detector. In book: Leibe B., Matas J., Sebe N., Welling M. (eds). Computer Vision – ECCV 2016. Cham: Springer. 2016;9905:21–37. https://doi.org/10.1007/978-3-319-46448-0_2

- Bharati P., Pramanik A. Deep Learning Techniques—R-CNN to Mask R-CNN: A Survey. In book: Das A., Nayak J., Naik B., Pati S., Pelusi D. (eds). Computational Intelligence in Pattern Recognition. New York, NY: Springer. 2020;999:657–668. http://dx.doi.org/10.1007/978-981-13-9042-5_56

- Bajpai R., Joshi D. MoveNet: A Deep Neural Network for Joint Profile Prediction across Variable Walking Speeds and Slopes. IEEE Transactions on Instrumentation and Measurement. 2021;70:1–11. http://dx.doi.org/10.1109/TIM.2021.3073720

- Ghanbari S., Ashtyani Z.P., Masouleh M.T. User Identification Based on Hand Geometrical Biometrics Using Media-Pipe. In: Proc. 30th International Conference on Electrical Engineering (ICEE). New York, NY: IEEE; 2022. P. 373–378. http://dx.doi.org/10.1109/ICEE55646.2022.9827056

- Weijian Mai, Fengjie Wu, Ziqian Guo, Yuhan Xiang, Gensheng Liu, Xiaobin Chen. A Fall Detection Alert System Based on Lightweight Openpose and Spatial-Temporal Graph Convolution Network. Journal of Physics: Conference Series. 2021;2035:012036. http://dx.doi.org/10.1088/1742-6596/2035/1/012036

- Szeliski R. Recognition. In book: Computer Vision: Algorithms and Applications. London: Springer; 2011. P. 575–640. https://doi.org/10.1007/978-1-84882-935-0_14

- Kahl F., Hartley R. Multiple-View Geometry Under the L∞-Norm. IEEE Transactions on Pattern Analysis and Machine Intelligence. 2008;30(9):1603–1617. http://dx.doi.org/10.1109/TPAMI.2007.70824

- Luhmann T., Fraser C., Maas H.-G. Sensor Modelling and Camera Calibration for Close-Range Photogrammetry. ISPRS Journal of Photogrammetry and Remote Sensing. 2016;115:37–46. https://doi.org/10.1016/j.isprsjprs.2015.10.006

- Кудинов И.А., Павлов О.В., Холопов И.С. Реализация алгоритма определения пространственных координат и угловой ориентации объекта по реперным точкам, использующего информацию от одной камеры. Компьютерная оптика. 2015;39(3):413–419. https://doi.org/10.18287/0134-2452-2015-39-3-413-419

- Jen-Li Chung, Lee-Yeng Ong, Meng-Chew Leow. Comparative Analysis of Skeleton-Based Human Pose Estimation. Future Internet. 2022;14(12):380. https://doi.org/10.3390/fi14120380

- Jia Chen, Dongli Wu, Peng Song, Fuqin Deng, Ying He Y., Shiyan Pang. Multi-View Triangulation: Systematic Comparison and an Improved Method. IEEE Access. 2020;8:21017–21027. http://dx.doi.org/10.1109/ACCESS.2020.2969082

- Obukhov A., Dedov D., Volkov A., Teselkin D. Modeling of Nonlinear Dynamic Processes of Human Movement in Virtual Reality Based on Digital Shadows. Computation. 2023;11(5):85. https://doi.org/10.3390/computation11050085

- Abella J., Demircan E. A Multi-Body Simulation Framework for Live Motion Tracking and Analysis within the Unity Environment. In: Proc. 16th International Conference on Ubiquitous Robots (UR). New York, NY: IEEE; 2019. P. 654–659. http://dx.doi.org/10.1109/URAI.2019.8768659

- Zago M., Luzzago M., Marangoni T., De Cecco M., Tarabini M., Galli M. 3D Tracking of Human Motion Using Visual Skeletonization and Stereoscopic Vision. Frontiers in Bioengineering and Biotechnology. 2020;8:181. https://doi.org/10.3389/fbioe.2020.00181

- Latorre J., Llorens R., Colomer C., Alcañiz M. Reliability and Comparison of Kinect-Based Methods for Estimating Spatiotemporal Gait Parameters of Healthy and Post-Stroke Individuals. Journal of Biomechanics. 2018;72:268–73. https://doi.org/10.1016/j.jbiomech.2018.03.008

- Обухов А.Д., Волков А.А., Вехтева Н.А., Патутин К.И., Назарова А.О., Дедов Д.Л. Метод формирования цифровой тени процесса перемещения человека на основе объединения систем захвата движений. Информатика и автоматизация. 2023;22(1):168–189. https://doi.org/10.15622/ia.22.1.7