Моделирование социально-экономических последствий государственного управления в сфере этических стандартов использования ИИ-технологий

Автор: Плотников В.А., Буташин Д.А., Игнатьев С.А.

Журнал: Известия Санкт-Петербургского государственного экономического университета @izvestia-spgeu

Рубрика: Государственное регулирование экономики

Статья в выпуске: 5 (155), 2025 года.

Бесплатный доступ

Инкорпорация этических стандартов в технологии искусственного интеллекта (ИИтехнологии) представляет собой пока еще слабо разработанную, но крайне важную область исследований, особенно в российском контексте. По мере усиления глобальной технологической конкуренции, обеспечение технологического суверенитета и достижение стратегических преимуществ требуют всесторонней оценки социально-экономических последствий внедрения этических норм в сферу ИИ. Данное исследование направлено на разработку модели, позволяющей анализировать влияние этических стандартов в ИИ на ключевые экономические и социальные показатели. В рамках работы определяются основные параметры моделирования, включая регуляторное воздействие, адаптацию рынка, трансформацию рынка труда и динамику инновационного развития, а также рассматриваются основные риски, такие как регуляторные барьеры, экономическая неэффективность и потенциальное замедление технологического прогресса. Полученные результаты предлагают структурированный подход к оценке долгосрочных последствий этического регулирования ИИ и могут послужить в качестве практических рекомендаций для разработчиков государственной политики в данной области, а также для представителей индустрии для обеспечения сбалансированной интеграции этических принципов и экономических приоритетов, в конечном счете, позволив России обеспечить укрепление ее позиций в глобальном ИИ-пространстве в условиях обостряющейся глобальной технологической конкуренции.

Искусственный интеллект, технологический суверенитет, этические стандарты, моделирование рисков, технологическая конкуренция, правовые ограничения, социально-экономическое развитие

Короткий адрес: https://sciup.org/148332157

IDR: 148332157

The public administration's socio-economic consequences modeling in the field of the AI technologies using ethical standards

The incorporation of ethical standards into artificial intelligence (AI) technologies represents a largely underdeveloped yet critically important research area, particularly within the Russian context. As global technological competition intensifies, ensuring technological sovereignty and achieving strategic advantages require a comprehensive assessment of the socio-economic impacts of integrating ethical norms into the AI domain. This study aims to develop a model for analyzing the influence of ethical standards in AI on key economic and social indicators. The research identifies the main modeling parameters, including regulatory impact, market adaptation, labor market transformation, and innovation development dynamics. Additionally, it examines major risks such as regulatory barriers, economic inefficiencies, and potential slowdowns in technological progress. The findings propose a structured approach to evaluating the long-term consequences of AI ethical regulation. They can serve as practical recommendations for policymakers in this field, as well as for industry representatives seeking to balance ethical principles with economic priorities. Ultimately, this will enable Russia to strengthen its position in the global AI landscape amid increasing global technological competition.

Текст научной статьи Моделирование социально-экономических последствий государственного управления в сфере этических стандартов использования ИИ-технологий

В последние годы наблюдается стремительный рост исследований в области этики искусственного интеллекта (ИИ), а регулирование этических стандартов в данной сфере вышло на глобальный уровень. В этом процессе активное участие принимают такие международные организации, как ЮНЕСКО, а также крупнейшие технологические корпорации. Формирование глобальных этических стандартов направлено на обеспечение ответственного и безопасного развития ИИ, однако оно также становится инструментом глобальной экономической конкуренции.

Этические нормы содержат в себе ценностные установки и экономико-правовые ограничения, которые могут оказывать влияние на темпы технологического развития отдельных стран и их конкурентоспособность в сфере передовых технологий. В условиях возрастающей конкуренции на международной арене необходимо учитывать возможные последствия внедрения этих стандартов, а также их влияние на внутренние процессы модернизации и научно-технического развития. Для Российской Федерации процесс апперцепции и инкорпорации международных стандартов в области ИИ представляет собой сложное и многогранное проблемное поле. Это связано как с особенностями национальной правовой системы и этических ценностей, так и с историческим опытом заимствования зарубежных моделей модернизации и инновационного развития.

Несомненно, необходимо учитывать специфику отечественной государственности, дабы при попытках «имплантации институтов», как это происходило в 1990-е гг., не произошло их отторжение, вызвавшее кризисные явления. В то же время, полное игнорирование глобальных тенденций способно привести к изоляции и снижению конкурентоспособности отечественных разработок на международной арене. В связи с этим возникает необходимость сбалансированного развития на базе критического подхода к адаптации международных норм и разработке национального кодекса этики в сфере ИИ, который будет учитывать специфику российской экономики, права и социальной структуры. Создание такого кодекса требует междисциплинарного подхода, включающего анализ правовых норм, экономических последствий и этических аспектов. Опыт зарубежных стран, таких как Китай, США и страны ЕС, показывает, что эффективная этическая политика в сфере ИИ требует не только разработки регуляторных механизмов, но и выстраивания комплексной стратегии взаимодействия между государством, бизнесом и обществом. Такой подход позволит выработать сбалансированную систему этических норм, которая не только обеспечит защиту прав граждан, стабильность экономики, социальной сферы [1], но и будет способствовать развитию отечественных технологий и расширению их присутствия на мировых рынках.

Настоящее исследование направлено на выявление ключевых рисков, связанных с внедрением зарубежных стандартов этики ИИ, а также на определение основных параметров модели, обеспечивающей эффективную конвергенцию международных этических норм и национальных институтов. Разработка такой модели позволит сбалансировать этические принципы с экономическими приоритетами, обеспечивая устойчивое социально-экономическое развитие страны и её конкурентные преимущества в условиях глобальной технологической конкуренции. В ходе исследования проведен анализ механизмов регулирования, а также рассмотрены возможные сценарии развития данной сферы в России, с уче- том глобальных тенденций и национальных особенностей. Полученные результаты могут стать основой для формирования государственной политики в области этического регулирования ИИ, а также способствовать выработке стратегий развития отрасли, соответствующих национальным интересам. Материалы и методы

Моделирование социально-экономических последствий внедрения этических стандартов основано на использовании системного подхода, который позволяет рассматривать данную проблему в контексте взаимосвязанных факторов и их влияния на различные аспекты общественной и экономической жизни. Это обеспечивает всесторонний анализ проблемы, охватывающий широкий спектр взаимосвязанных процессов, связанных как с развитием технологий искусственного интеллекта, так и с их воздействием на социальную структуру общества, экономическую устойчивость и правовое регулирование. При этом авторы обращались к различным вариантам организации моделирования социально-экономических явлений, в том числе к теоретическим составляющим семиотического и цепочечного анализа, модели как системы [2, 3].

В качестве методологической базы исследования использованы базовые экономические и правовые концепции, отдельные достижения философии науки и техники, а также социологическое знание, что обеспечивает многогранный анализ проблемы, позволяющий выявить ключевые закономерности и тенденции в области внедрения этических норм в ИИ-сферу. Для обеспечения комплексного анализа проведена проработка тематической научной литературы, что позволило выявить ключевые подходы к проблеме регулирования и внедрения этических стандартов в сфере искусственного интеллекта. В процессе анализа изучены современные публикации в научных журналах, монографии, исследовательские доклады, которые охватывают как теоретические аспекты формирования этических стандартов, так и практические кейсы их применения в различных странах.

Отдельное внимание уделено изучению разработанных рекомендаций ЮНЕСКО в области этики искусственного интеллекта [4], что позволило соотнести международные стандарты с национальными особенностями регулирования ИИ-технологий. Проанализированы ключевые положения данных рекомендаций, их потенциальное влияние на формирование нормативно-правовой базы Российской Федерации и возможность адаптации к национальным условиям. Также исследованы основные характеристики положения Российской Федерации на глобальном рынке ИИ-технологий, что дало возможность выявить ключевые вызовы и конкурентные преимущества страны в данной сфере. В ходе анализа рассматривались такие параметры, как уровень технологического развития, уровень инвестиций в сферу ИИ, кадровый потенциал, конкурентоспособность российских компаний на международном рынке и степень интеграции российских разработок в глобальные технологические цепочки.

В рамках анализа выявлены основные блоки обеспечения роста технологического потенциала РФ в ИИ-сфере, что является важным фактором для оценки перспектив социально-экономического развития. Рассмотрены ключевые барьеры, включая нехватку финансирования, кадровые проблемы, ограниченный доступ к международному рынку данных и технологий, а также необходимость совершенствования нормативно-правовой базы. Кроме того, проведена оценка возможных сценариев развития отрасли с учетом различных вариантов регулирования и внедрения этических норм. Дополнительно проведена оценка рисков внедрения норм этики в сфере ИИ и их влияния на социально-экономическое развитие.

Рассмотрены возможные негативные последствия как недостаточного, так и чрезмерного регулирования, включая замедление инновационного процесса, снижение инвестиционной привлекательности отрасли и ограничение возможностей для международного сотрудничества. В то же время, изучены потенциальные выгоды, такие как повышение доверия общества к технологиям ИИ, улучшение международного имиджа России как ответственного участника глобального технологического сообщества и создание благоприятных условий для устойчивого развития цифровой экономики. Показана целесообразность формирования специализированного научного центра по данным исследованиям на базе Российской академии наук как ведущей научной корпорации России, являющейся, по мнению Президента РФ В.В. Путина, важнейшим и старейшим объединением ведущих институтов и ученых (см.: .

Основные результаты и их обсуждение

Экспоненциальный рост технологий искусственного интеллекта представляет собой одну из ключевых проблем для разработки моделей прогнозирования социально-экономических рисков. Высокие темпы развития ИИ приводят к постоянному изменению условий, областей и границ его применения, что делает традиционные прогнозные методы менее эффективными. Инновационные решения в области машинного обучения, автоматизированного принятия решений и анализа данных стремительно внедряются в различные сектора экономики, включая финансы, медицину, промышленность и государственное управление. В результате возникает необходимость учитывать широкий спектр факторов, таких как технологическая зрелость, степень интеграции ИИ в общественные процессы, уровень нормативного регулирования и международные тренды, что усложняет построение устойчивых прогнозных моделей.

Трудности разработки моделей прогнозирования социально-экономических рисков также связаны с тем, что ИИ-индустрия является глобальной и чрезвычайно интернационализированной. Внедрение этических стандартов на национальном уровне может повлиять на конкурентоспособность отдельных стран, создавая барьеры для международного сотрудничества или ограничивая доступ к критически важным технологиям. Например, более жесткие требования к использованию данных и алгоритмов в одной стране могут сделать ее менее привлекательной для технологических инвесторов по сравнению с юрисдикциями, где регулирование менее строгое. Это приводит к необходимости поиска компромиссов между обеспечением этической устойчивости и сохранением конкурентоспособности на мировом рынке ИИ-технологий, а также требует учета уровня готовности различных сфер деятельности к внедрению ИИ-технологий [5].

Кроме того, тонкость грани между этическими ограничениями и экономической эффективностью требует разработки баланса между инновациями и социальными рисками. С одной стороны, жесткое регулирование может замедлить разработку и внедрение передовых ИИ-решений, в том числе тех, которые способны существенно повысить качество жизни людей. С другой стороны, отсутствие четких этических рамок может привести к злоупотреблениям, росту социальной поляризации и усилению неравенства. Важным аспектом является контроль за разработками программных средств ИИ на предмет учета в них этических норм, и особое внимание здесь требуется сфере генеративного ИИ, где соответствующие риски довольно высоки. В связи с этим, разработка прогнозных моделей должна учитывать не только текущую ситуацию, но и возможные сценарии развития, адаптируясь к динамически изменяющимся условиям технологического прогресса и глобального экономического взаимодействия.

По мнению члена-корреспондента РАН М.В. Федорова [6], с момента появления концепции искусственного интеллекта в середине XX века технологический прогресс достиг беспрецедентных масштабов. Интерес к ИИ продолжает расти, что подтверждается огромным количеством научных публикаций и зарегистрированных патентов. Особенно интенсивное развитие этой области наблюдается в последние годы: согласно данным аналитических платформ Statista и Dimensions, более половины патентных заявок в сфере ИИ были поданы в течение последнего десятилетия. Такой стремительный рост свидетельствует о динамичной трансформации технологий и их углубляющемся влиянии на различные отрасли науки и экономики.

Масштаб происходящих технологических изменений настолько значителен, что даже научное сообщество не всегда успевает адаптироваться к стремительно развивающимся процессам. Количество исследований, направленных на изучение возможностей и ограничений ИИ, постоянно увеличивается, однако скорость практических внедрений новых алгоритмов и моделей существенно опережает темпы академических дискуссий. Это создает новые вызовы, связанные как с этическими аспектами применения ИИ, так и с проблемами нормативного регулирования. Важно учитывать, что современные технологии способны оказывать трансформационное влияние не только на отдельные отрасли, но и на глобальную экономику в целом.

Кроме того, сложность прогнозирования социально-экономических последствий внедрения этических стандартов в сфере ИИ обусловлена высокой степенью интернационализации данной отрасли. Искусственный интеллект уже стал неотъемлемой частью мировой технологической экосистемы, и национальные решения в области его регулирования неизбежно оказывают влияние на глобальные процессы. Введение жестких ограничений в отдельных странах может либо замедлить инновационное развитие, либо, напротив, стимулировать перенос технологических инициатив в менее регулируемые

(оставляющие больше пространства для манёвра) юрисдикции. Таким образом, поиск баланса между развитием и контролем остается одной из ключевых задач в данной сфере, требующей взвешенного подхода и международного сотрудничества.

Масштабное внедрение технологий ИИ происходит и в систему управления социально-экономическими процессами, создавая, помимо очевидных преимуществ, сложный комплекс вызовов и рисков. Среди ключевых угроз – потенциальная технологическая зависимость от иностранных разработчиков, сложные этические проблемы [7], связанные с обработкой персональных данных граждан, пробелы в правовом регулировании, а также необходимость обеспечения комплексной информационной безопасности. Дополнительно автоматизация и алгоритмизация управленческих процессов могут привести к снижению влияния человеческого фактора, что чревато усилением бюрократизации и формализацией государственных решений, а также созданием новых этических дилемм.

Для России особенно важно развитие независимых ИИ-решений, отвечающих национальным стратегическим приоритетам, а также выработка соответствующей нормативно-правовой базы, регулирующей применение искусственного интеллекта в государственном и коммерческом секторах, где в основном и формируются коллизии и проблемы морального выбора, генерируя интенсивную научную и профессиональную полемику [8]. Проведенный анализ позволил выделить следующие основные элементы моделирования, рассматриваемого нами в качестве имитации конкретных процессов, явлений или объектов в определенной среде [9], социально- экономических последствий внедрения норм этики в сфере ИИ в России (см. рисунок 1):

Рис. 1. Основные блоки моделирования социально-экономических рисков при внедрении этических ограничителей в IT-индустрию (разработано авторами)

-

1. Регуляторная среда и нормативно-правовое регулирование. Одним из ключевых элементов моделирования является анализ законодательства и регулирующих норм, направленных на внедрение этических стандартов в сфере ИИ. В России это включает в себя законы о персональных данных, инициативы по развитию отечественного ИИ, а также регулирование ответственности за решения, принимаемые алгоритмами. Поскольку моделирование процессов при решении той или иной задачи может быть поликомпонентным [10], данный элемент моделирования позволяет прогнозировать риски, связанные с правовыми пробелами, возможным ужесточением регулирования, а также трудностями в адаптации бизнеса к новым требованиям. В этом отношении особый интерес представляют документы стратегического планирования (Указ Президента Российской Федерации от 21.07.2020 г. № 474 «О националь-

ных целях развития Российской Федерации на период до 2030 года», Указ Президента Российской Федерации от 10.10.2019 г. № 490 «О развитии искусственного интеллекта в Российской Федерации», распоряжение Правительства Российской Федерации от 16 марта 2024 г. № 637-р «Об утверждении стратегического направления в области цифровой трансформации государственного управления», Кодекс этики в сфере искусственного интеллекта, см.: https://base.garant.ru/406862712 , и др.).

-

2. Экономическое воздействие на IT-отрасль [11]. Введение этических норм в разработку и использование ИИ неизбежно влияет на экономическую среду IT-индустрии. Компании могут нести дополнительные затраты на аудит алгоритмов, разработку прозрачных моделей и обеспечение безопасности данных. В рамках моделирования оцениваются возможные последствия таких изменений: снижение конкурентоспособности отечественных разработчиков на международном рынке, рост стоимости продуктов на основе ИИ и потенциальное замедление инноваций из-за более строгих требований.

-

3. Социальные эффекты и влияние на рынок труда. Этические нормы в сфере ИИ затрагивают не только компании, но и работников, пользователей технологий и общество в целом [12]. Необходимо избежать повышения социальной напряженности, перекосов в обеспечении трудовыми ресурсами и занятости населения в различных сферах экономики и в регионах страны. Приоритет внедрения технологий ИИ должен быть акцентирован на отрасли, испытывающие дефицит кадров, имеющие высокий порог их восполнения, где перепрофилирование рабочей силы требует значительного времени и ресурсов. Моделирование этого аспекта позволяет спрогнозировать возможное изменение структуры занятости, рост спроса на специалистов по этике ИИ и правовому регулированию, а также риски социального неравенства, вызванного автоматизацией рабочих процессов. Кроме того, анализируется влияние этических норм на доверие общества к ИИ-решениям и уровень их принятия. Отдельное внимание необходимо уделять внедрению инновационных технологий, в том числе ИИ, в социальную сферу – там, где требуется эмпатия, необходимо очень аккуратно внедрять технологии, чтобы не осуществить подмену оказания социальных услуг населению, решения острых жизненных ситуаций граждан строго бюрократическими подходами и проведением процедур исключительно по формализованным шаблонам (например, как это происходит при использовании чат-ботов [13]).

-

4. Технологические аспекты и адаптация алгоритмов. Речь в данном случае идет о том, что этические вопросы и механизмы их разрешения должны быть «зашиты» на технологическом, алгоритмическом уровне в виде системы базовых ограничений и руководящих принципов для ИИ, которые не могут быть скорректированы или отменены в процессе машинного обучения на новых массивах данных. ИИ, помимо решения собственно технических (хотя и интеллектуально ёмких) задач, что базируется на правилах формальной логики и математических расчетах, должен учитывать гуманистические принципы справедливости и человекоцентричности, хотя эти понятия в современной науки еще и не получили исчерпывающего системного описания. Следствием этого может стать «конфликт физиков и лириков», известный из социальной практики, воспроизведенный при помощи ИИ. Методы разрешения этого конфликта еще только предстоит разработать, пока же он является одним из существенных источников рисков

-

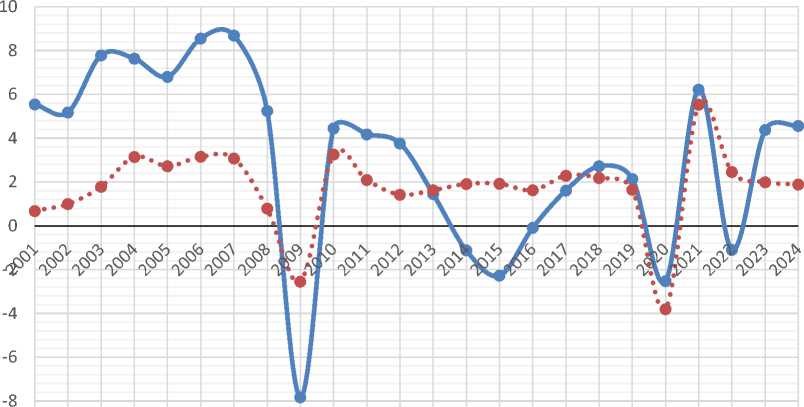

5. Геополитические и конкурентные вызовы. Современный мир находится в турбулентной стадии своего развития, эти процессы проявляются и в России (на рисунке 2, для иллюстрации, приведен построенный по данным Всемирного Банка график среднедушевого ВВП (в процентах к предыдущему году) для России и для мира в целом на протяжении XXI века, где прослеживается ярко выраженная колебательная и разнонаправленная динамика). Указанная турбулентность проявляется во всех сферах, затрагивает она и технологическую область, в частности, развитие национальных моделей ИИ, где инкорпорирование этических норм может играть как стимулирующую, так и дестимулирующую роль. В рамках моделирования анализируются возможные риски, связанные с ограничением доступа к иностранным технологиям, сложностью интеграции российских этических стандартов с международными требованиями и усилением конкуренции со стороны стран, где регулирование менее жесткое.

Одним из ключевых инструментов государственного регулирования для оценки и моделирования социально-экономических рисков внедрения этических стандартов в сфере искусственного интеллекта является создание специализированных аналитических центров и лабораторий на базе государственных и академических институтов. Такие структуры могут заниматься разработкой методик оценки влияния этических норм на развитие ИИ-индустрии, анализом рисков технологического отставания и подготовкой стратегических рекомендаций для органов власти. Например, Национальный центр развития ИИ или профильные исследовательские институты при ведущих университетах могут разрабатывать сценарные прогнозы, моделируя различные варианты регулирования отрасли. Важным аспектом их работы может стать экономическое моделирование последствий внедрения жестких этических стандартов, это позволить оценивать потенциальные потери бизнеса, снижение инвестиционной привлекательности сектора или сокращение рабочих мест в высокотехнологичных отраслях.

-10

Россия • • ^ • • Мир в целом

Рис. 2. Динамика среднедушевого прироста ВВП, % (разработано авторами по данным Всемирного Банка)

Вторым важным механизмом является государственно-частное партнерство (ГЧП) и вовлечение бизнеса в процесс моделирования рисков через отраслевые союзы и ассоциации. Такие платформы, как Ассоциация разработчиков программного обеспечения России или Альянс по искусственному интеллекту, могут выступать посредниками между государством и частными компаниями, помогая адаптировать этические требования к реалиям рынка. Например, можно внедрять пилотные проекты с регуляторными «песочницами», где компании тестируют влияние этических стандартов на свои бизнес-мо-дели в контролируемой среде. Такие решения могут быть интегрированы в систему стратегического планирования на государственном уровне, помогая формировать гибкую политику регулирования, которая одновременно учитывает этические требования и необходимость технологического развития.

Значительную роль в моделировании рисков и разработке этических стандартов в сфере искусственного интеллекта могут сыграть также профильные институты Российской академии наук, на базе которых целесообразно создать специализированный Центр по исследованию этики ИИ и оценке социально-экономических последствий его регулирования. Академическая среда РАН способна на высшем научно-исследовательском уровне обеспечить проведение уникальной научной экспертизы – глубокий междисциплинарный анализ взаимодействия технологических, экономических, правовых и социальных аспектов внедрения ИИ. Создание подобного центра при РАН позволит выстроить научнообоснованный баланс между необходимостью внедрения этических стандартов и задачами достижения технологического суверенитета, обеспечивая России конкурентные преимущества в глобальной гонке ИИ-технологий.

Заключение

Проведенное исследование позволило выявить значимую взаимосвязь между внедрением этических ограничителей, не учитывающих национальные интересы России в сфере искусственного интеллекта, и увеличением рисков, связанных с ослаблением позиций страны в глобальной технологической конкуренции. В условиях стремительного развития ИИ-технологий формирование нормативно-этических рамок приобретает все большее значение, определяя направление научно-технического прогресса и степень доступности новейших разработок для различных государств. Внедрение жестких этических стандартов, вне концепции «разумного самоограничения» [3], ориентированных исключительно на зарубежные (или транснациональные) модели регулирования, может привести к снижению конкурентоспособности отечественных решений, затруднению коммерциализации передовых технологий и усилению технологической зависимости от внешних поставщиков.

Сбалансированное регулирование в сфере ИИ требует учета стратегических интересов страны, поскольку несогласованное применение зарубежных стандартов может ограничивать возможности для инновационного развития и ставить под угрозу достижение национальных целей в области ИИ. В этой связи, особую значимость приобретает разработка научно-теоретического базиса, способного обеспечить системный подход к прогнозированию и управлению рисками, возникающими при внедрении этических норм. Такой подход позволит создать эффективные механизмы моделирования последствий различных сценариев регулирования, оценить потенциальные угрозы и выработать эффективные стратегии для гармонизации этических требований с задачами достижения технологического суверенитета, которые в современных условиях подсанкционного развития существенно обострились [14].

Неотъемлемой частью данной стратегии должна стать разработка универсального российского кодекса этики в сфере ИИ, который обеспечит не только полноценное развитие отечественной индустрии, но и позволит закрепить ее конкурентные преимущества на глобальном технологическом рынке. Такой кодекс должен учитывать национальные приоритеты, балансировать интересы государства, бизнеса и общества, а также быть гибким для адаптации к стремительно меняющимся вызовам в сфере ИИ. Более того, разработка и продвижение российского подхода к этическому регулированию может способствовать интеграции отечественных стандартов в международные процессы выработки этических норм, делая Россию активным участником глобального диалога по формированию ответственного использования ИИ.

Таким образом, для успешного развития отечественной ИИ-индустрии необходимо выстраивание комплексной системы управления рисками, учитывающей как международные тенденции в области этики, так и специфику российской научно-технической среды. Формирование таких механизмов позволит обеспечить устойчивое развитие отрасли, минимизировать риски технологической зависимости и укрепить позиции России в сфере искусственного интеллекта на глобальном уровне. В то же время, эти механизмы не могут функционировать исключительно на рыночной, саморегулируемой основе, их выстраивание и развитие требуют активного государственного участия, что должно найти отражение в реализуемой в России государственной политике.