Обнаружение и классификация дефектов прокатного происхождения на торцах гильз с использованием сверточной нейронной сети

Автор: Билан Иван Тарасович, Трубников Кирилл Вячеславович, Звонарев Дмитрий Юрьевич, Носкова Мария Николаевна

Журнал: Вестник Южно-Уральского государственного университета. Серия: Металлургия @vestnik-susu-metallurgy

Рубрика: Обработка металлов давлением. Технологии и машины обработки давлением

Статья в выпуске: 1 т.23, 2023 года.

Бесплатный доступ

В процессе производства бесшовных труб большое внимание уделяют качеству продукции, которая, в свою очередь, складывается из качества заготовки, качества гильзы и качества черновой трубы. При этом на заднем торце гильз могут возникать различные дефекты формы, которые могут препятствовать внедрению оправки и последующей раскатке гильзы в непрерывном раскатном стане. Также дефекты формы на заднем торце гильзы («корона», «серьга», «шип» и др.) могут спровоцировать аварийный останов. Своевременное информирование вальцовщиков о типе торца гильзы сможет способствовать оперативному принятию решения о корректировке настроечных параметров прошивного стана, что, в свою очередь, приведет к недопущению появления продукции с критическими отклонениями по форме. Один из способов получения информации об объекте (торец трубы) - использование цифровых камер. Поэтому необходимо проанализировать современные возможности применения цифровых камер и способов цифровой обработки изображений с целью определения интересующих характеристик.

Прошивной стан, сверточная нейронная сеть, matlab, машинное зрение, обработка данных

Короткий адрес: https://sciup.org/147240358

IDR: 147240358 | УДК: 621.774.32, | DOI: 10.14529/met230103

Detection and classification of defects of rolling origin on the ends of sleeve using a convolutional neural network

In the process of manufacturing seamless pipes, great attention is paid to the quality of products, which in turn consists of the quality of the workpiece, the quality of the sleeve and the quality of the draft pipe. At the same time, various shape defects can occur at the rear end of the sleeves, which can prevent the introduction of the mandrel and subsequent rolling of the sleeve in a continuous rolling mill. Also, shape defects on the rear end of the sleeve (“crown”, “earring”, “thorn”, etc.) can provoke an emergency stop. Timely informing the millers about the type of the butt end of the sleeve can contribute to the prompt decision-making on adjusting the settings of the piercing mill. Which in turn will lead to the prevention of the appearance of products with critical deviations in shape. One of the ways to obtain information about an object (pipe end) is possible with the use of digital cameras. Therefore, it is necessary to analyze the current possibilities of using digital cameras and digital image processing methods in order to determine the characteristics of interest.

Текст научной статьи Обнаружение и классификация дефектов прокатного происхождения на торцах гильз с использованием сверточной нейронной сети

В последнее время сверточные нейронные сети стали широко применяться в различных областях науки и техники [1–3]. Это обусловлено их высокой эффективностью, стабильностью прогнозируемого результата.

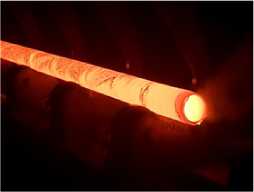

Металлургия, в частности производство бесшовных труб, не стала исключением [4]. Зачастую при производстве труб после прошивки получаемая гильза раскатывается на непрерывных раскатных станах, таких как PQF, FQM. В ходе износа инструмента (валков прошивного стана, оправок, удерживающего инструмента), а также косины реза заднего торца заготовки на гильзах могут образовываться кольцевые отслоения металла (рис. 1), и в процессе раскатки на станах данные отслоения могут привести к появлению неустранимых дефектов на внутренней поверхности труб либо к поломке оборудования. А с учетом расположения оборудования и достаточной отдаленности места наблюдения заднего торца гильзы не всегда удается обнаружить или предупредить такие дефекты.

Применение сверточной нейронной сети позволит организовать работу персонала таким образом, что при появлении критического дефекта персонал сможет своевременно устранить причину появления дефектов.

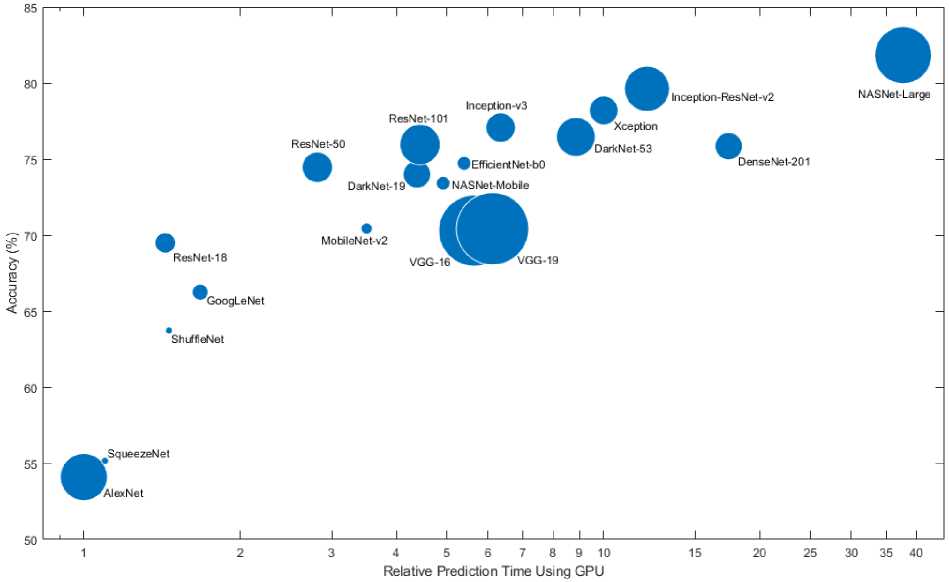

Существует достаточно большое количество архитектур предварительно обученных нейронных сетей для классификации изображений, отвечающих точностью, скоростью обработки данных [5, 6]. Выбор сети обычно является компромиссом между характеристиками (рис. 2).

Как видно из рис. 2, наиболее точной сетью является NASNet-Large, однако она является наименее производительной.

С точки зрения организации системы информирования персонала о появлении дефектов необходима, с одной стороны, точная нейронная сеть и наиболее производительная. Стоит отметить, что обучение нейронных

Рис. 1. Возможный вид полученной гильзы с дефектным задним концом Fig. 1. Possible view of the resulting sleeve with a defective rear end

Рис. 2. Относительная скорость и точность сверточных нейронных сетей [7]

Fig. 2. Relative speed and accuracy of convolutional neural networks [7]

сетей, представленных на рис. 2, происходило на 1000 различных классов, тогда как дефектов прокатного происхождения на заднем торце – ограниченное количество и не превышает 20.

В связи с этим целью работы является определение точности классификации изображений торцов гильз с использованием нейронных сетей.

Существуют различные типы нейронных сетей: одни для классификации изображений, другие – для извлечения признаков.

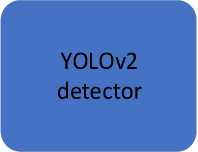

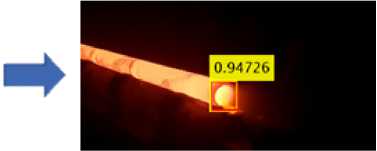

В свою очередь, проанализировав движение гильзы от прошивного стана до непрерывного, было установлено, что для распознавания дефектов необходимо использовать два типа нейронных сетей, а именно нейронная сеть, предназначенная для извлечения признаков, необходима для обнаружения положения торца гильзы, а нейронная сеть для классификации необходима для классификации извлеченного торца гильзы на условные дефектный/недефектный.

Для извлечения признаков и обнаружения торца гильзы наиболее подходит применение сверточной нейронной сети с привязкой со слоями YOLO (you-only-look-once). Модель YOLO запускает сверточную нейронную сеть с глубоким обучением на входном изображении для создания сетевых прогнозов [8, 9]. Детектор объектов декодирует прогнозы и генерирует ограничивающие рамки.

На основе этого была подготовлена нейронная сеть с использованием ResNET50 [10], с привязкой по слоям YOLO (рис. 3). Разметка изображений для последующего обучения нейронной сети и непосредственно обучение нейронной сети проводилось в программном продукте MATLAB.

По результатам обучения точность пред- сказывания наличия торца гильзы на изображении составила более 90 %.

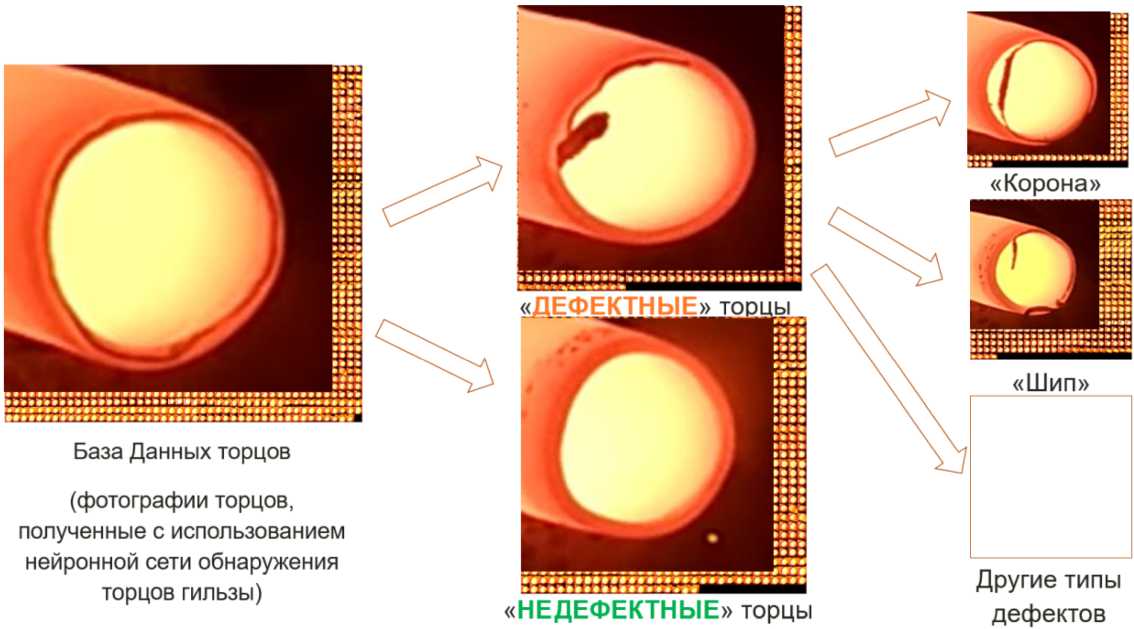

После обучения нейронной сети формировалась база данных торцов гильз. На основе полученной базы данных в ручном режиме база данных была разбита на 3 категории: хорошие торцы; торцы с дефектом «корона»; торцы с дефектом «шип» (рис. 4). Также в дальнейшем полученную базу можно пополнять другими типами дефектов с последующим переобучением нейронной сети.

Для поиска наилучшей нейронной сети по классификации торцов гильз были выбраны несколько, представленных в таблице.

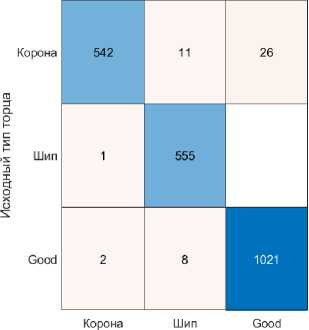

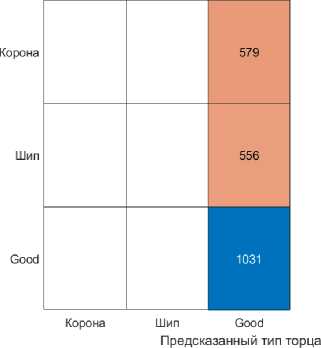

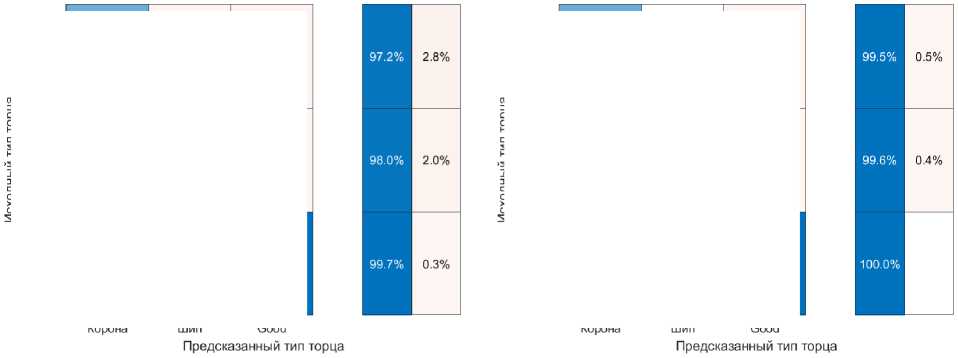

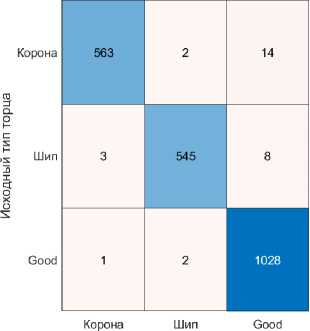

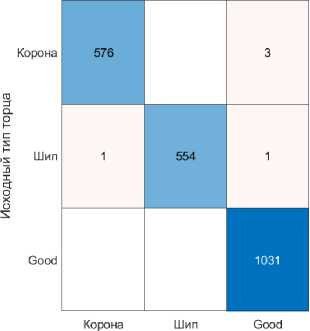

На рис. 5 представлены матрицы ошибок для некоторых нейронных сетей, предназначенных для классификации торцов гильз на одинаковом наборе данных.

Как видно из рис. 5b), нейронная сеть SqueezeNet не может быть использована для классификации торцов гильз, так как все изображения торцов гильз данная нейронная сеть

Входное изображение

Рис. 3. Общая схема сверточной нейронной сети для индентификации торца гильзы Fig. 3. General scheme of a convolutional neural network for identification of the sleeve end

Обработанное изображение

Рис. 4. Общий вид базы данных и классификация на типы торцов Fig. 4. General view of the database and classification into end types

Характеристики нейронных сетей Characteristics of neural networks

|

Название нейронной сети |

Количество слоев |

Количество параметров (миллионов) |

Размер входного изображения |

|

GoogLeNet [11] |

22 |

7,0 |

224-by-224 |

|

MobileNetV2 [12] |

53 |

3,5 |

224-by-224 |

|

ResNet50 [13] |

50 |

25,6 |

224-by-224 |

|

ShuffleNet [14] |

50 |

1,4 |

224-by-224 |

|

DarkNet19 [15] |

19 |

20,8 |

256-by-256 |

|

DarkNet53 [16] |

53 |

41,6 |

256-by-256 |

|

EfficientNetB0 [17] |

82 |

5,3 |

224-by-224 |

|

AlexNet [11] |

8 |

61,0 |

227-by-227 |

|

SqueezeNet [18] |

18 |

1,24 |

227-by-227 |

Предсказанный тип торца

|

93.6% |

|

|

99.8% |

|

|

99.0% |

b)

c)

d)

а)

Рис. 5 . Матрица ошибок при классификации торцов гильз с использованием нейронной сети: a) GoogLeNet; b) SqueezeNet; c) ResNet50; d) AlexNet

Fig. 5. Matrix of errors in the classification of shell ends using a neural network:

a) GoogLeNet; b) SqueezeNet; c) ResNet50; d) AlexNet

определила как бездефектные. Тогда как 3 другие нейронные сети с той или иной точностью могут быть использованы на предсказания типа торца гильзы (бездефектные либо с наличием того или иного типа дефекта).

При анализе эффективности нейронной сети большое значение уделялось параметру быстродействия, в частности быстродействия на компьютерах без использования GPU.

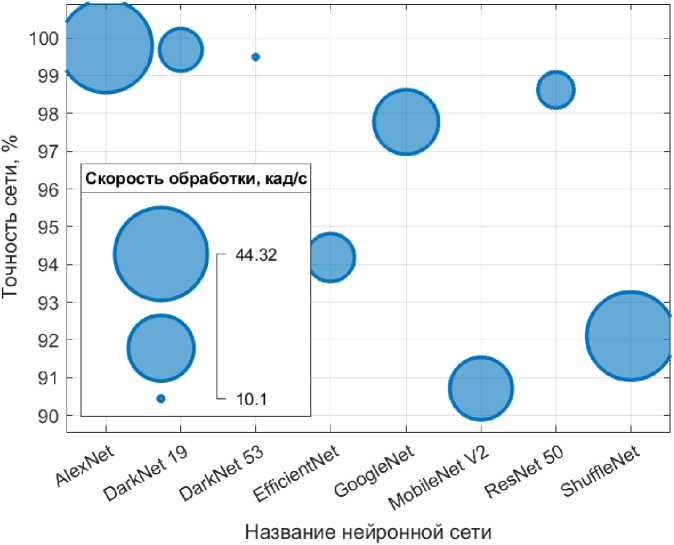

На рис. 6 представлен совмещенный график точности нейронной сети и частоты обработки кадров. При этом представлены толь-

Билан И.Т., Трубников К.В., Звонарев Д.Ю., Носкова М.Н.

Рис. 6 . Распределение точности и скорости обученных нейронных сетей для классификации торцов гильз

Fig. 6. Distribution of accuracy and speed of trained neural networks for classifying case ends

ко те нейронные сети, для которых точность составила более 90 %.

Как видно из рис. 6, наиболее медленной нейронной сетью оказалась сеть DarkNet53, хотя точность превышает 99 %. Остальные же нейронные сети могут обрабатывать изображения на уровне 20–30 кадров в секунду, что более чем достаточно, так как промышленные камеры машинного зрения зачастую имеют скорость съемки 15–35 кадров в секунду [19].

Что же касается применения нейронной сети для организации работы персонала по информированию появления дефектных торцов гильз, то наиболее эффективной нейронной сетью может являться AlexNet с точностью прогнозирования 99,77 %.

Заключение

В ходе выполнения работы было выявлено следующее.

-

1. Для эффективного обнаружения торца гильзы на изображении необходимо приме-

- нять сверточную нейронную сеть с извлечением характеристик, например ResNet50 со слоями YOLO.

-

2. При обучении нейронных сетей, предназначенных для классификации, наиболее точными оказались нейронные сети AlexNet, DarkNet19, DarkNet53.

-

3. При обучении нейронных сетей, предназначенных для классификации, наиболее быстродейственными оказались нейронные сети AlexNet, ShuffleNet.

-

4. На основе данных о точности нейронных сетей и их скорости обработки изображений можно судить о том, что их можно применять для организации работы персонала. Сверточные нейронные сети (в частности ResNet50 со слоями YOLO для индентифика-ции наличия торца гильзы на изображении, а AlexNet – для классификации торца гильзы) смогут своевременно информировать персонал о появлении дефектов.

Список литературы Обнаружение и классификация дефектов прокатного происхождения на торцах гильз с использованием сверточной нейронной сети

- Alzubaidi L., Zhang J., Humaidi A.J. et al. Review of deep learning: concepts, CNN architectures, challenges, applications, future directions. Journal of Big Data. 2021;8:53. DOI: 10.1186/s40537-021-00444-8

- Rawat W., Wang Z. Deep convolutional neural networks for image classification: A comprehensive review. Neural Computation. 2017;29(9):2352–2449. DOI: 10.1162/NECO_a_00990

- Созыкин А.В. Обзор методов обучения глубоких нейронных сетей // Вестник ЮУрГУ. Серия «Вычислительная математика и информатика». 2017. Т. 6, № 3. С. 28–59. [Sozykin A.V. An Overview of Methods for Deep Learning in Neural Networks. Bulletin of the South Ural State University. Ser. Computational Mathematics and Software Engineering. 2017;6(3):28–59. (In Russ.)] DOI: 10.14529/cmse170303

- Трубников К.В., Нерозников В.Л. Применение машинного зрения при производстве труб // XXIV Международная научно-практическая конференция “Трубы-2021”. 2021. Т. 1. С. 135–139. [Trubnikov K.V., Neroznikov V.L. [The use of machine vision in the production of pipes]. In: XXIV International Technology and Application Conference “Pipes-2021”; 2021. Vol. 1. P. 135–139. (In Russ.)]

- ImageNet Large Scale Visual Recognition Competition 2012. Available at: http://www.imagenet.org/challenges//LSVRC/2012/results.html.

- Russakovsky O., Deng J., Su H. et al. ImageNet Large Scale Visual Recognition Challenge. International Journal of Computer Vision. 2015;115(3):211–252. DOI: 10.1007/s11263-015-0816-y

- Pretrained Deep Neural Networks. Available at: https://www.mathworks.com/help/deeplearning/ug/pretrained-convolutional-neural-networks.html (accessed 17.01.2022).

- Redmon J., Divvala S., Girshick R., Farhadi A. You only look once: Unified, real-time object detection. In: Proceedings of the IEEE conference on computer vision and pattern recognition; 2016. P. 779–788. DOI: 10.1109/CVPR.2016.91

- Redmon J., Farhadi A. YOLO9000: Better, Faster, Stronger. In: Proceedings of the IEEE conference on computer vision and pattern recognition. 2017. P. 7263–7271. DOI: 10.1109/CVPR.2017.690

- Ardhianto P., Liau B.-Y., Jan Y.-K. et al. Deep Learning in Left and Right Footprint Image Detection Based on Plantar Pressure. Applied Sciences. 2022;12(17):8885. DOI: 10.3390/app12178885

- Ballester P.L., Araujo R.M. On the performance of GoogLeNet and AlexNet applied to sketches. In: Thirtieth AAAI conference on artificial intelligence; 2016.

- Sandler M., Howard A., Zhu M., Zhmoginov A., Chen L.-C. MobileNetV2: Inverted Residuals and Linear Bottlenecks. In: 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Salt Lake City, UT, USA; 2018. P. 4510–4520. DOI: 10.1109/CVPR.2018.00474

- Theckedath D., Sedamkar R.R. Detecting affect states using VGG16, ResNet50 and SE-ResNet50 networks. SN Computer Science. 2020;1:1–7. DOI: 10.1007/s42979-020-0114-9

- Zhang X., Zhou X., Lin M., Sun J. ShuffleNet: An Extremely Efficient Convolutional Neural Network for Mobile Devices. In: 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Salt Lake City, UT, USA; 2018. P. 6848–6856. DOI: 10.1109/CVPR.2018.00716

- Al-Haija Q.A., Smadi M., Al-Bataineh O.M. Identifying Phasic dopamine releases using DarkNet-19 Convolutional Neural Network. In: 2021 IEEE International IOT, Electronics and Mechatronics Conference (IEMTRONICS). Toronto, ON, Canada; 2021. P. 1–5. DOI: 10.1109/IEMTRONICS52119.2021.9422617

- Wang H., Zhang F., Wang L. Fruit Classification Model Based on Improved Darknet53 Convolutional Neural Network. In: 2020 International Conference on Intelligent Transportation, Big Data & Smart City (ICITBS). Vientiane, Laos; 2020. P. 881–884. DOI: 10.1109/ICITBS49701.2020.00194

- Tan M, Le QV. EfficientNet: Rethinking Model Scaling for Convolutional Neural Networks. In: International conference on machine learning, PMLR; 2019. P. 6105–6114.

- Iandola F.N., Moskewicz M., Ashraf K. et al. SqueezeNet: AlexNet-level accuracy with 50x fewer parameters and <0.5MB model size. arXiv preprint arXiv:1602.07360. 2016.

- Available at: https://www.cameraiq.ru/catalog/series/HIKROBOT-CE-Area-Scan/ (accessed 17.01.2022).