Сравнение классификационных возможностей алгоритмов С4.5 и С5.0

Автор: Пальмов Сергей Вадимович, Мифтахова Альфия Асхатовна

Журнал: Инфокоммуникационные технологии @ikt-psuti

Рубрика: Управление и подготовка кадров для отрасли инфокоммуникаций

Статья в выпуске: 4 т.13, 2015 года.

Бесплатный доступ

В статье проводится сравнение возможностей алгоритмов деревьев решений C4.5 и C5.0 - одних из наиболее эффективных инструментов классификации интеллектуального анализа данных. Для этого были выбраны две их программные реализации - отечественная аналитическая платформа Deductor и система See5. Чтобы повысить качество сравнительного анализа, использовались три разных набора данных. Как показали результаты эксперимента, утверждения автора-разработчика обоих алгоритмов Куинлана о том, что новая версия алгоритма во всём превосходит старую, оказались несколько излишне оптимистичными. C5.0, действительно, строит, как и заявлено, более компактные деревья решений, но скорость его работы осталась сопоставимой с C4.5, а достоверность получаемой классификационной модели снизилась. Однако, авторы статьи не исключают, что вышеуказанные результаты объясняются, тем, что в их распоряжении имелась демонстрационная версия системы See5, которая может обрабатывать файлы, содержащие не более 400 записей.

Дерево решений, с4.5, с5.0

Короткий адрес: https://sciup.org/140191800

IDR: 140191800 | УДК: 004.8 | DOI: 10.18469/ikt.2015.13.4.18

Comparison of classification algorithms C4.5 and C5.0

This work compares features of tree decision algorithms C4.5 and C5.0, which are the most effective data mining classification tool. We considered two software tools: analytics platform Deductor and system See5. Three data sets were tested to improve comparative analysis accuracy. First is conventional Fisher’s iris data set, second contains information about US Congress deputy votes (distribution Deductor), and third includes information about applicants of the one of Russian Federation universities. According to test results, C5.0 builds more compact decision trees, but its operation speed is almost the same to C4.5 under reducing of classification model validity. However, we do not preclude that these results can be explained by using of See5 system demo version that provides only files processing with no more 400 entries.

Текст научной статьи Сравнение классификационных возможностей алгоритмов С4.5 и С5.0

Существуют различные подходы к анализу данных [1]. Одним из самых известных является технология интеллектуального анализа данных (Data Mining, далее DM) – процесс обнаружения в необработанных данных ранее неизвестных нетривиальных знаний, необходимых для принятия решений в различных сферах человеческой деятельности [2]. Технология DM располагает большим числом инструментов (алгоритмов) для проведения различных видов анализа [3]. Одним из наиболее популярных классификационных алгоритмов являются деревья решений. Деревья решений – это способ представления правил в иерархической, последовательной структуре, где каждому объекту соответствует единственный узел, дающий решение [4].

Виды алгоритмов деревьев решений

Наиболее эффективным алгоритмом деревьев решений считается C4.5 – усовершенствованная версия алгоритма ID3 [5], разработанная Д. Куинланом, позволяющая строить дерево решений с неограниченным числом ветвей у узла [6]. Однако некоторое время назад появилась новая модификация – C5.0. Как утверждает автор (все тот же Д. Куинлан), она превосходит предыдущую версию: работает быстрее, строит деревья решений меньшей размерности, использование памяти компьютера является более эффективным, имеет более высокую точность результатов, позволяет автоматически удалять незначащие атрибуты [7]. Для проверки данного утверждения нами были выбраны два программных продукта, в которых реализованы алгоритмы C4.5 и С5.0.

Программные продукты

Алгоритм С4.5. реализован в системе Deductor. Аналитическая платформа Deductor – основа для создания законченных прикладных решений. Реализованные в Deductor технологии позволяют на базе единой архитектуры пройти все этапы построения аналитической системы: от создания хранилища данных до автоматического подбора моделей и визуализации полученных результатов [8-9].

Алгоритм С5.0 реализован в системе See5 [10]. See5 – инструмент анализа данных для прогно- зирования диагностического класса какого-либо объекта по значениям его признаков. Содержит единственный обработчик – дерево решений. Причина выбора именно этих программных систем заключается в наличии бесплатных демонстрационных версий, доступных для свободного скачивания с сайтов компаний-разработчиков.

Данные

Для проведения сравнительного анализа было выбрано три набора данных: файл «ирисы Фишера» [11]; файл, содержащий информацию о результатах голосования депутатов Конгресса США (входит в дистрибутив аналитической платформы Deductor); файл, содержащий реальную информацию об абитуриентах одного из вузов РФ. Структура файлов:

-

- «Ирисы Фишера» – 150 записей, 5 атрибутов (целевой атрибут – «класс»);

-

- голосование депутатов – 400 записей, 17 атрибутов (целевой атрибут – «партийная принадлежность»);

-

- абитуриенты – 400 записей, 20 атрибутов (целевой атрибут – «форма обучения»).

Описание эксперимента

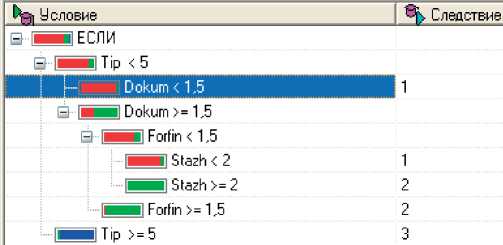

Эксперимент состоял из трех частей: построение дерева решений для файла «Ирисы Фишера» средствами Deductor и See5, построение дерева решений для файла «Голосование депутатов» средствами Deductor и See5, построение дерева решений для файла «Абитуриенты» средствами Deductor и See5. Для всех трех случаев были выбраны следующие настройки обработчиков: уровень доверия, используемый при отсечении узлов дерева, – 20%, минимальное количество примеров в узле, при котором будет создан новый, – 2. Результаты эксперимента приведены на рис. 1-6 и в таблице 1.

Выводы

Как видно из представленных результатов, во всех трех случаях алгоритм C5.0 построил более компактные деревья, содержащие, как следствие, и меньшее количество правил (см. таблицу 1). Однако точность классификации у алгоритма C4.5 (см. таблицы сопряженности) оказалась несколько выше. Скорость генерации результатов

Decision tree:

Dlina lepestka <= 1.9: Iria-setosa (50)

Dlina lepestka >1.9: (a) (b) (c) <-classified as

:...Shirina lepestka > 1.7: Iris-virginica (46/1) ---- ---- ----

Shirina lepestka <=1.7: 50 (a): class Iris-setosa

:.. .Dlina lepestka <= 4.9: Iris-versicolor (48/1) 47 3 (b) : class Iris-versicolor

Dlina lepestka > 4.9: Iris-virginica (6/2) 1 49 (c): class Iris-virginica

Рис. 1. Дерево решений и таблица сопряжённости для «Ирисов Фишера» (See5)

к |^^и| Длина лепестка < 2,45 Iris-setosa

В |^™| Длина лепестка >= 2,45

|

Э- |^^е| Ширина лепестка < 1,75 |

Классифицировано |

|||||

|

—[^^Й] Длина лепестка < 4,95 |

I ris-versicolor |

Фактически |

Iris-setosa |

I ris-versicolor |

Iris-virginica |

Итого |

|

В- |^^и| Длина лепестка >= 4,95 |

Iris-setosa |

I 50 |

50 |

|||

|

г ■l^^g] Ширина лепестка < 1.55 |

Iris-virginica |

I ris-versicolor |

491 |

_____________________1_ |

50 |

|

|

^™ Ширина лепестка >= 1 „55 |

I ris-versicolor |

Iris-virginica |

2 |

48 |

50 |

|

|

;- |^^е| Ширина лепестка >=1,75 |

I ris-virginica |

Итого |

50 |

51 |

49 |

150 |

Рис. 2. Дерево решений и таблица сопряженности для «Ирисов Фишера» (Deductor)

Decision tree:

Zakon о vrachah in {no,vozderzhalsja}: demokrat (241/5)

Proekt po usynovleniju = yes: demokrat (6/2) 143 8 (a): class respublikanez

Proekt po usynovleniju = no: respublikanez (17/2) 5 244 (b): class demokrat

Рис. 3. Дерево решений и таблица сопряженности для «Голосования депутатов» (See5)

D^ Условие

| ^> Следствие

Zakon о vrachah = no

|^^и| Zakon о vrachah = vozderzhalsja

demokrat demokrat

j • |^^■| Proekt po altern istoch topi = no

2 [^^h] Proekt po altern istoch topi = vozderzhalsja В I^^Hl Proekt po altern istoch topi = yes

respublikanez respublikanez

|^^и| Proekt po usynovleniju = no

respublikanez

H | Proekt po usynovleniju = vozderzh... respublikanez B-|^^e| Proekt po usynovleniju =yes k"|^^e| Proekt po vodnym resursam =... respublikanez i "I I Proekt po vodnym resursam = ... demokrat |^^e| Proekt po vodnym resursam = ... demokrat

I | Proekt po raketam = vozderzhalsja respublikanez |^™ Proekt po raketam = yes demokrat

|

Ф актически |

demokrat |

respublikanez |

Итого |

|

demokrat |

244 |

_________________5_ |

249 |

|

respublikanez |

6 |

145 |

151 |

|

Итого |

250 |

150 |

400 |

Рис. 4. Дерево решений и таблица сопряженности для «Голосования депутатов» (Deductor)

у обоих алгоритмов примерно одинаковая и составляет менее 1 сек.

Таким образом, можно сделать вывод, что, как и заявлял Д. Куинлан, алгоритм C5.0 действительно строит более компактные деревья решений, чем его предшественник, а также обладает высокой скоростью построения классификационных моделей. Тем не менее достоверность результатов работы алгоритма C4.5 выше, чем у C5.0. В то же время нельзя исключать, что вышеуказанные ре-

Decision tree:

Рис. 5. Дерево решений и таблица сопряженности для «Абитуриентов» (See5)

Рис. 6. Дерево решений и таблица сопряженности для «Абитуриентов» (Deductor)

Dokum < = 1: 1 (303/6)

Dokum > 1:

Tip <= 4:

:...ForfinForfin <= 1: 1 (33/6) ForfinForfin > 1: 2 (48/2)

|

(а) |

(Ь) |

(с) |

^-classified аз |

||

|

324 |

2 |

(а): |

class |

1 |

|

|

12 |

46 |

1 |

(Ь): |

class |

2 |

|

15 |

(с): |

class |

3 |

||

Таблица 1. Количество правил

Список литературы Сравнение классификационных возможностей алгоритмов С4.5 и С5.0

- Большие данные (Big Data)//URL: http://www.tadviser.ru/index.php (д.о. 10.10.2015).

- Data Mining -интеллектуальный анализ данных//URL: http://www.inftech. webservis.ru/it/database/datamining/ar2.html (д.о. 10.10.2015).

- Топ-10 data mining-алгоритмов простым языком//URL: http://habrahabr.ru/company/itinvest/blog/262155/(д.о. 11.10.2015).

- Деревья решений -общие принципы работы//URL: http://www.gotai.net/documents/doc-msc-006.aspx (д.о. 12.10.2015).

- The ID3 Algorithm//URL: http://www.cise. ufl.edu/~ddd/cap6635/Fall-97/Short-papers/2. htm (д.о. 12.10.2015).

- Сидоров А.В. Алгоритмы создания дерева принятия решений//URL: http://econf.rae. ru/pdf/2014/03/3245.pdf (д.о. 13.10.2015).

- Is See5/C5.0 Better Than C4.5?//URL: http://rulequest.com/see5-comparison.html. (д.о. 15.10.2015).

- Deductor -описание аналитической платформы//URL: http://bitconsulting. ru/product/olap/(д.о. 17.10.2015).

- Studio//URL: http://basegroup.ru/deductor/components/studio (д.о. 17.10.2015).

- Data Mining Tools See5 and C5.0//URL: http://rulequest.com/see5-info.html (д.о. 17.10.2015).

- Iris Data Set//URL: http://archive. ics.uci.edu/ml/datasets/Iris (д.о. 19.10.2015).