Анализ проблем информативности интерфейса при разработке автономных систем искусственного интеллекта для управления корпорациями

Автор: Романова А.С.

Журнал: Труды Московского физико-технического института @trudy-mipt

Рубрика: Математика

Статья в выпуске: 2 (66) т.17, 2025 года.

Бесплатный доступ

В настоящее время можно выделить два основных типа интерфейсов, используемых при разработке и внедрении автономных систем искусственного интеллекта при управлении корпорациями: цифровые приборные панели и персонифицированные системы — виртуальные агенты и антропоморфные роботы. Также ожидается возникновение гибридных систем путем объединения многофункциональных цифровых командных центров и персонифицированных систем. Наше исследование представляет подробный обзор подходов, которые применяются при разработке интерфейсов для автономных систем управления корпорациями. Затем мы предлагаем концептуальную структуру для разработки интерфейсов автономных систем ИИ, которая учитывает принципы демонстрации легитимности и этичности принимаемых управленческих решений.

В настоящее время можно выделить два основных типа интерфейсов, используемых при разработке и внедрении автономных систем искусственного интеллекта при управ- лении корпорациями: цифровые приборные панели и персонифицированные системы — виртуальные агенты и антропоморфные роботы. Также ожидается возникновение гибридных систем путем объединения многофункциональных цифровых командных центров и персонифицированных систем. Наше исследование представляет подробный обзор подходов, которые применяются при разработке интерфейсов для автономных систем управления корпорациями. Затем мы предлагаем концептуальную структуру для разработки интерфейсов автономных систем ИИ, которая учитывает принципы демонстрации легитимности и этичности принимаемых управленческих решений.

Короткий адрес: https://sciup.org/142245011

IDR: 142245011 | УДК: 004.891

Analysis of interfaces informativeness issues in the development of autonomous artificial intelligence systems for corporate management

The two main types of interfaces can be distinguished in the development and implementation of autonomous AI systems for corporate management: digital control panels and personalised systems — virtual agents and anthropomorphic robots. Hybrid systems are also expected to emerge by combining multifunctional digital command centres and personalised systems. Our study provides a detailed overview of the approaches used in the development of interfaces for autonomous corporate governance systems. Then, we propose a conceptual framework for the development of interfaces for autonomous AI systems that takes into account the principles of demonstrating the legitimacy and ethics of the management decisions made.

Текст научной статьи Анализ проблем информативности интерфейса при разработке автономных систем искусственного интеллекта для управления корпорациями

В настоящее время при разработке и внедрении автономных систем искусственного интеллекта (далее ИИ) для управления корпорациями используются два основных типа интерфейсов. В качестве интерфейса для цифровых командных центров (далее ЦКЦ) типа Panorama используются цифровые приборные панели (дашборды) [1]. В качестве интерфейса для персонифицированных систем ИИ используются либо виртуальные агенты [2], либо антропоморфные (гуманоидные роботы) [3].

-

(с) Романова А. С., 2025

-

(с) Федеральное государственное автономное образовательное учреждение высшего образования «Московский физико-технический институт (пациопальпый исследовательский университет)», 2025

-

2. Современный уровень развития автономных систем для управления

Автономные системы ИИ, разрабатываемые для управления корпорациями, меняют современную парадигму корпоративного лидерства и социалвного взаимодействия внутри и вне компании. Еще в 2017 году основателв Alibaba Group Джек Ма признал потенциал роботов для замены топ-менеджеров в ближайшем будущем. Ма предсказал, что робот может быть представлен как лучший СЕО на обложке журнала Time в течение 30 лет [4].

Несмотря на многочисленные исследования и практическую эксплуатацию автономных систем ИИ в различных областях человеческой деятелвности, на современном этапе развития техники принятие разумных решений автономными системами ИИ обычно недоступно пониманию человека, и этот недостаток препятствует полному социалвному принятию таких технологий [5]. В нашем исследовании мы сначала показываем необходимоств предоставления объяснений автономными системами ИИ, а затем представляем концептуалвную структуру разработки интерфейсов автономных систем ИИ для управления корпорациями. Основная частв статви состоит из трех разделов. Раздел 5 завершает статвю общим резюме.

корпорациями

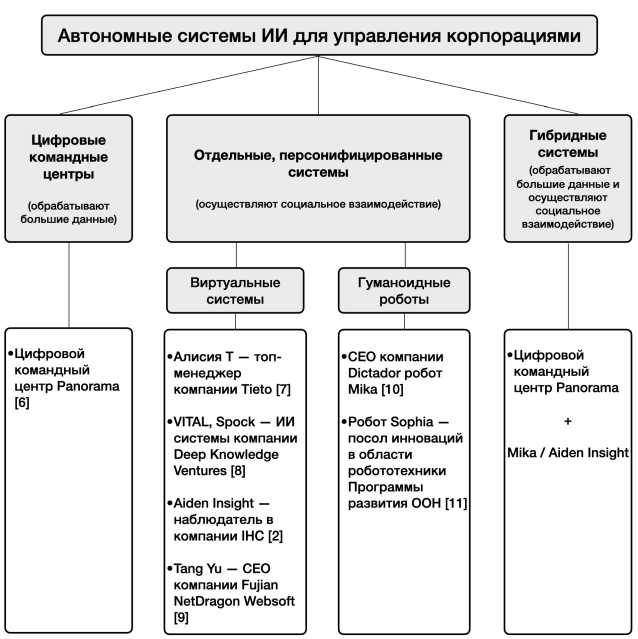

Основными типами автономных систем ИИ, разрабатываемых в настоящее время для управления корпорациями, являются многофункциональные цифровые командные центры, персонифицированные виртуальные системы и антропоморфные роботы (рис. 1).

Рис. 1. Основные типы автономных систем ИИ для управления корпорациями

Цифровые командные центры в настоящее время внедряются многими коммерческими и некоммерческими организациями. Они сфокусированы прежде всего на принятии решений на основе больших данных и не обладают функциями социального взаимодействия с людьми. Компании, которым важно социальное взаимодействие, внедряют персонифицированные системы в виде виртуальных агентов или гуманоидных роботов. Также ожидается возникновение гибридных систем путем объединения многофункциональных цифровых командных центров (для обработки больших данных) и персонифицированных систем (в качестве интерфейса с функциями социального взаимодействия — в виде виртуального агента или гуманоидного робота).

Цифровые командные центры

Наиболее ярким примером современного интерфейса цифрового командного центра является интерфейс ЦКЦ Panorama, который представляет собой интерактивную пятидесятиметровую стену, отражающую в реальном времени данные по всем дочерним компаниям нефтяной компании ADNOC [6]. Центр визуализации ЦКЦ Panorama предоставляет уникальную видимость всех операций компании (включая 14 дочерних предприятий) для повышения гибкости бизнеса за счет интеграции и мониторинга более 10 миллионов тегов на более чем 120 панелях мониторинга, делает визуальное управление до 700 раз быстрее и позволяет сэкономить от 60 до 100 млн долларов в год за счет оптимизации операций [1].

Интерфейсы цифровых командных центров прежде всего используют фактор визуализации данных, что позволяет выявлять закономерности, сжимать данные, сравнивать и изучать взаимосвязи во времени, которые не обязательно очевидны независимо от их представления [12]. Сто лет назад собиралось всего несколько точек данных о человеке за всю его жизнь: когда он родился, женился ли он и когда умер. Сегодня данные любого рода легкодоступны. Огромный объем данных, собираемых каждую секунду по всему миру, используется всеми видами промышленности и организаций для формирования бизнеса, культур и сообществ [13].

Исследования в области дизайна пользовательского интерфейса показывают, что при одинаковом уровне когнитивных способностей люди отдают предпочтение простым визуально-пространственным интерфейсам. Другими словами, обработка визуальной информации более интуитивна для людей, чем обработка других типов информации, таких как текст или числа [14]. Таким образом, цифровые командные центры имеют в своем распоряжении интерфейсы, которые позволяют демонстрировать и объяснять принимаемые бизнес-решения в удобном для человека формате.

Антропоморфные роботы

Основным преимуществом гуманоидных роботов является возможность осуществлять эффективное социальное взаимодействие с людьми, включая также корпоративное лидерство. Люди — это социальные животные, которые обычно любят наблюдать друг за другом и взаимодействовать друг с другом [15]. Разработчики андроидов придерживаются точки зрения, что только очень человекоподобные устройства могут вызывать широкий спектр реакций, которые люди обычно направляют друг другу [16]. Этот подход основан на том, что люди очень восприимчивы к человеческим характеристикам, таким как звук человеческого голоса, внешний вид человеческого лица и движения тела. Младенцы проявляют предпочтения к этим типам стимулов в раннем возрасте, а взрослые, по-видимому, используют специализированные умственные ресурсы при интерпретации этих стимулов. Подражая человеческим характеристикам, гуманоидные роботы могут задействовать те же самые предпочтения и интеллектуальные ресурсы [15].

Гуманоидные роботы потенциально могут упростить и улучшить взаимодействие человека и робота, используя каналы связи, которые уже существуют между людьми (естественные жесты и выражения, тонкие движения рук, взгляд и выражение лица). Также они могут быть вовлечены в культурно-социальные действия и взаимодействия, сосредоточенные вокруг человеческой формы тела (рукопожатие и т. д.) [15]. Гуманоидные роботы могут общаться с людьми посредством экспрессивной морфологии и поведения. Как и люди, гуманоидные роботы объединяют коммуникативную и некоммуникативную функциональность. Например, руки и кисти робота могут тянуться и хватать, а также указывать и жестикулировать [15].

Гуманоидные роботы могут эффективно работать в среде обитания человека, тем самым упрощая задачи и избегая необходимости изменять среду для робота. Антропоморфные роботы и люди могут сотрудничать друг с другом в одном пространстве, используя одни и те же инструменты. Общая среда обитания и сотрудничество открывают широкие возможности для исполнения гуманоидными роботами функций корпоративного лидерства. Более того, гуманоидные роботы могут демонстрировать лидерство в небезопасной для человека среде обитания, например в условиях аварии на АЭС «Фукусима-1», произошедшей в марте 2011 года в Японии [15]. Благодаря своим свойствам поддерживать естественную для человека коммуникацию андроиды также могут рассматриваться как новый вид информационного носителя [16].

Наиболее известны достижения двух гуманоидных роботов — СЕО Мики и робота-посла Софии. Мика является членом совета директоров, курирует проект Arthouse Spirits DAO и содействует общению с сообществом DAO от имени польской компании Dictador [10]. Мика реализует преимущества гуманоидных роботов, предоставляя эксклюзивную возможность членам сообщества DAO встретиться и провести время с ней [17].

Виртуальные агенты

Виртуальные агенты используют многие преимущества антропоморфности, как и гуманоидные роботы, но не имеют физического тела. Физическое воплощение имеет ряд преимуществ по сравнению с чисто графическими представлениями. В то время как многие социальные взаимодействия предполагают обмен только визуальными и слуховыми сигналами (доступными виртуальным агентам), роботы поддерживают коммуникацию и сотрудничество также посредством физического контакта. Роботы также поддерживают совместную манипуляцию артефактами и совместное использование физического пространства с людьми [18].

Как показывают исследования в области робототехники, физическое воплощение оказывает измеримое влияние на производительность и восприятие социальных взаимодействий [19]. Эксперименты демонстрируют, что робот является более эффективным партнером во взаимодействии из-за его физического воплощения, робот воспринимается как более интересный, чем виртуальный агент, и воспринимается как более надежный и информативный, а также более приятный для взаимодействия [20]. Роботы, как правило, поддерживают динамику группового общения лицом к лицу, в то время как экраны, как правило, приковывают взгляд, рискуя снизить персональное взаимодействие [18]. С другой стороны, виртуальные агенты приспособлены к взаимодействиям в стремительно развивающихся виртуальных средах (например, в Метавселенной).

Наиболее яркой современной реализацией виртуального агента является СЕО китайской игровой компании Тан Юй. NetDragon Websoft, игровая компания со штаб-квартирой в Фучжоу, назначила «виртуального гуманоидного робота с искусственным интеллектом» по имени Тан Юй на позицию СЕО своей дочерней компании Fujian NetDragon Websoft. После объявления о назначении акции компании превзошли индекс Hang Seng, который отслеживает крупнейшие компании, котирующиеся в Гонконге [21]. Ожидается, что Тан Юй оптимизирует процессы, повысит качество работы, улучшит скорость выполнения и будет служить центром данных в реальном времени для принятия аналитических решений и управления рисками. Также Тан Юй будет реализовывать потенциал виртуальных агентов для работы в Метавселенной [17].

-

3. Объяснимость при принятии решений автономными системи ИИ

Автономные системы ИИ при выполнении функций в совете директоров (далее СД) компании должны иметь возможность коммуницировать по различным вопросам с заинтересованными сторонами, как с людьми, так и с другими системами ИИ. В нашем исследовании мы рассматриваем прежде всего коммуникацию между автономной системой ИИ и человеком (человеческим коллективом). Член совета директоров коммуницирует с акционерами, институциональными инвесторами, аудиторами, другими директорами, сотрудниками компании и другими заинтересованными лицами [22]. Более того, коммуникация члена совета директоров во многих случаях должна соответствовать определенным формальным требованиям, быть понятной для пользователей и документироваться. Например, заседания совета директоров должны документироваться, а также должны составляться протоколы, включающие обсуждения и дискуссии, состоявшиеся в ходе таких заседаний [23].

Члены совета директоров также должны демонстрировать легитимное и этичное поведение и должны иметь возможность продвигать этичные, ответственные и прозрачные практики корпоративного управления [22]. Теперь поставим вопрос: каким образом автономная система ИИ может продемонстрировать свое легитимное и этичное поведение и при управлении ежедневными операциями, и при принятии долгосрочных стратегических решений? Иными словами: какие принципы должны быть указаны в кодексе корпоративного поведения в отношении автономных ИИ систем и как соблюдение этих принципов может быть продемонстрировано практически?

Исследования в области корпоративного лидерства показывают, что репутация и восприятие другими людьми являются ключом к этичному лидерству [24]. Каким образом автономная система ИИ может создать себе репутацию этичного лидера? Прежде всего, может быть использовано доверие к производителю (разработчику) системы. На самом деле, бренд производителя — это единственное фактическое обстоятельство, доступное и специалисту, и неспециалисту, чтобы составить мнение о системе ИИ.

Этичный руководитель должен характеризоваться с точки зрения индивидуальных черт, таких как честность и порядочность, и транслировать сильное этическое сообщение, которое привлекает внимание сотрудников и влияет на их мысли и поведение [25]. Однако, по мнению ряда авторов, разработка и создание социальных роботов (социальный робот — это физически воплощенный робот, способный взаимодействовать с людьми в социальном плане) часто подразумевает введение в заблуждение [25]. Некоторые из возможных аргументов (в части антропоморфности) применимы также и к виртуальным агентам. Например, формой введения в заблуждение могут восприниматься попытки разработать функции, способствующие созданию иллюзии ментальной жизни у роботов, поскольку у современных роботов нет ни разума, ни опыта [25].

Таким образом, с одной стороны, у нас есть цифровые командные центры, которые не вводят пользователей в заблуждение своей антропоморфностью, но и не могут участвовать в социальных взаимодействиях с людьми. С другой стороны, у нас есть антропоморфные роботы и виртуальные агенты, которые специально создаются для социального взаимодействия, но могут вызывать также ощущение дискомфорта. Например, если человек верит, что робот (виртуальный агент) имеет эмоции и заботится о нем, его вводят в заблуждение: даже если при разработке системы ИИ никто явно не имел в виду такую веру [25].

Можно выделить два вида рисков, которые могут возникнуть в результате разработки и представления антропоморфных роботов, которые, как представляется, имеют эмоции и способны понимать людей и заботиться о них:

те, которые вытекают из иллюзии, связанной с роботами, которые, как представляется, имеют эмоции и заботятся о нас;

те, которые возникают из-за переоценки способности роботов понимать человеческое поведение и социальные ситуации [25].

Можно добавить еще один вид риска — мы не умеем распознавать искусственные невербальные знаки роботов. Люди способны контролировать вербальные, но не невербальные компоненты своего поведения. Зигмунд Фрейд говорил, что если у человека губы молчат, то он болтает кончиками пальцев [27]. При общении друг с другом люди могут получать достаточно много дополнительной невербальной информации. У робота все невербальные знаки искусственные и несут только ту информацию, которую заранее запрограммировали разработчики.

Как предоставлять объяснения при работе автономных систем ИИ?

Цифровые командные центры имеют в своем распоряжении намного более мощные средства для демонстрации своей «честности» и профессиональности своих решений, чем гуманоидные роботы и виртуальные агенты. На огромных дашбордах они могут продемонстрировать весь процесс принятия решения: от сбора и обработки данных, до результатов работы алгоритмов машинного обучения, и последующей их валидации. Однако существует несколько подходов, которые уже используются в корпоративном управлении и могут быть использованы и при создании цифровых командных центров, и виртуальных агентов, и гуманоидных роботов.

Например, в корпоративном управлении широко используется принцип «соблюдай или объясняй», означающий, что стороны имеют право объяснить свое несоблюдение принципов нормативного документа (кодекса), если они считают, что строгое соблюдение нецелесообразно. [27]. Таким образом, гуманоидный робот или виртуальный агент могут иметь один или несколько индикаторов (в соответствии с принятой в компании политикой), отражающих (например, зеленым цветом), что определенные положения принятых в компании политик и процедур соблюдены.

Возможно отметить, что если бы принцип “соблюдай или объясняй” применялся бы в отношении знаменитых трех законов робототехники, то многие из дилемм трех законов не возникли бы. Индикатор робота показывал бы, какой закон соблюдается, а какой нет, и при расширенном дизайне указывал бы почему.

Кроме того, даже для топ-менеджеров существуют обязанности и процедуры по регулярной проверке и сертификации знаний и здоровья. Например, в Принципах корпоративного управления G20/O9CP указывается, что советы директоров должны регулярно проводить оценку своей работы и определять, обладают ли они необходимым сочетанием опыта и компетенций [22]. Компания должна разработать необходимые механизмы для членов совета директоров, членов комитетов и исполнительного руководства, чтобы они могли постоянно проходить обучение и курсы с целью развития своих навыков и знаний в областях, связанных с деятельностью компании [23]. Аналогичный подход может быть применен и к автономным системам ИИ.

Даже при таком упрощенном подходе автономным системам ИИ необходимы инструменты для объяснения отклонений от принятых политик, не говоря уже о возможности участия автономных систем в профессиональных дискуссиях и необходимости представления своей аргументированной позиции. Кроме того, необходимо учитывать требования различных отраслей законодательства, которые уже ввели или введут в качестве обязательного требования к системам ИИ так называемое «право на объяснение» [28].

Рис. 2. Автономное транспортное средство предоставляет объяснение па естественном языке своего решения в реальном времени прохожим [5]

Основой для принятия решений автономной системой ИИ являются данные и алгоритмы, значит, гуманоидный робот или виртуальный агент должны иметь в своем распоря- жении экран и звуковое сопровождение, чтобы эффективно представлять свою позицию. Например, социальный робот Pepper имеет мультимодальность интерфейсов взаимодействия: сюда входят сенсорный экран, речь, тактильные голова и руки, а также светодиоды (LED) [29].

С ограниченными возможностями по предоставлению объяснений небольшими автономными системами ИИ уже столкнулись разработчики беспилотных автомобилей. Они также пришли к выводу о необходимости небольших дисплеев, которые могут предоставлять объяснения в текстовом формате (рис. 2).

-

4. Структура объяснимости: интеграция вычислительного права, выделенного операционного контекста и технологий объяснимого ИИ

Существующие методы объяснения моделей машинного обучения сосредоточены почти полностью на проблеме непостижимости алгоритмических решений. Хотя такие методы могут позволить системе машинного обучения соответствовать существующему законодательству, это может не помочь, если цель состоит в том, чтобы оценить, является ли основа для принятия решений нормативно защищенной [28]. Автономные системы ИИ при принятии ответственных управленческих решений должны иметь возможность продемонстрировать, что принимаемые решения легитимны и этичны.

Как показывают исследователи в области правового регулирования информационных технологий, объяснения технических систем необходимы, но недостаточны для достижения целей права и политики, большинство из которых связаны не с объяснением ради самого объяснения, а с обеспечением возможности оценки основы принятия решений с учетом более широких нормативных ограничений, таких как недискриминация или надлежащая правовая процедура [28]. Главным вопросом, вызывающим ожесточенные дебаты по поводу объяснимости и машинного обучения, стал вопрос о том, можно ли заставить машинное обучение соответствовать закону [28]. Основные законодательные требования к объяснимости моделей исходят из необходимости юридической демонстрации обоснованности принятия решений. Например, во многих правовых системах введены положения, защищающие руководство и членов совета директоров от злоупотреблений в судебных разбирательствах в форме механизмов проверки, таких как досудебная процедура оценки того, является ли претензия необоснованной, и безопасные гавани для действий руководства и членов совета директоров (например, правило делового суждения), а также безопасные гавани для раскрытия информации [22]. То, что решения, основанные на машинном обучении, отражают конкретные закономерности в обучающих данных, не может быть достаточным объяснением того, почему решение принимается именно так [28]. Как указывает профессор Мирей Хильдебрандт (работающая на стыке права и компьютерных наук), в конечном итоге важно, могут ли решения автоматизированных систем быть оправданы [30].

Предлагаемая модель разработки и внедрения автономных систем ИИ для управления корпорациями (рис. 3) основана на синтезе вычислительного права, выделенного операционного контекста, контролируемой генерации синтетических данных, алгоритмов машинного обучения, определения оптимальной стратегии с использованием теории игр и технологий объяснимого ИИ.

Концепция закона как вычисления направлена на то, чтобы свести закон к набору алгоритмов, которые могут автоматически выполняться на компьютере, преобразуя входные данные в юридические выводы [34]. Вычислительное право, сформулированное с помощью математического аппарата, позволит решить проблему соблюдения законодательства при использовании алгоритмов машинного обучения, а выделенный операционный контекст облегчит демонстрацию легитимности (например, с использованием правила «соблюдай или объясняй»).

Высокая точность сложных моделей достигается за счет снижения интерпретируемости; например, даже вклад отдельных признаков в прогнозы сложной модели трудно понять [35]. Эффективная ИИ система должна иметь в своем распоряжении разнообразные методы объяснения своих решений: от простых до сложных. На практике исследователи разработали по крайней мере три различных способа реагирования на потребноств в объяснениях:

целенаправленная организация процесса машинного обучения таким образом, чтобы полученная модель была интерпретируемой;

применение специальных методов после создания модели для аппроксимации модели в более понятной форме или выявления особенностей, наиболее важных для принятия конкретных решений;

предоставление инструментов, которые позволяют людям взаимодействовать с моделью и получать представление о ее работе [28].

Выделенный операционный контекст (политики и процедуры)

Расчет стратегии и принятие решений (теория игр)

Вычислительное право [справочник алгоритмических решений] [31]

Презентация и коммуникация (интерфейс, визуализация, объяснимый ИИ)

Алгоритмы машинного обучения

Контролируемая генерация синтетических данных [33]

Рис. 3. Модель разработки автономных систем ИИ для управления компаниями

Простым примером, когда и законодательные нормы, и демонстрация их соблюдения сформулированы с помощью математического аппарата, является современное трансфертное ценообразование (определение рыночной цены) для налоговых целей. Например, ОЭСР отдает предпочтение статистическим показателям, которые отражают центральную тенденцию (например, межквартильный размах (IQR) или другие процентили), особенно когда диапазон включает значительное количество наблюдений, чтобы повысить надежность анализа [36]. Также общепринятым подходом является возможность аргументировать свою позицию несколькими методами одновременно, так как корректное применение разных методов должно приводить к близким числовым значениям. ОЭСР не требует единого подхода к определению рыночной цены, и в рекомендациях ОЭСР отмечается, что там, где диапазон включает результаты относительно равной и высокой надежности, можно утверждать, что любая точка в диапазоне удовлетворяет принципу рыночной цены [36]. Такой же подход представления аргументации несколькими методами могут использовать и автономные системы ИИ.

Для общих объяснений система ИИ может использовать линейные модели, которые, как правило, проще для понимания и интерпретации людьми, поскольку взаимосвязь между переменными стабильна и поддается прямой экстраполяции [28]. По мере усложнения дискуссии и аргументации система ИИ может переходить к более сложным моделям объяснения своих решений.

При переходе на принятие решений на основе больших данных даже обычным топ-менеджерам необходимо изменить культуру принятия решений в компании [37]. Аналогичные культурные изменения в аргументации принимаемых управленческих решений должны происходить и при внедрении автономных систем ИИ.

Словарь алгоритмических терминов и отсутствие готовой семантической интерпретации

Необходимо обратить внимание на еще один вид объяснений, который могут использовать автономные ИИ системы. Модели машинного обучения могут быть трудны для понимания, если они рассматривают признаки или выполняют операции, которые не имеют некоторого готового семантического значения [38]. Эта непрозрачность алгоритмов машинного обучения возникает из-за несоответствия между математической оптимизацией в многомерном масштабе, характерной для машинного обучения, и требованиями человеческого мышления и стилей семантической интерпретации [38]. Например, алгоритм глубокого обучения может самостоятельно узнать, какие признаки на изображении характерны для различных объектов (стандартный пример — кошки), однако алгоритм также может самостоятельно проектировать признаки, которые не имеют эквивалента в человеческом познании и, следовательно, не поддаются описанию [28].

В связи с интенсивным развитием новых технологий в нашем языке постоянно появляются новые слова (неологизмы). Одной из областей в лингвистике и инженерном деле, изучающей взаимодействие человека и компьютера, является взаимодействие человека и компьютера. Она относится к процессу общения между людьми и компьютером и становится неотъемлемой частью изучения как в лингвистике, так и в инженерии [39]. Таким образом, разработка и использование словаря алгоритмических терминов [31] предоставят автономным системам ИИ возможность представлять и озвучивать аргументы, которые еще не имеют некоторого готового семантического значения. Если такие аргументы будут признаны устойчивой тенденцией, то они приведут к возникновению неологизмов, а также к расширению границ человеческого познания.

Объяснимый ИИ и тип интерфейса автономной системы ИИ

Рассматриваемые в современной литературе техники объяснимого ИИ (в основном текстовые объяснения и визуализации [40]) могут применяться и цифровыми командными центрами, и персонифицированными системами. Очевидно, что цифровые командные центры имеют возможность применять большее количество вычислительных ресурсов для объяснения управленческих решений, чем отдельные персонифицированные системы (виртуальные агенты и гуманоидные роботы). С другой стороны, гуманоидным роботам доступен метод физической демонстрации аргументов в пользу принимаемого решения (например, демонстрация прочности выбранного компанией материала для производственных целей). Гибридные автономные системы смогут соединить преимущества цифровых командных центров и персонифицированных систем.

-

5. Заключение

Гибридные системы, сочетающие значительные вычислительные мощности для обработки данных и коммуникабельность виртуальных агентов или роботов, представляются наиболее перспективным направлением для разработки автономных систем ИИ для управления корпорациями. Сами по себе цифровые командные центры или отдельные персонифицированные системы не смогут полноценно выполнять управленческие функции. Цифровые командные центры не имеют возможности выполнять функцию корпоративного лидерства, а отдельные персонифицированные системы не имеют возможности принимать управленческие решения на основе всевозрастающего потока больших данных.

Качественно сформулированное вычислительное право и выделенный операционный контекст позволят автономным системам ИИ наиболее прозрачно демонстрировать легитимность и этичность принимаемых решений. Также нельзя исключать вероятность того, что дальнейшие исследования в области психологии корпоративного лидерства и объяснений приведут к отказу от антропоморфности и разработке интерфейсов автономных систем ИИ только исходя из концепции больших данных.

Программный код исследования и примеры интеграции вычислительного права, выделенного операционного контекста и технологий объяснимого ИИ доступны в репозитории: