Автоматизация распознавания химических веществ с помощью электронной сенсорной технологии на основе нейросетевой обработки данных

Автор: Балашова Е.А., Битюкова В.В., Хвостов А.А.

Журнал: Вестник Воронежского государственного университета инженерных технологий @vestnik-vsuet

Рубрика: Химическая технология

Статья в выпуске: 3 (81), 2019 года.

Бесплатный доступ

Определение состава исходного вещества выполнялось с помощью электронного сенсорного прибора «электронный нос», состоящего из 8 датчиков, на которые с помощью шприца подавался воздух с парами спирта, содержащего разного рода примеси. Сигнал с датчиков записывался с частотой дискретизации 1 с на протяжении 120 с. Выходные данные прибора были представлены в двух разных интерпретациях - в виде кривых, полученных от каждого датчика, либо площадей под кривыми. Цель работы - построение системы распознавания 11 примесей и воды в исходном веществе. Определение состава исходного вещества выполнялось с помощью «электронного носа», позволяющего получить по 120 значений с каждого из 8 датчиков в виде кривых либо значений площадей под кривыми. Большое количество классов (12), динамическое представление информации исходных данных делают целесообразным построение системы распознавания образов на основе нейронной сети - многослойного персептрона, обучаемого на основе алгоритма обратного распространения ошибки...

Электронный нос, свертка исходной информации, нейронная сеть, распознавание химических веществ

Короткий адрес: https://sciup.org/140246388

IDR: 140246388 | УДК: 4.931 | DOI: 10.20914/2310-1202-2019-3-180-186

Automation of recognition of chemicals using electronic sensor technology based on neural network data processing

The composition of the initial substance was determined using an electronic sensor “electronic nose”, consisting of 8 sensors, to which air was supplied with a syringe with alcohol vapor containing various kinds of impurities. The signal from the sensors was recorded with a sampling frequency of 1 s for 120 s. The output of the device was presented in two different interpretations - in the form of curves obtained from each sensor, or the areas under the curves. The purpose of the work is to build a recognition system for 11 impurities and water in the starting material. The composition of the initial substance was determined using an “electronic nose”, which allows one to obtain 120 values from each of 8 sensors in the form of curves or the values of the areas under the curves. A large number of classes (12), the dynamic presentation of the source data information make it advisable to build a pattern recognition system based on a neural network - a multilayer perceptron trained on the basis of the error back propagation algorithm...

Текст научной статьи Автоматизация распознавания химических веществ с помощью электронной сенсорной технологии на основе нейросетевой обработки данных

Одной из современных тенденций анализа состава химического вещества является использование электронной сенсорной технологии – «электронного носа» [1]. Для определения состава вещества используется группа датчиков, выдающих различные выходные сигналы как для разных концентраций одного и того же вещества, так и для разных веществ.

Используемый в работе анализатор запахов МАГ-08 состоял из 8 чувствительных сенсоров, представляющих собой пьезоэлементы на основе кварцевых резонаторов ОАВ-типа с базовой частотой колебаний 10 МГц. На электродах размещались различные пленочные сорбенты: полиэтиленгликоль фталат (ПЭГФ), полиэтиленгликоль (ПЭГ-2000), тритон Х-100 (ТХ-100), полиэтиленгликоль себацинат (ПЭГСб), дицик-логексан-18-Краун-6 (ДЦГ18К6), полиэтиленгликоль адипинат (ПЭГА), многослойные углеродные нанотрубки (МУНТ), пчелиный клей (ПчК) [1].

Пробы каждого образца спиртосодержащей жидкости с примесями (ацетон, пропанол-1, пропанол-2, бутанол-1, бутанол-2, этанол, бута-нон, ацетальдегид, этилацетат, бутилацетат, пентанол-2, вода) отбирались индивидуальным шприцем и вводились в ячейку детектирования. Величина выходного сигнала сенсорного элемента определялась сорбционной активностью применяемого сорбента [2, 3]. Сигнал с датчиков (максимальное изменение частоты колебания кварцевых пластин в результате сорбции компонентов) записывался с частотой дискретизации 1 с на протяжении 120 с. Агрегирование информации проводилось в форме «визуального отпечатка» – оценивания площади отклика сенсоров, пропорционального концентрации летучих веществ.

Полученные исходные данные сохранялись в базе данных и обрабатывались с помощью программного обеспечения анализатора «MAG Soft», реализующего факторный анализ (метод главных компонент). В силу того что число рассматриваемых классов соединений велико (12 разновидностей примесей), получить точные результаты классификации образцов указанным методом не представляется возможным. Разработка алгоритма обработки результатов исследования в этой связи является актуальной задачей.

На сегодняшний день для классификации объектов различной природы и сложности используются эвристические методы, методы кластерного, дискриминантного анализа, точность которых с ростом числа классов снижается [4], что вынуждает авторов строить многоуровневые иерархические системы классификации. Классификация объектов с помощью нейронных сетей дает [5-11] более точные результаты, а негативный эффект роста числа классов может быть нивелирован усложнением архитектуры сети.

Цель работы – построение автоматизированной нейросетевой системы классификации примесей в исходном веществе. В качестве исходного вещества, параметры которого составили обучающую выборку, выступали спирт и спиртосодержащие жидкости с заранее известным составом примесей. Анализировались спиртовые жидкости, содержащие 11 различных примесей и воду. Таким образом, поставлена задача – разделение обучающей выборки на 12 классов веществ.

Материалы и методы

Задача классификации объектов может быть успешно решена с использованием как сверточных [8, 9], реккурентных [9], так и многослойных нейронных сетей с прямым распространением сигнала и обратным распространением ошибки [5]. Классификация сигналов, представляющих собой длинный вектор (порядка 32 000 значений), успешно может быть выполнена с помощью сверточных нейронных сетей [8]. Однако успешное обучение глубоких нейронных сетей требует наличия параллельной обработки на специальных видеокартах и практически невозможно на персональном компьютере. Многослойные персептроны напротив зарекомендовали себя как нейронные сети, не требующие больших ресурсов для создания и обучения [6].

Алгоритм обратного распространения ошибки представляет собой градиентный алгоритм обучения многослойного персептрона, основанный на минимизации среднеквадратической ошибки выходов сети. При обучении нейронной сети на вход поочередно подаются значения вектора входов p. Выходное значение нейронной сети y (расчетное значение) сравнивается с целевым t (заданное значение). Перенастройка весов W и смещений b производится для того, чтобы приблизить выходное значение a к целевому t. Цель обучения – уменьшить среднеквадратическую ошибку:

nn

E = £ У -e ( i ) = "I У ( У ( i ) — t ( i ) ) 2 .

Процесс обучения прекращается, если реализовано предельное количество циклов обучения, целевая функция достигла заданной величины либо некоторого значения и перестала уменьшаться.

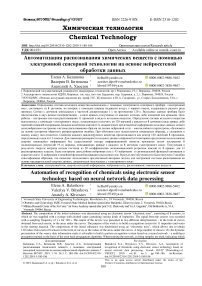

Многослойный персептрон (рисунок 1) состоит из входного слоя, образованного входными векторами, одного скрытого слоя, состоящего из k нейронов, и выходного слоя из 12 нейронов, число которых определяется числом распознаваемых классов. Количество нейронов в скрытом слое определяется экспериментально и может быть увеличено либо уменьшено в зависимости от особенностей обучающей выборки. Функции активации f , используемые в нейронах скрытых слоев, – сигмоидальные, f ( x ) = ---—, а в выходном

V / 1 + e ex слое - линейные f (x)=x .

слой

Input layer слой

Output layer слой

Hidden layer

Рисунок 1. Многослойный персептрон

Figure 1. Multilayer perceptron

Выходной сигнал j-го нейрона скрытого слоя определяется функцией активации от

( )

суммы взвешенных входов Vj = f У wl pj ,

V j = 0 )

а выход нейронной сети (сигнал выходного слоя) – функцией активации от суммы взвешенных выходов скрытого слоя

w j l + 1 ) = w 2 j ( l ) - n E- ,

Cw! j где n — коэффициент скорости обучения сети, скорость изменения ошибки:

eE ( df ( u i )

= ( У -1) T^-Vi dw2, v 7 du 2 j

k u2 = У w/v, j = 0

y = f y w ki v i

k

n

= f У wf y ww j p j

.

V i = о ) V i = о V j = 1 ))

Многослойный персептрон имеет более мощное обучающее правило – разновидность градиентного спуска. Веса перестраиваются в направлении минимума ошибки E.

Веса связей между нейронами корректируются в обратном порядке – от выхода ко входу нейронной сети, поэтому алгоритм поиска весов получил название обратного распространения ошибки. Вес w 2 связи между нейроном выходного слоя и j -м нейроном скрытого слоя корректируется согласно следующему правилу:

Ошибка на выходе скрытого слоя не имеет непосредственной связи с выходной ошибкой, так как неясно, каким должен быть эталонный выход скрытого слоя. Вес нейронов скрытого слоя корректируется в соответствии с их вкладом в величину ошибки выходного слоя. Чем больше ошибка на выходе сети и чем больше вес связи между скрытым и выходным нейроном, тем больше ошибка на выходе скрытого нейрона. Градиент ошибки относительно скрытого слоя определяется следующим образом:

d E , dfJ ( u i ) dfy ( u i )

=( У - t ) w 2 -^j p j .

о Wy dux dui

Вес w1 нейронов скрытого слоя коррек- тируется согласно следующему правилу:

Ц( I +1) = wij (l)- n .

Алгоритм обучения сети работает следующим образом.

-

1. Задаются начальные значения весов связей между нейронами на всех слоях сети.

-

2. На вход сети подается значение текущего входного вектора. Осуществляется расчет в прямом направлении значений выходных сигналов нейронов скрытого слоя и выходного слоя.

-

3. Выполняется расчет градиента ошибки выходного слоя и осуществляется коррекция весов связей между нейронами скрытого и выходного слоев.

-

4. Рассчитывается градиент ошибки скрытого слоя и осуществляется коррекция весов связей между входами сети и нейронами скрытого слоя.

-

5. Алгоритм повторяется с пункта 2. Перенастройка весов и смещений производится до тех пор, пока норма градиента не станет ниже заданного значения погрешности е , определяющего точность процесса обучения.

Совокупность входных векторов для обучения сети представляет собой 120 значений, полученных с частотой 1 с с каждого из 8 сенсоров «электронного носа» для всех 12 рассматриваемых классов веществ. Таким образом, входы нейронной сети – матрица размерностью 960x12. Количество выходных нейронов определяется количеством рассматриваемых классов – 12.

Результаты и обсуждение

Экспериментальным путем было установлено, что при таком большом числе входов максимальное количество слоев нейронной сети, доступное для обучения на персональном компьютере, – 2 с 10 нейронами на скрытом слое с сигмоидальными функциями активации и 12 нейронами с линейной функцией активации в выходном слое. Такого количества нейронов недостаточно для распознавания классов. Нейронная сеть может выделить из совокупности только один класс. Очевидно, что для построения нейронной сети с большим количеством нейронов требуется уменьшение количества входов.

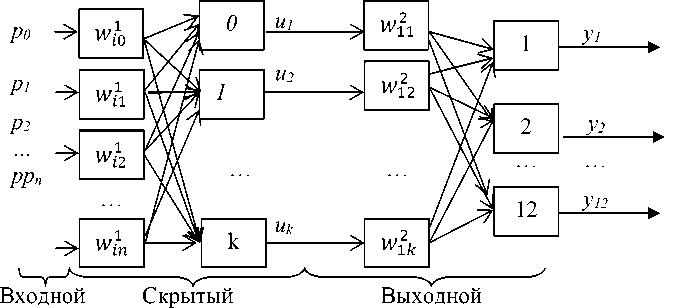

Поскольку максимальные изменения значений, полученных с большинства сенсоров, наблюдаются в первые 60 с измерений, матрица входных значений была уменьшена до 480x12. Это позволило создать и обучить нейронную сеть с 60 нейронами в скрытом слое и 12 – в выходном, однако не позволило получить надежных результатов классификации. Ряд веществ, например, ацетальдегид (рисунок 2) имеет низкую летучесть. Для их анализа «электронному носу» требуется больше времени. Указанный подход не позволяет не только классифицировать низколетучие вещества, но и не увеличивает точность классификации остальных веществ.

Рисунок 2. Показания прибора при распознавании ацетальдегида

Figure 2. Readings in the detection of acetaldehyde

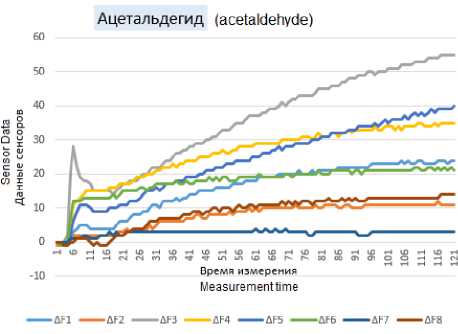

В этой связи было предложено осуществить свертку исходных данных. Одним из путей уменьшения количества входов с минимальными потерями и искажением информации является аппроксимация полученных с сенсоров кривых полиноминальными зависимостями. В качестве входов нейронной сети при этом рассматриваются коэффициенты полиномов, описывающих изменение исходных данных. Для описания исходных кривых был выбран полином 19-го порядка, результаты аппроксимации для анализа ацетальдегида представлены на рисунке 3.

Рисунок 3. Аппроксимация данных анализа ацетальдегида: а – данные третьего сенсора; б – данные шестого сенсора

Figure 3. Approximation analysis of acetaldehyde: a third sensor data; b – data of the sixth sensor

После описания исходных данных с помощью полиноминальной регрессии количество входов значительно уменьшилось до 160, что позволило обучать нейронную сеть на матрице 160 x 12. Экспериментальным путем было установлено, что для успешной классификации обучающей выборки достаточно 32 нейронов в скрытом слое и 12 – в выходном. Ошибки классификации представлены на рис. 4, откуда видно, что их значения не превышают допустимой ошибки обучения 0,001.

ЕЕ 12x12 double

Для проверки корректности работы нейронной сети было использовано 10 тестовых веществ, содержащих один или несколько контрольных образцов, используемых для обучения нейронной сети.

Для свертки исходных данных для каждого из тестовых веществ была осуществлена аппроксимация выходов каждого из 8 сенсоров полиномиальной регрессией 19-го порядка. Полученные входные данные представлены на рисунке 5.

|

1 |

2 |

3 |

4 |

5 |

6 |

7 |

8 |

9 |

10 |

11 |

12 |

|

|

1 |

1.8264е-04 |

-2.28476-04 |

-221736-04 |

5.0440е-05 |

-1.06326-04 |

-5.15796-04 |

-4.49616-04 |

1.2504е-04 |

5.7069е-04 |

-1.12636-04 |

7.0088е-06 |

-3.79786-04 |

|

2 |

-1.9041е-04 |

2.2106е-04 |

4.0006е-05 |

1.9489е-04 |

5.7803е-04 |

8.1967е-04 |

-1.92016-04 |

-3.03826-05 |

7.96816-05 |

-2.74876-05 |

-8Я330е-05 |

-3.02366-04 |

|

3 |

-2.7487е-05 |

1.82646-04 |

-8.97606-05 |

-2.54256-04 |

6.52986-04 |

1.0611е-04 |

-7.19586-04 |

1.0986е-04 |

2.9950е-05 |

2.2064е-05 |

2.59856-04 |

1.4147е-04 |

|

4 |

1.5101е-04 |

-1.03696-04 |

-3.52056-04 |

2.2064е-05 |

2.6565е-05 |

-6.28826-04 |

5.13006-05 |

-2.97866-04 |

-6.05396-04 |

5.7803е-04 |

-1.55366-04 |

6.0100е-04 |

|

5 |

1.98766-04 |

-1.24466-04 |

-4.72576-05 |

5.7803е-04 |

8.1967е-04 |

5.8895е-04 |

8.8594е-04 |

2.9950е-05 |

4.3844е-04 |

6.52986-04 |

-2.8114е-04 |

5.8895е-04 |

|

6 |

-9.55936-04 |

-1.23686-04 |

-1.12636-04 |

6.52986-04 |

1.0611е-04 |

-9.36866-05 |

1.0525е-04 |

-4.06196-05 |

3 5327е-04 |

2.6565е-05 |

3.4614е-04 |

1.53326-04 |

|

7 |

-5.59336-05 |

-1.13196-04 |

-2.74876-05 |

2.6565е-05 |

-6.28826-04 |

2.6912е-04 |

5.8895е-04 |

3.5207е-05 |

2.2662е-04 |

1.2578е-05 |

-3.93596-04 |

3.17166-04 |

|

8 |

-б.3064е-04 |

1.12386-04 |

1.5101е-04 |

-1.72566-04 |

5.7069е-04 |

-3.69316-04 |

-9.36866-05 |

1.4329е-04 |

7.8697е-05 |

-1.86296-04 |

5.9138е-05 |

-3.2660е-04 |

|

9 |

-2.49556-04 |

-2.07436-04 |

1.98766-04 |

1.12796-04 |

-2.00216-04 |

-4.06196-05 |

2.6912е-04 |

8.5035е-05 |

-1.52506-04 |

-1.13196-04 |

-2.50796-04 |

-5.30136-04 |

|

10 |

7.5720е-05 |

2.4028е-04 |

5.3614е-05 |

-3.6284е-04 |

7.4936е-04 |

3.5207е-05 |

-3.69316-04 |

7.8697е-05 |

5.8895е-04 |

1.1238е-04 |

9.1215е-05 |

-8.9263е-04 |

|

11 |

1.12386-04 |

-9.14116-05 |

-1.74336-04 |

1.2209е-04 |

7.8697е-05 |

1.4329е-04 |

-2.01546-04 |

-1.52506-04 |

2.55086-04 |

35327е-04 |

1.2578е-05 |

4.7813е-04 |

|

12 |

-2.07436-04 |

1.4688е-04 |

2.0414е-04 |

-6.88836-04 |

7.9606е-05 |

8.5035е-05 |

-6.2689е-04 |

6.91256-05 |

-5.53996-04 |

2.6565е-05 |

-1.86296-04 |

-1.83126-04 |

Рисунок 4. Матрица ошибок обучения

Figure 4. The error matrix of training

|

t МШИ» |

м:сю |

•змю |

еяие |

мен» |

• мио |

831146 |

4#Я<» |

||

|

< веемые |

|||||||||

|

мрмеыз |

1 ИС-24 |

3 455 2 4 |

4 '65-24 |

в 455-2 4 |

1268-11 |

5 4'5-24 |

7 441-14 |

1 7-48-23 |

|

|

14МММ |

-2 2’51 • |

145-11 |

-ими |

<4041 |

-> е*-44 |

Х1С-31 |

::м-и |

5*31-21 |

чин: |

|

3 Mt 1* |

• ЗИ 16 |

9 КС 14 |

• МЫ» |

в 6*С 11 |

им’.е |

2321 16 |

9 445 16 |

||

|

к змеее я |

-1 345-1? |

4 255-1? |

-5 1'5-1? |

4 2 45-1 ' |

•2 ЮС-1? |

-1525-11 |

-4 345-1? |

-6155- 1? |

-ытые |

|

измене |

» 'К-11 |

з ЯН» |

1115-11 |

103514 |

2№11 |

t азе-ii |

4135-11 |

иен* |

2$tt« |

|

омамя |

-«№11 |

^ННХ |

ЧКСИ |

-ФИН» |

<МС Я |

чина |

чме я |

<9С* Я |

•WM3 |

|

• езюм-п |

в 215-11 |

3 428 11 |

4 438-11 |

7 1'5'11 |

6525-11 |

1 248-10 |

3 11 |

7 2 35 11 |

1 <75- 22 |

|

-1 2КЗК-С* |

•3 зм<е |

•иен» |

•2 ММ» |

<:ч<е |

-4’35-10 |

-4 ММ» |

<6*54-6 |

-4 045-06 |

чине |

|

М1»№0» |

«ЫН? |

?ИК« |

• >Х<4 |

ычв» |

зМ<<6 |

з е;сч? |

• 645-06 |

к >41-07 |

• К*<’ |

|

.7 |

-4 225-0* |

; 335-2* |

• КС-2* |

-2 ЭОС |

#5 К 24 |

‘9 '35-ОС |

12*50 |

||

|

эмопие |

5 255-04 |

5 Mfr» |

СЭМ:4434 |

чемое |

: оооаазез» |

б'К-й |

6 ЭМ 464 Я? |

с :■:■;: 24з; |

|

|

-oommiw |

4 зе:431О14 |

<30044404 |

<300442114 |

-восзеами |

i00642 4tU |

<504614*64 |

<эее"1бя |

<3616: :«О6 |

<омзиеч |

|

с из !►***! |

0 И 3416142 |

ОЭО'»6422 |

в Х'4#"ЗХ |

дмз'зян |

<011013754 |

0144361154 |

вэсссеъы |

6 ИЭ4Ю144 |

0О6996И21 |

|

«5яэ»"м |

С 243*32 |

<яее*ше |

<000М?7в |

-ОММ»?»! |

2 2 6412 44?4 |

4 3 4 3645" 1 |

43ММв34» |

чашам»! |

-031356’1’1 |

|

юемяи» |

<26*Ы2М? |

<2112:1’1» |

< 3’6334114 |

tee имен |

142’414421 |

1 2666126*1 |

ему!??®: |

йзмаеазаа |

11711'1*41 |

|

-1ме^к*’ |

м:ее^5 |

мшим» |

116001141? |

■инмеие |

нгмфош |

< М-5 330*01 |

01П1161К |

•VMfWf |

1XMW6’; |

|

^ е«»;з4Х« |

5 50000'63? |

чнжй! |

7 2С43К46* |

<112164212 |

■7 К?426414 |

•2 333136* |

-L 124 2 644 Ь1 |

1 4И"13М |

1 С«*434453 |

|

<еаз»’еи: |

4 2MS4M02 |

1 415М2134 |

2 14’164 344 |

<1611141 |

a U341M1? |

:з?2’м*1 |

31044? 15?» |

041213:412 |

|

|

1Н1« |

U3H* |

UMM |

у мне |

: :м :е |

• 141-30 |

tliHt |

?«ю |

S ОМ 46 |

1ЛЖ6 |

|

Д 646 2? |

•к ЗИ 26 |

* 245-2? |

245 2? |

1 435 2 6 |

• 31-2 ? |

-1 26 |

445-2? |

< 245 26 |

-1 Ю*26 |

|

7 1'5-24 |

4 455-14 |

4 ЮС-2 4 |

? 755-2 4 |

2 0'5-14 |

7 255-14 |

4 4*5-14 |

1 '55-14 |

? Л 78-24 |

|

|

<МН8 |

-1МН4 |

<44521 |

-к«Н1 |

-4X41-31 |

ЧЯН1 |

<1X41 |

<431-41 |

<21*41 |

•4 *.ч<: |

|

1245 16 |

3535 16 |

К>*1» |

S445 11 |

3 2'5 16 |

3 245 16 |

9 • <5-26 |

|||

|

-7 J 45-17 |

-1 428-1? |

• 3 1? |

-5 6'8-1? |

6^35-1* |

-2 1? |

-6 $55-1' |

-4645-1' |

1'5-1? |

|

|

6135-Я |

iMt-u |

е<:М1 |

: мне |

ад>» |

каем* |

• аен1 |

хаен* |

1MH* |

|

|

<>ес-я |

в2МИ |

■» ин» |

4 125 11 |

кОИ-12 |

2146 11 |

<ием |

■I2М я |

6 14* Я |

м*и |

|

• 315-11 |

4255-11 |

4 ЮС-11 |

7 ЮС-11 |

13'5-11 |

* 2 ! 1 |

3 125- 11 |

4 '25-11 |

? 165-21 |

|

|

озе-ое |

3 4Х-Я |

-2 355-04 |

-2 ?:м» |

-4225-ое |

-7155Ю |

ЧЬ*1<А |

: кс-06 |

3 ’35-06 |

■еозне |

|

jmco |

кСЮ? |

• НК* |

к мн? |

LlktO? |

2 4-'1<е |

к^К-О» |

?>4«чЧ |

5 96*0? |

17* |

|

• 3 625« |

-4 458-04 |

5 -К-04 |

-3 '28 2* |

5 >СС<4 |

125-0? |

• 2 2 55-06 |

■9 265-06 |

||

|

елевыми |

аэоеаыэо? |

т нс<1 |

1125-21 |

0 202 2 4432 3 |

1 445<4 |

аэос:36416 |

4 725-05 |

5 3001130*1 |

СО001424М |

|

чемемих |

<»-.•*! М4 |

<305.4 444 |

<901901*11 |

ооемззм* |

• ’«чМ |

< Х24Ч14* |

<зое**1*; 4 |

<9041611*» |

Ч0061ГМИ |

|

: MieiMM |

::я«?»*? |

::ihhii4 |

o:ruw« |

аммаеео* |

•:oceiN«> |

сseogesee? |

6«eu»tM |

аееммеи |

ос*:4М'эс |

Рисунок 5. Свертка исходных данных для 10 тестовых веществ

Figure 5. Convolution of input data for 10 test substances

Поочередная подача на вход исходных данных позволила оценить точность классификации тестовой выборки. Из 10 веществ неверно классифицировано было лишь 1.

Заключение

-

1. Большое количество классов (12) и вид представления информации (динамические кривые), получаемой с «электронного носа», делают целесообразным построение системы распознавания образов на основе нейронной сети.

-

2. Искусственное уменьшение времени проведения анализа до 60 с не позволяет распознать тяжелолетучие компоненты, проявляющих себя на второй минуте анализа.

-

3. Для свертки имеющейся информации без существенной потери информационной емкости признаков предложено использовать полиномиальную регрессию, коэффициенты которой подаются на вход нейронной сети, что позволяет классифицировать вещества с высокой степенью точности.

Список литературы Автоматизация распознавания химических веществ с помощью электронной сенсорной технологии на основе нейросетевой обработки данных

- Omatu S., Mitsuaki Y. E-nose system by using neural networks // Neurocomputing. 2016. V. 172. P. 394-398.

- Никитина С.Ю., Кучменко Т.А., Рудаков О.Б., Дроздова Е.В. Применение методики "электронный нос" для оценки качества пищевого этанола // Вестник ВГУ. Серия: Химия. Биология. Фармация. 2015. № 1. С. 26-35.

- Проблемы аналитической химии. Том 14. Химические сенсоры: монография; под ред. Ю.Г. Власова. М.: Наука, 2011. 399 с.

- Большакова Л.В., Примакин А.И., Яковлева А.Н. Применение кластерного и дискриминантного анализов в процессе обработки и интерпретации статистических данных при обеспечении экономической и информационной безопасности хозяйствующего субъекта // Вестник Санкт-Петербургского университета МВД России. 2014. № 2 (62). С. 148-156.

- Аль-Хашеди А.А., Обади А.А., Нуриев Н.К. Разработка математического и программного обеспечения задач распознавания образов на основе персептрона // Вестник Казанского технологического университета. 2017. Т. 20. № 11. С. 85-88.

- Карпов А.С. Сравнение методов обучения нейронной сети для задачи распознавания изображений // Вестник современных исследований 2017. № 6-1 (9). С. 122-123.

- Vijayaditya P., Povey D., Khudanpur S. A time delay neural network architecture for efficient modeling of long temporal contexts // Sixteenth Annual Conference of the International Speech Communication Association. 2015.

- Dai W., Dai C., Qu S., Li J. et al. Very deep convolutional neural networks for raw waveforms // 2017 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP). IEEE, 2017.

- DOI: 10.1109/ICASSP.2017.7952190

- Sainath T.N., Vinyals O., Senior A., Sak H. Convolutional, long short-term memory, fully connected deep neural networks // 2015 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP). IEEE, 2015.

- DOI: 10.1109/ICASSP.2015.7178838

- Szulczy?ski B. et al. Determination of odour interactions in gaseous mixtures using electronic nose methods with artificial neural networks // Sensors. 2018. V. 18. № 2. P. 519.

- DOI: 10.3390/s18020519

- Jing Y.-Q., Meng Q.-H., Qi P.-F., Cao M.-L. et al. A bioinspired neural network for data processing in an electronic nose // IEEE Transactions on Instrumentation and Measurement 2016. V. 65. № 10. P. 2369-2380.

- DOI: 10.1109/TIM.2016.2578618