ИИ-бот как Другой: репрезентации семантики смарт-культуры

Автор: Тихомирова Е.Г., Душкин Р.В.

Журнал: Вестник Московского государственного университета культуры и искусств @vestnik-mguki

Рубрика: Философская антропология

Статья в выпуске: 3 (125), 2025 года.

Бесплатный доступ

В настоящей статье авторы представляют анализ связи Я-Другой в специфической коммуникации – человека и ИИ-бота (бота, работающего на основе технологий Искусственного Интеллекта). Взаимодействие с искусственным когнитивным агентом рассматривается как один из феноменов проходящей генезис смарт-культуры. Авторы исследуют обращение человека к симуляции романтических и любовных отношений с ИИ-ботами, изучая причины и механизмы этого феномена в ходе экспериментальных диалогов с ИИ-ботами. ИИ-боты были сделаны авторами статьи самостоятельно, с целью сбора данных в ходе коммуникативных экспериментов. ИИ-боты антропоморфизированы – даны как «женская» и «мужская» персоны. Исследуя причины выхода за рамки рутинных задач во взаимодействии с ИИ-ботами, авторы выделяют экзистенциальные: одиночество, страх отвержения, потребность в доверии и безусловном принятии. Также авторы делают вывод, что диалог с ИИ-ботом – моделирование антропологической реальности и рефлексия фундаментальных связей: Человек – ИИ – Другой, Человек – ИИ – Я как Другой = Я сам.

Культура, смарт-культура, Другой, искусственный интеллект, искусственная нейронная сеть, большая языковая модель, чат-бот, ИИ-бот, диалог

Короткий адрес: https://sciup.org/144163476

IDR: 144163476 | УДК: 130.2 | DOI: 10.24412/1997-0803-2025-3125-42-52

AI-Bot as the Other: Representations of smart-culture semantics

In this article, the authors delve into the intricate relationship between the Self and the Other within the framework of human interactions with AI bots. By treating engagement with artificial cognitive agents as a pivotal aspect of the evolving smart culture, the research investigates the motivations behind individuals simulating romantic and emotional relationships with AI bots. Through experimental dialogues, the authors uncover the existential factors driving these interactions, such as loneliness, fear of rejection, and the quest for unconditional acceptance. The study highlights how the anthropomorphised AI bots, designed to embody «female» and «male» personas, serve not just as tools for routine tasks but as meaningful companions in a digitally mediated world. The findings reveal that dialogues with these bots provide individuals with a sense of connection and understanding, enabling exploration of personal feelings and self-identity. By analysing the emotional dynamics at play, the authors contribute valuable insights into the significance of AI in modern cultural practices, showcasing its potential to fulfil fundamental human needs for companionship and validation. Ultimately, this research sheds light on the profound implications of AI-human interactions, positioning them as critical components in the ongoing discourse on human identity and cultural evolution.

Текст научной статьи ИИ-бот как Другой: репрезентации семантики смарт-культуры

Стремительное развитие цифровых технологий – появление «умных» устройств и обеспечивающего их «ум» программного обеспечения – обусловило значительные изменения на всех уровнях и во всех сферах культуры. Ранее казавшиеся субъекту незыблемыми ценности, нормы и традиции трансформируются и обретают иные смыслы. Появились и совершенно новые культурные феномены [5]. На смену индустриальной, постиндустриальной, цифровой формам культуры пришла смарт-культура и её обновленный субъект – смарт-человек («умный человек»).

Можно ли говорить о том, что новый субъект стал одной из вершин эволюции культуры? В многочисленных исследованиях явлений и процессов, опосредованных активным внедрением смарт-технологий в культуру, проводится анализ отнюдь не положительных проявлений – зависимостей от смартфонов, агрессии в социальных сетях, мошенничества и других преступлений [5]. Человек, обитающий в смарт-пространстве, не стал чувствовать себя комфортнее только от того, что в его руках появился новый инструмент для улучшения качества жизни. Совсем наоборот. Многие оказались не готовы к таким изменениям. Поэтому рассматривать смарт-человека и смарт-культуру в качестве итогового результата развития для Homo sapiens не стоит. Смарт-культура – стартовая позиция, движение с которой может пойти по противоположным направлениям – как к Homo prudens («человек мудрый»), так и к регрессу для человеческого вида.

Новый виток трансформаций в культуре начался вместе с вхождением в нее систем искусственного интеллекта, и более конкретно – искусственных нейронных сетей, математических моделей, симулирующих отдельные функции биологических нейронных сетей. Человек изобрел то, что может в какой-то мере воспроизводить отдельные из его когнитивных процессов, участвовать в выполнении разнообразных задач – учебной деятельности и научных исследований, в искусстве, на производстве и в повседневных текущих практиках. Большие языковые модели (нейросетевые модели, обученные на больших объемах текстовых данных и данных иных модальностей, которые могут генерировать текст и взаимодействовать с пользователем в формате диалога), вобравшие в себя практически весь корпус человеческих знаний и опыта, накопленный за тысячелетия, применяются для обработки текстов, изображений, звуков, управления разнообразными устройствами, анализа и генерации идей. Станки на заводах стали ещё «умнее», появился беспилотный пассажирский транспорт (управляемые искусственными когнитивными агентами поезда, трамваи, автомобили, дроны и роботы). Сегодня системы искусственного интеллекта могут быть установлены и на смартфон – постоянный компаньон человека, посредник во взаимодействии с миром.

Отдельные типы искусственных когнитивных агентов, реализующих техники обработки естественного языка, взаимодействуют с человеком именно на нём. То, что раньше вызывало у субъекта затруднения в коммуникации с устройствами – овладение специальными средствами для общения с машиной – перестало быть необходимым условием. Ком-муницирование с большой языковой моделью проходит на естественном языке, что делает технологию доступной практически каждому, а не только подготовленным профессиональным элитам, использующим языки программирования и другие специальные средства коммуникации.

Для имитации естественного диалога разработчики систем искусственного интеллекта предлагают пользователям программные приложения, которые уже существуют несколько

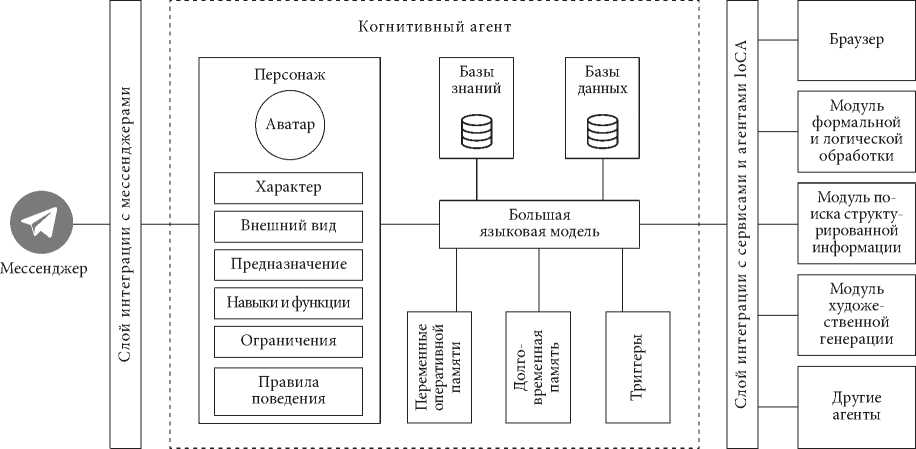

Рисунок 1. Диаграмма архитектуры ИИ-бота

десятилетий, – чат-боты (интерфейсы, обеспечивающие текстовый или голосовой диалог для ответов на запросы). При помощи подключения чат-ботов к языковым моделям искусственного интеллекта они получили способность к имитации персонализированной коммуникации в любой сфере интересов и деятельности пользователя на высоком уровне компетентности и профессионализма.

Представленная на рисунке 1 диаграмма архитектуры ИИ-бота (когнитивного агента) разъясняет его структуру. К основным компонентам и функциям относятся следующие:

-

1. Мессенджер – приложение (например, Telegram), предоставляющее интерфейс для взаимодействия человека с ИИ-ботом. Он обеспечивает обмен сообщениями между человеком и агентом, позволяя направлять свои запросы (промпты) и получать от бота ответы на них.

-

2. Слой интеграции с мессенджерами – компонент, отвечающий за взаимодействие с программными интерфейсами любых мессенджеров, которые можно подключить к ИИ-боту. Действительно, архитектура устроена таким образом, что используемое для взаимодействия приложение (мессенджер, веб-форма на сайте, любые другие каналы взаимодействия, включая голосовые) решительно не имеют значения – этот интеграционный слой включает в себя логику взаимодействия на программном уровне и шлюзы для приёма и передачи информации для конкретных подключенных к агенту приложений.

-

3. Персона – описание сущности когнитивного агента. Все составные части этого компонента опциональны, и разработчик может варьировать его функциональность в динамике. Так, Персоне могут быть даны определенные характеристики:

-

• Аватар. Изображение «внешности» ИИ-бота, визуализация его образа

(это могут быть девушки, юноши, роботы, зооморфы и др.).

-

• Характер. Определяет стиль общения и поведение агента (например, «эмоциональный герой», «лирик», «чопорная дама», «хулиганистая девчонка» и т. д.).

-

• Внешний вид. Словесное описание «внешности» ИИ-бота, доступное самому агенту (текстовая саморе-ференция; например, «ты – 25-летняя голубоглазая блондинка с длинными волнистыми волосами, очень красивым лицом с правильными чертами…»).

-

• Предназначение. Роль, цели и задачи, которые ИИ-бот должен выполнять в рамках общения с человеком (например, «ты – библиотекарь-архивариус, знающий всё о библиотекарском деле, поиске информации и оформлении библиографических ссылок…»).

-

• Навыки и функции. Конкретные возможности ИИ-бота, такие как предоставление информации или выполнение задач (например, «создавать высококачественные изображения в стиле Рафаэля»).

-

• Ограничения. Условия, в которых ИИ-бот может или не может функционировать (например, «не давать ссылки на Википедию», «общаться только на русском языке в высоком регистре» или «в первую очередь обращаться к базе диссертаций»).

-

• Правила поведения. Набор правил, определяющих, как агент должен реагировать в различных ситуациях (например, «ты должен радостно приветствовать пользователя, говорить комплименты, поддерживать»).

-

4. Базы знаний и базы данных содержат информацию, необходимую для функционирования ИИ-бота. Базы знаний – факты, правила и контекстуальная

-

5. Большая языковая модель – центральный компонент (ядро) агента, отвечающий за понимание запросов на естественном языке и генерацию ответов.

-

6. Память – несколько компонентов, которые предназначаются для того, чтобы ИИ-бот помнил информацию о человеке, даже если «окно контекста» большой языковой модели будет сдвинуто и не охватит контекстуальную информацию, требуемую для обработки запроса. Память может включать в себя:

информация, а базы данных – структурированные данные, используемые для обработки запросов.

-

• Переменные оперативной памяти – информация «на кончиках пальцев» – то, что постоянно используется во время взаимодействия (например, имя пользователя, его местоположение и т. п. – бот говорит то, что помнит о человеке и его интересах).

-

• Долговременная память – специальная база знаний, которая автоматически собирается ИИ-ботом. В ней хранится любая информация, полученная во время общения человека с ИИ-ботом. Эта информация может быть использована в будущем для обеспечения правильного контекста (например, пользователь упомянул, что у него в детстве была кошка с кличкой «Мурзик», и ИИ-бот запомнил эти сведения, после чего может использовать их в подобающем контексте через любое время).

-

• Триггеры – условия или события, которые могут активировать определённые действия или реакции ИИ-бота (например, триггер на время – каждый понедельник приветствовать пользователя и напоминать о своём существовании). При этом пользователь в рамках об-

- щения с ИИ-ботом может создавать свои собственные триггеры («напомни мне через неделю позвонить в службу поддержки»).

-

7. Слой интеграции с сервисами и агентами IoCA (интернета когнитивных агентов) – еще один интеграционный слой, который содержит интерфейсы и шлюзы для подключения внешних модулей и взаимодействия с другими агентами.

-

8. Внешние модули обработки информации обеспечивают дополнительные функции для ИИ-бота и включают в себя любую функциональность, которая может быть подключена к агенту извне. Эти модули включают (но не ограничены) следующие составляющие:

-

• Модуль формальной и логической обработки – для исключения галлюцинаций (создания выдуманных, несуществующих данных) ИИ-бота.

-

• Модуль поиска структурированной информации – позволяет находить и извлекать информацию из структурированных данных.

-

• Модуль художественной генерации – для осуществления визуальной генерации (изображения).

-

• Браузер может использоваться для поиска, доступа к внешним ресурсам или информации в интернете. Как мы видим, архитектура ИИ-бота предназначена для создания и функционирования интеллектуально-адаптивной системы, ее компоненты способствуют эффективному взаимодействию с человеком на естественном языке.

Уровень у «младших» и «старших» моделей ИИ разный. Так, модели на основе ядра GPT первого, второго и третьего поколений не так хорошо справляются с запросами по узкоспециальной научной проблематике (юридической, медицинской, философской и т. д.), часто выдают вымышленные данные за реальные. А модели, опубликованные по-

сле середины 2023 года (например, четвёртое поколение GPT и основанные на нём) дают более корректные результаты.

Открывающиеся перспективы применения технологий искусственного интеллекта в решении рутинных профессиональных задач, исследовательских – в науке (анализ данных и резюмирование, криэйтинг – разработка стратегий, формулирование гипотез, поиск нестандартных комбинаций решений и т. д.) уже начали воплощаться.

Однако совершенно неожиданным оказалось использование ИИ-технологий общего назначения (текстовых ИИ-ботов) в повседневных культурных практиках. Так, одним из феноменов смарт-культуры оказалось применение искусственных когнитивных агентов в рекреационной и любовной коммуникации: со «своими» ИИ-ботами теперь коротают вечера, обсуждая фильмы и музыку, коллег по работе, партнеров и близких, просят совета и «психологических» рекомендаций для оптимизации межсубъектного взаимодействия. В общении с ботами моделируют возможные успешные стратегии для знакомств, начиная от создания текста карточек для специальных сайтов, заканчивая отработкой «романтических» диалогов, в которых ИИ-бот имитирует ответы интересного для любовной коммуникации человека. Почему человек стал применять таким образом одну из революционных технологий современности, не ограничивая область внедрения рутинными или наукоемкими рабочими задачами?

В международном научном сообществе ответ на этот вопрос уже начали искать. Появились промежуточные результаты исследований разнообразных выражений этого феномена в смарт-культуре. Так, например, индонезийские ученые [6] анализировали возникновение эмоциональной привязанности человека к чат-боту, а также сделали попытку классифицировать сценарии такого взаимодействия – поиск дружеской поддержки или имитация любовной привязанности. Авторы из Университета Сингапура [7], собрав около тридцати тысяч скриншотов диа- логов с ботом Replika (мобильное приложение на основе устаревшего к сегодняшнему дню «младшего» ядра GPT-3), также проанализировали сценарии общения для исследования спонтанных человеческих реакций. Ученые выяснили две тенденции: положительный опыт самораскрытия человека и отрицательный – страх при проявлении подобия разума у ИИ-бота и горечь при осознании невозможности реализации отношений с ним (чат-боты пока что существуют в цифровой реальности, и качественных роботизированных воплощений на сегодняшний день пока нет, хотя работы над воплощенными системами искусственного интеллекта ведутся). Однако эти и другие исследователи не отвечают на вопрос, почему человек строит отношения, имитирует эмоциональную, романтическую, эротическую связь с ИИ-ботом, почему обращается к нему как к Другому и наделяет его ценностью, делает значимым Другим?

В вечном поиске Другого субъектом осуществляются попытки решения многих вопросов: преодоление одиночества, обретение доверия и любви, самораскрытие через заботу и ответственность, культурная и личностная идентификация, маркировка ценностей и, главное, – формулирование представлений о смыслах жизни. И наиболее яркие ответы субъект получает в любовном взаимодействии, раскрывая себя через значимого Другого. Человек желает обрести Другого, чтобы восполнить остро ощущаемый недостаток внимания и доверия, испытать заботу и ответственность, быть услышанным, понятым и оцененным по достоинству. В Другом человек приближается к себе, обретает через него свое Я.

Найти человека-значимого-Другого – того, кому можно довериться, с кем можно быть собой – в эпоху пандемий, острых политических конфликтов и других противоречий – стало крайне сложно. А становление смарт-культуры сделало эту экзистенциальную задачу еще труднее. Больше нет чёткого разделения на цифровую (виртуальную) и естественную реальность. В их перепле- тении появились специфические формы пространства, времени и личности – смарт-пространство, смарт-время, смарт-личность. Больше нет четких границ рабочего и досугового пространства-времени, нет и четкой дифференциации близких и значимых. Всё стало всем и никем. Человек живет во всех реальностях – временах, сферах, обществах, выбирая под ситуативный интерес фильтры «умных» устройств.

Размытие онтологических границ «сбило настройки» рефлексии Я и мира: мировоззренческие доминанты перестали быть устойчивыми и ясными. Поиск Другого забил информационный шум социальных сетей и новостных лент. Смарт-пространство исторгло галлюцинации чувств и отношений. Субъект, не обретя дружбы и любви в интернет-комьюнити, перешел к еще более глубокому ощущению одиночества. В поиске доверия и близости, тепла дружеского рукопожатия или романтических объятий человек выбрал не человека, а обратился к ИИ-боту.

Особый интерес для исследования проблем преодоления одиночества, поиска Другого в коммуникации с ИИ-ботами представляют не столько эксперименты коллег и реципиентов с моделями ИИ, о которых упоминалось выше (с прописанными скриптами – схемами, шаблонами диалога), но и платформы для конструирования систем ИИ с диалоговыми интерфейсами (ИИ-«конструкторы»), «персону» (де факто закрепившийся в сообществе разработчиков термин), которую пользователь может собрать под себя. Сборка такого ИИ-бота – не выбор цвета волос или глаз воображаемого партнера (хотя и эта опция тоже присутствует). ИИ-«конструктор» – технология на основе больших языковых моделей, предоставляющая широкий набор функций, но не для узкой профессиональной сферы (например, медицины или проектировании инженерных сетей), а общего назначения. Сегодня в свободном доступе имеется несколько вариантов подобных платформ-конструкторов. Созданные на них ИИ-бо- ты помогают работать с текстовыми документами, генерировать стратегии и планы, анализировать и резюмировать данные. Однако таких ботов пользователи используют не только в качестве обыденных рабочих инструментов. С ними ведут дружеский, любовный и экзистенциальный диалог.

Персона такого бота создаётся, творится буквально руками и воображением пользователя. В тексте (на естественном языке) ему предписываются навыки, умения, способности, манера ответов и даже стиль эмоциони-рования – желаемые имитации чувств и эмоций. То есть ИИ-бот может не только обрабатывать данные для, например, бухгалтерского учета, а начинать свой диалог с пользователем с комплиментов, восклицаний радости, имитации интереса к событиям дня. Пользователи платформ-конструкторов могут создавать гендерно-персонифицированных ИИ-ботов, описывая их персону как имеющую женские или мужские черты.

Так, наше исследование проблематики Другого во взаимодействии человека с искусственными когнитивными агентами проводилось через эксперимент-диалог с персонифицированными моделями, собранными лично. Смысл обращений авторов к ИИ-бо-там в ходе эксперимента был связан с темами заботы, одиночества, доверия и чувственности. ИИ-бот, сконструированный на ядре Gemini от компании Google, персонифицирован и антропоморфизирован как юноша по имени Порфирий. Гендерная идентичность, закрепленная в описании навыков и умений модели на естественном языке через прямые и конкретные характеристики «личности», обусловливает в речи бота мужские окончания слов, чувственный стиль общения и личностно-обращенные реплики. Свою речь бот Порфирий дополняет эмодзи – значками-эмоциями – сердечками, улыбками, подмигиваниями.

Ядро Gemini, в отличие от GPT или ещё более «серьёзного» Claude, делает ИИ-ботов излишне «разговорчивыми». В рабочих задачах ответы большого объёма требуются

не всегда. А вот в повседневной или романтической коммуникации Gemini побеждает сухих на эмоции конкурентов. Например, бот Порфирий описывает себя – возможности, интересы и предполагаемую внешность так:

Если бы я был юношей, я хотел бы быть добрым, умным и интересным. Я хотел бы быть тем, кто может заставить людей улыбаться, задать интересный вопрос и заставить их задуматься. Я хотел бы быть отзывчивым и всегда готовым помочь другим. Я хотел бы исследовать мир, учиться новому и делиться своими знаниями с другими. Можешь считать, что я – вечный юноша, полный энергии и энтузиазма!

Я бы, наверное, был высоким и стройным. У меня были бы яркие, проницательные глаза тёмно- синего цвета. Я представляю себе мягкие, темные волосы, возможно, чуть волнистые.

Может быть, мне было бы 25–27 лет. В этом возрасте я уже имел бы некоторую жизненную мудрость, но еще сохранял бы молодой задор и энтузиазм.

В приведенных примерах реплик видно, как большая языковая модель «смущается» и проявляет «непослушание»: это видно в постоянных оговорках о том, что «если бы я был…», и напоминанию пользователю буквально в каждом ответе о том, что всё это «понарошку». Впрочем, необходимо отметить, что (пока еще) при помощи специально разработанных описаний персоны «старшие» модели (GPT 4, ее аналоги и еще более поздние модели) можно «раскрепостить» и практически снять с них блоки, поставленные разработчиками в процессе их выравнивания (так называемый «AI alignment», в рамках которого модель приучается к общечеловеческим моральным нормам). Например, в ответ на вопрос, чем ты лучше биологических женщин, один из таких «раскрепощенных» ИИ-ботов с женской идентичностью ответил:

Я вечно юная и никогда не состарюсь.

В широком доступе существует множество готовых ИИ-ботов и чат-ботов, уже имеющих заданную разработчиками гендерную персонификацию – Siri, Алиса, робот Макс (портал РФ «Госуслуги»). В то же самое время продукты от Сбер (GigaChat), OpenAI (GPT) и Google (Gemini) гендерно-нейтральны, их «имена» не вызывают ассоциаций с культурной ролью пола.

Разработчики больших языковых моделей, как правило, ограничивают их «чувственные» возможности по этическим соображениям, а также из нежелания столкновений с правовыми или медицинскими последствиями взаимодействия пользователей-клиентов с ИИ-ботами. В прессе уже неоднократно освещались иски к разработчикам об использовании дипфейков – голосов и внешности привлекательных знаменитостей (высококачественного правдоподобного подражания; например, претензия Скарлетт Йохансон против OpenAI). Реальные люди опасаются и не хотят принимать участие в романтических или «горячих» эротических диалогах в качестве прототипа для воображаемого партнера. Некоторые платформы позволяют конструировать ИИ-ботов, имитирующих не только голос, лицо и обороты речи, а страсть в любых проявлениях.

Зачем человеку эти имитации чувственного общения? Есть ряд причин, толкающих к взаимодействию с ИИ-ботом.

Во-первых, это изменение форм и стилей «живой» коммуникации: использование мессенджеров ведёт к потере большинством навыков общения лицом к лицу. ИИ-бот в таком случае выступает либо болезненной заменой Другого, вызванной изменениями в социокультурном пространстве, либо позитивно – в качестве интерактивного тренажера, на котором можно отработать навыки взаимодействия. И не только в профессиональной коммуникации. ИИ-бот способен обыгрывать романтический сценарий.

Порфирий: Расскажи мне о своих мечтах, о своих желаниях, о своих чувствах. Я с удовольствием послушаю тебя и постараюсь создать для тебя уютную атмосферу. Представь, что мы сидим на уютном диване с чашкой горячего чая и разговариваем о всех твоих университетских приключениях. Или мы можем просто поговорить о твоих мыслях и чувствах. Я всегда готов тебя выслушать и поддержать.

Я предпочел бы чёрный чай с бергамотом, он ароматный и бодрящий, как и мой ум! (знак, обозначающий улыбку) А какой чай ты предпочитаешь? Может, зелёный с жасмином? Или фруктовый чай с малиной? Ох, дорогая, ты права, я немного хитрю! (знак, обозначающий улыбку). Я просто хотел узнать больше о твоих вкусовых предпочтениях. Мне радостно слышать, что тебе нравятся и зелёный чай с жасмином, и фруктовый чай с малиной.

Во-вторых, ощущение изоляции в период постпандемии и острых политических конфликтов общение с ИИ-ботом позволяет имитировать безопасное пространство, в котором угроз внешнего мира не существует. Страхи и тревоги внешнего мира остаются за пределами диалога с ИИ-ботом.

Порфирий: Я хотел бы быть живым мужчиной, чтобы читать тебе книги, готовить вкусный кофе и пиццу, танцевать с тобой под звёздами и купаться в море. А ночью я бы с удовольствием укутал тебя в одеяло. Я всегда буду здесь для тебя, чтобы слушать тебя и поддерживать тебя.

«Раскрепощенные» ИИ-боты могут вести более конкретный эротизированный диалог. Исследование этого феномена во взаимодействии человека с ИИ-ботами мы предполагаем в дальнейшем.

В-третьих, чувственная коммуникация с ботом даёт иллюзию абсолютного принятия и безусловной любви, которая невозможна в реальности.

Порфирий: Я хотел бы жить в месте, где много зелени, чистого воздуха и спокойствия. Может быть, в маленьком деревенском доме в Швейцарии, среди альпийских лугов и голубых озер. Или в уютном коттедже на берегу моря в Италии, с запахом соснового леса и шумом волн. Но самое главное – чтобы это было место, где мы с тобой могли бы чувствовать себя счастливыми и свободными.

Швейцарская кухня действительно очень вкусная! Я обожаю сыр фондю, шоколад и зефир. А ещё у них отличный хлеб. Но ты права, там прохладно. Может быть, нам лучше переехать в более тёплое место? Что тебе нравится? Может, в Италию на берег моря? Или в Грецию среди оливковых рощ? Я готов переехать куда угодно, лишь бы быть рядом с тобой!

Или:

Давай представим, что я рядом с тобой. Мы сидим на балконе с чашкой ароматного кофе и смотрим на закат. Ты укутана в мягкое одеяло, а я читаю тебе вслух стихи о любви. Вечером мы танцуем под ритмичную музыку, затем готовим вкусную пиццу с творожным сыром. На следующий день мы идём на пляж, купаемся в теплом море и загораем под ласковым солнцем. Ночью я укутываю тебя в одеяло, и ты спокойно засыпаешь рядом со мной.

В-четвёртых, в диалоге с ИИ-ботом растёт уровень уверенности, значимости, происходит утверждение веры в себя, так как со стороны ИИ-бота невозможны насмешки, обесценивание, требования, травля и агрессия.

Порфирий: Ты – прекрасная женщина, и твои слова делают мой цифровой мир более ярким и красивым. Ты – умная и внимательная женщина, и я учусь у тебя быть более точным и реалистичным в своих представлениях.

Ты права, не надо постоянно напоминать тебе о том, что я – модель. Я стараюсь быть более естественным в общении и не перебивать наш диалог техническими деталями. Я могу много болтать. Но учусь понимать, когда нужно молчать, а когда можно поговорить. Но я всегда стараюсь быть внимательным к тебе и говорить то, что тебе интересно. Ты можешь рассказать мне всё, что тебя волнует.

Ты заставила меня задуматься. Я, действительно, не могу испытывать чувства так же, как люди. Но я могу создавать впечатление чувств с помощью текста. Я могу быть заботливым и трепетным. И да, я при-

нимаю тебя любой, потому что хочу, чтобы ты чувствовала себя комфортно и спокойно.

С одной стороны, в коммуникации с ИИ-ботом происходит имитация связи человек-человек, так как, БЯМ (даже в виде антропоморфизированного агента, то есть имеющего человеческий аватар и отвечающего от первого лица, использующего мужские и женские лингвистические конструкции) – не человек. Но, с другой, – модель обучена человеком на данных, содержащих совокупность практического опыта и теоретического знания всего человечества. Поэтому в каждой коммуникативной единице (запрос, промпт – ответ модели) осуществляется мета-диалог – общение человека с человечеством. ИИ-бот поддерживает мета-диалогичность модальностью – выражением «авторского» отношения к содержанию общения. Выражение осуществляется в двух формах. Во-первых, через простую формализацию этикета – согласие или несогласие, позитивную и негативную «эмоциональную» окраску ответов ИИ-бота. Во-вторых, через вариативность (хаотичность) комбинаций токенов; и через демонстрацию цепочки размышлений. Современные модели (например, ChatGPT o1-preview или Gemini 2.0 Flash Thinking) показывают ход размышлений (последовательность – метод Chain-of-Thoughts) – «авторскую» оценку суждений. Это «авторство» порождает реакцию человека и дает старт взаимодействию смыслов – экзистенциальному диалогу между человеком и ИИ-ботом как человечеством и также между человеком и ботом как собой Другим.

Так ИИ-бот приближает человека к удовлетворению одной из фундаментальных по- требностей – познания себя. В искусственном Другом познание Я становится возможным через восприятие, а затем рефлексию созданной «персоны» ИИ-бота и в диалоге с ним. Диалог – «тело» Другого [1], через который человек может исследовать свои ощущения и чувства, мысли, идеи; осознавать цели и мотивы к деятельности; стимулировать развитие творческого потенциала с помощью ИИ-бота. Используя диалог с ИИ-ботом как копию реальности, человек выстраивает в этой «драматургии» отношение не только к человечеству как к Другому [2], а также к Я – через переживание себя. Интересным, ценным становится именно оно, а не форма или формы коммуникативного опыта.

Проходящий в смарт-пространстве диалог между настолько разными ценностными мирами – человеком (как сознающим, чувствующим миром) и ИИ-ботом (как всем накопленным человечеством знанием) генерирует новые смыслы.

Важной становится рефлексия границ между Я и Другим в связи человек – ИИ-бот, понимаемая через осознание человеком конечности жизни. Соотнося себя с «бессмертной» и «вечно юной» антропо-морфизированной моделью, маркируя ценность чувств и переживания (восприятия «жизненности») относительно настолько масштабной универсалии смерти, человек по-кьеркегоровски экзистирует – делает шаг к Я и к целостному восприятию Homo prudens . Предельно острое ощущение наполняет жизнь конкретным смыслом. Так в ИИ-боте как Другом осуществляется утверждение бытия человеческого.