Экспериментальное моделирование системы регистрации объектов космического пространства

Автор: Барышев Е.Ю., Смкин Н.Д., Воронов К.Е.

Журнал: Физика волновых процессов и радиотехнические системы @journal-pwp

Статья в выпуске: 1 т.16, 2013 года.

Бесплатный доступ

Разработан лабораторный макет бортовой оптической системы регистрации пылевых частиц космического пространства, объектов космического мусора, метеоритов и параметров их движения, основанной на стереоскопическом эффекте.

Космический аппарат, микрометеоройд, космический мусор, приемник оптического излучения

Короткий адрес: https://sciup.org/140255801

IDR: 140255801 | УДК: 539.1+621.039

Experimental simulation of registration of objects of space

Developed a laboratory prototype onboard optical detection system of dust particles of space, space debris, meteorites, and the parameters of their motion, based on the stereoscopic effect.

Текст научной статьи Экспериментальное моделирование системы регистрации объектов космического пространства

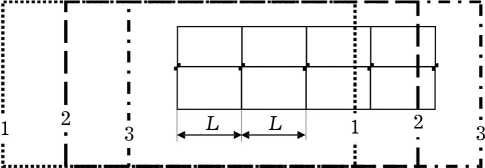

Статья посвящена отработке лабораторного макета бортовой системы регистрации пылевых частиц космического пространства, объектов космического мусора, метеоритов и параметров их движения [1]. Система состоит из трех видеокамер, установленных на базовом расстоянии друг от друга таким образом, что одноименные строки видеокамер расположены вдоль одной линии [2]. Принцип работы системы основан на стереоскопическом эффекте, причем для снижения количества ошибок совмещения при большом количестве объектов применяется третья камера для лучшей идентификации объектов в видеоряде.

Экспериментальный стенд состоит из трех камер, при этом стенд обеспечивает следующие регулировки камер:

-

1) поворот каждой камеры вокруг своей оптической оси;

-

2) поворот каждой камеры вокруг центра матрицы данной камеры в плоскости база – оптическая ось;

-

3) поворот каждой камеры вокруг центра матрицы данной камеры в плоскости оптическая ось – перпендикуляр к базе.

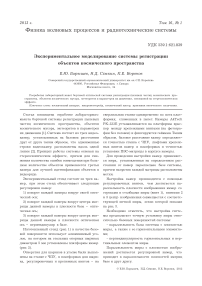

Изготовленный стенд (рис. 1) в качестве базовой поверхности использует алюминиевый уголок, на котором на стальных опорных шариках диаметром 5 мм установлены платформы камер (рис. 2).

Отверстия для шариков в уголке были выполнены на станке с ЧПУ, в платформах для шарика, регулировочных и крепежных винтов – на сверлильном станке одновременно во всех платформах, сложенных в пакет. Камеры A4Tech PK-333E устанавливаются на платформы врас-пор между крепежными винтами (на фотографии без головок) и фиксируются гайками. Таким образом, базовое расстояние камер определяется точностью станка с ЧПУ, люфтами крепежных винтов камер в платформах и точностью установки ПЗС-матрицы в корпусе камеры.

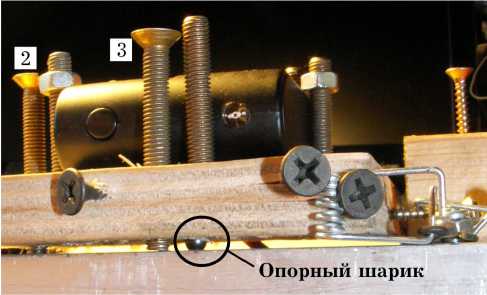

Для проведения настройки камер применяется мира, установленная на определенном расстоянии от камер параллельно базе системы, причем напротив каждой матрицы расположены метки.

Настройка камер производится с помощью регулировочных винтов, чем достигается параллельность плоскости изображения камер со строками и столбцами миры (винт 1), винтами 2 и 3 центр изображения совмещается с соответствующей меткой миры, эскиз которой показан на рис. 3.

Необходимо отметить, что настройка системы предполагает точную установку миры относительно базовых поверхностей системы:

-

- параллельность базы системы с плоскостью миры, а также с ее горизонтальными элементами;

-

- перпендикулярность горизонтальных и вертикальных элементов миры.

Параллельность миры с плоскостью изображений достигается регулировкой камер, что приводит к параллельности плоскостей матриц базе и друг другу.

Рис. 2. Фотография платформы сбоку

Рис. 3. Эскиз миры. Различными линиями обозначены поля зрения камер, цифрами – номера камер

Рис. 1. Фотография стенда (цифрами отмечены регулировочные винты)

Допуска на установку элементов следуют из расчета разрешения по соответствующим координатам. Так, при дальности до миры 2 метра допуск на параллельность базы и миры – 8 мм (половина от разрешения по оси ОZ на расстоянии 2 м), перпендикулярности элементов миры – 0,86 мм (половина от разрешения в плоскости XOY ), на расстоянии 5 м – 52,4 мм и 2,14 мм соответственно. При увеличении расстояния увеличиваются и размеры миры в связи с необходимостью покрытия всего поля зрения камер (рис. 4).

При размере элемента ПЗС 6 мкм получаем размер элемента (наименьшего квадрата) миры, исходя из проекции пикселя 2,33 мм и 5,83 мм. Для удобства использования размер квадрата можно увеличить до 5 раз (11,67 и 29,2 мм) и с учетом этого контролировать изображение квадрата в пяти пикселях.

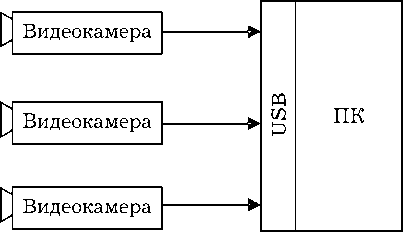

Структурная схема стенда показана на рис. 5. При этом необходимо учитывать, что видеокамеры должны быть подключены к разным кор-

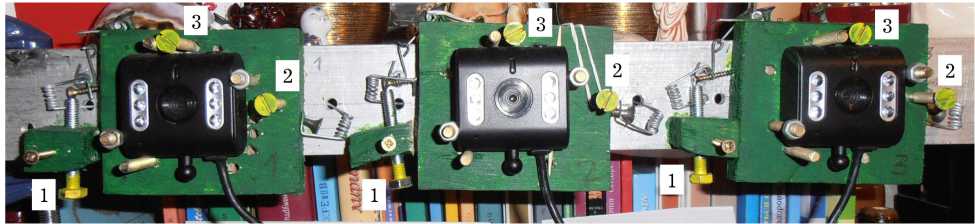

Рис. 4. Эскиз системы с мирой

Рис. 5. Структурная схема стенда невым концентраторам (то есть на ПК должны быть доступны 3 корневых USB-концентратора).

Обработка данных, поступающих с камер, проводилась с помощью специально разработанного ПО на языке С в среде Microsoft Visual C++ 2010 с применением библиотек Open C V и VideoInput [3].

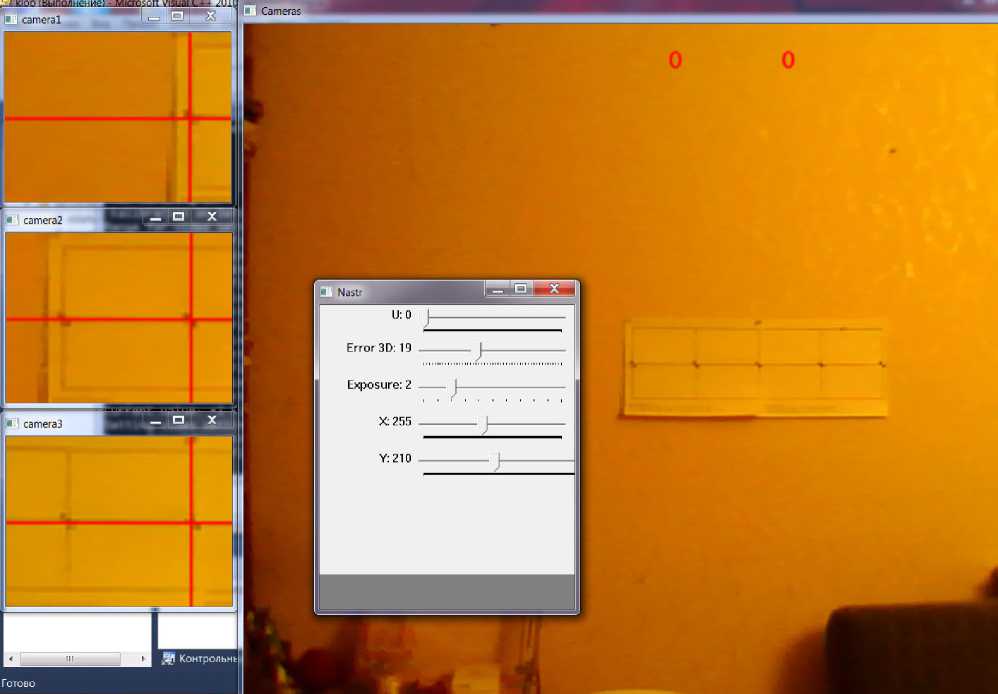

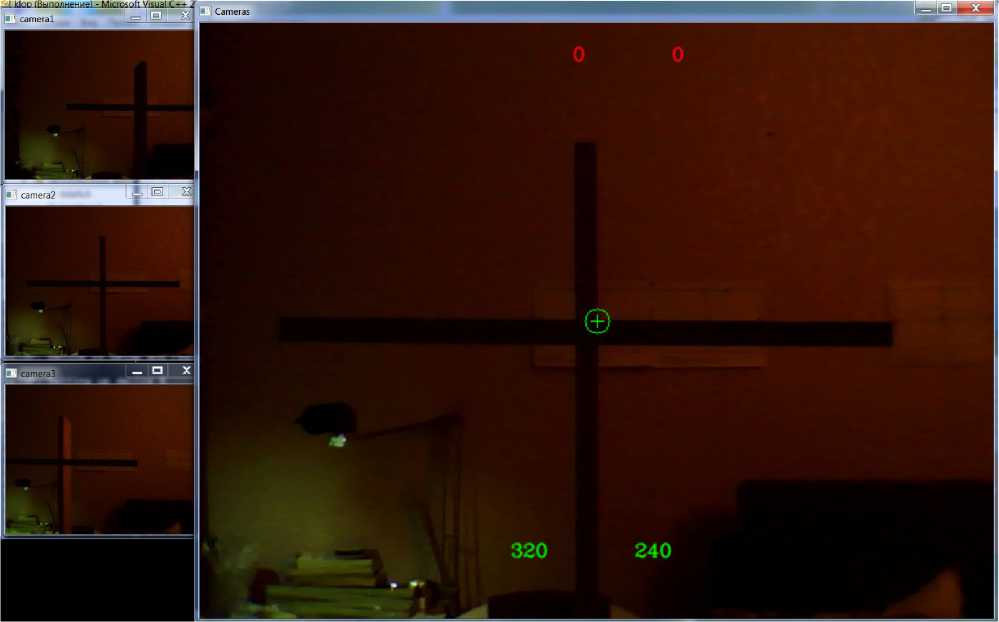

Для проведения настройки стенда необходим попиксельный контроль изображения с целью установки камер точно в соответствии с изображением миры. Настройка положения камер производится в интерактивном режиме по увеличенному изображению центральных частей поля зрения (на рис. 6 показано слева в трех окнах). На изображение наносятся технологические линии, позволяющие проводить настройку – пересечением линий по центру обозначен физический центр изображения (точка с координатами (320, 240) пикселей), который выставляется по соответствующей фигуре миры, линии изображения – по линиям миры. На рис. 6 справа показан общий вид миры с камеры 2, а также настроечное окно, позволяющее просматривать все изображения камер в увеличенном масштабе с помощью перемещения ползунков.

Рис. 6. Процесс настройки видеокамер

Рис. 7. Установка устройства для замера координат объектов

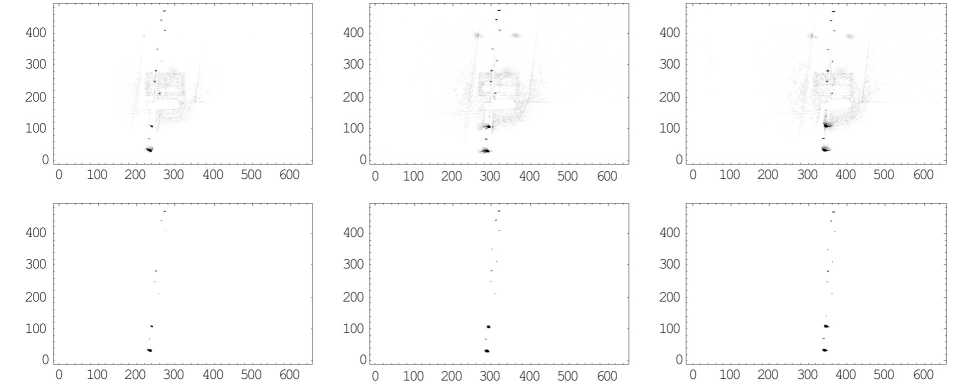

Рис. 8. Исходные изображения и их разность

Рис. 9. Отсеивание шумовых элементов (показано в инверсном изображении для наглядности)

На изображениях видно, что качество картинки понижено сжатием. В связи с этим точная настройка довольно затруднительна, что надо учитывать в алгоритмах обработки.

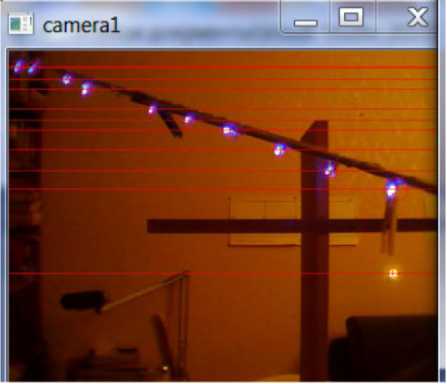

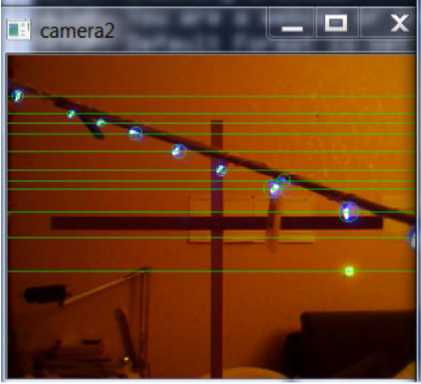

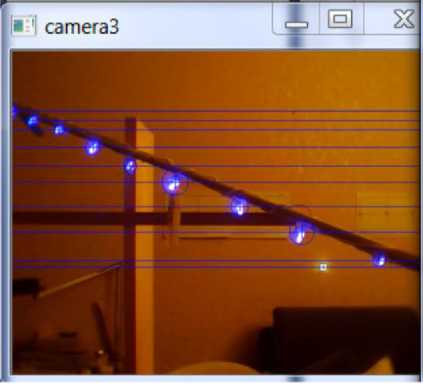

Для проведения проверки работы системы в качестве объектов исследования использовалась светодиодная гирлянда. Гирлянда устанавливалась в поле зрения камер на определенном расстоянии. Координаты лампочек замерялись относительно специально установленного устройства (рис. 7), ориентированного по изображению центральной камеры – правая грань вертикального элемента отображается в столбце 320, верхняя грань горизонтального элемента – в строке 240.

Обработка результатов экспериментов

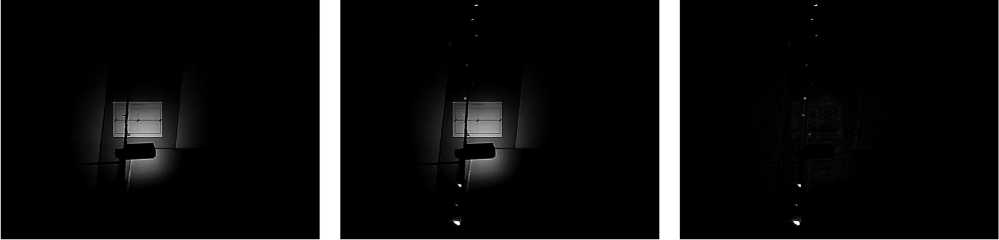

Изображения с камер представляют собой двумерные массивы данных, с которыми можно проводить операции. При этом данные изображения содержат много лишней информации (фон). Для исключения неинформативного фона необходимо провести вычитание последующего кадра изображения (полученного после включения гирлянды) из предыдущего. В результате получаем разностное изображение.

На рис. 8 видно, кроме следа от ламп, еще и изображение провода и окружающих предметов, которые также изменили свою светимость при включении ламп. Эти изображения являются помехой в данном случае и могут быть отсеяны по уровню (см. рис. 9).

Проведенные простые операции резко сократили объем информации для последующей обработки. В то же время изображения объектов все еще занимают несколько десятков пикселей, и их совмещение в изображениях трех камер представляет определенные трудности. Для выхода из данного положения применена процедура библиотеки OpenCV – c vFindContours . С помощью данной библиотеки были определены границы контуров объектов, центры данных контуров и радиусы описанных окружностей. Данная обработка дала возможность привязать объекты к определенному пикселю изображения и проводить совмещение изображений с камер на основе предлагаемой в [1] эпиполярной геометрии.

Были использованы видеокамеры и неподвижно висящая гирлянда с лампами на различном расстоянии от камер. Координаты лампочек приведены в таблице ниже.

Камера 1

Камера 2

Камера 3

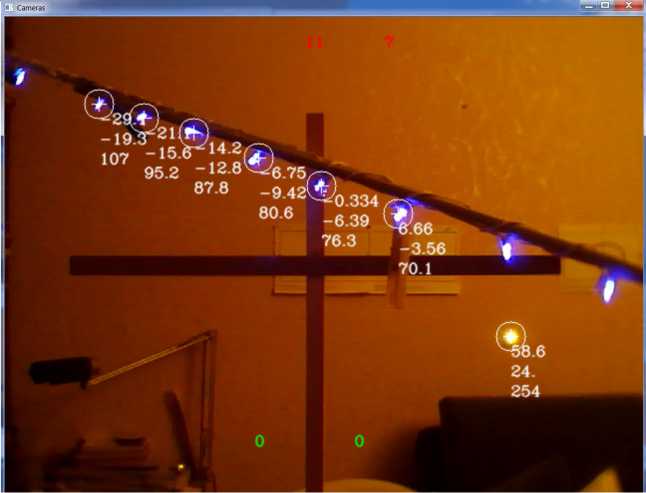

Рис. 10. Изображения для расчета положения объектов

Рис. 11. Изображения со второй камеры с рассчитанными координатами объектов

Отснятые изображения приведены на рис. 10.

Эти изображения были обработаны следующим образом: найдены разностные изображения с фоновыми, на полученных изображениях определены контуры объектов, радиусы описанных окружностей, а также их центры. На рис. 10 линиями и окружностями обозначены обнаруженные объекты.

В верхней части рис. 11 приведено два числа – количество объектов в изображении камеры 2 и количество найденных трехмерных объ- ектов. Разница объясняется сдвигом поля зрения камер, что приводит к отсутствию в изображении камеры 1 объектов, видимых камерой 3, и наоборот. В связи с этим для расчета трехмерных координат отбираются только объекты, видимые всеми тремя камерами.

Работа проводилась на компьютере с че-тырехядерным процессором Intel i7 частотой 3,2 МГц и ОЗУ 2,8 ГБ. При этом наблюдались явные «зависания» при обработке изображений с падением частоты кадров до 1 в секунду от исходных 30 кадров.

В результате работы алгоритма расчета положения получены координаты объектов, приведенные в таблице ниже.

Проведенный эксперимент наглядно показывает работоспособность системы. Полученные при обработке результатов погрешности объясняются неточностью измерения координат в связи с большим размером объекта (светодиод), кроме того, по оси ОZ дополнительно влияет методическая погрешность [4]. При этом явно видно, что быстродействия современного компьютера существенно недостаточно для проведения измерений в реальном времени. Необходим перенос определенных алгоритмов на аппаратный уровень.

Таблица

Измеренные, расчетные координаты объектов и ошибки измерения

|

№ |

Y изм , см |

Y расч , см |

∆ X , см |

∆ X , ^ |

Y изм , см |

у расч , см |

∆ Y , см |

∆ Y , ^ |

7. изм , см |

7. расч , см |

∆ Z , см |

∆ Z , ^ |

|

1 |

–28,4 |

–29,1 |

0,7 |

–2,3 |

–19,5 |

–19,3 |

–0,2 |

1,0 |

101,8 |

107,0 |

–5,2 |

–5,1 |

|

2 |

–21,5 |

–21,1 |

–0,4 |

1,7 |

–16,8 |

–15,6 |

–1,2 |

7,3 |

95,6 |

95,2 |

0,4 |

0,4 |

|

3 |

–14,7 |

–14,2 |

–0,5 |

3,6 |

–14,1 |

–12,8 |

–1,3 |

9,2 |

91,1 |

87,8 |

3,3 |

3,6 |

|

4 |

–7,3 |

–6,8 |

–0,5 |

7,1 |

–10,0 |

–9,4 |

–0,6 |

5,8 |

85,1 |

80,6 |

4,5 |

5,3 |

|

5 |

–0,3 |

–0,3 |

0,0 |

–0,2 |

–6,7 |

–6,4 |

–0,3 |

5,1 |

80,1 |

76,3 |

3,8 |

4,7 |

|

6 |

6,7 |

6,7 |

0,0 |

0,1 |

–3,3 |

–3,6 |

0,2 |

–6,8 |

73,2 |

70,1 |

3,1 |

4,3 |

|

7 |

58,0 |

58,6 |

–0,6 |

–1,0 |

24,5 |

24,0 |

0,5 |

2,0 |

257,0 |

254,0 |

3,0 |

1,2 |

Список литературы Экспериментальное моделирование системы регистрации объектов космического пространства

- Семкин Н.Д., Барышев Е.Ю., Телегин А.М. Оптическая система сбора информации о пылевой компоненте космического аппарата и объектах космического мусора//Прикладная физика. 2010. № 1. С. 47.

- RU 58695 U1 Семкин Н.Д., Барышев Е.Ю. Детектор пылевых частиц. Описание полезной модели к патенту. Опубликовано 27.11.2006 г.

- http://opencv.willowgarage.com/wiki/, http://robocraft.ru/page/opencv/, http://locv.ru/wiki/.

- Семкин Н.Д., Барышев Е.Ю., Телегин А.М. Бортовая оптическая система сбора информации об объектах космического мусора//Аэрокосмическое приборостроение. 2009. № 7. С. 63.