Параметрическая идентификация квазилинейного разностного уравнения

Бесплатный доступ

Идентификация квазилинейного разностного уравнения сводится к задаче регрессионного анализа с взаимно зависимыми наблюдаемыми переменными. Это делает неэффективными классические схемы решения, основанные на методе наименьших квадратов и его вариациях. Нахождение оценок коэффициентов уравнения авторегрессии существенно осложняется плохой обусловленностью системы уравнений, представляющих собой необходимые условия минимума суммы квадратов отклонений. При этом оценки параметров задачи оказываются несостоятельными. Для решения подобных задач возможно применение обобщённого метода наименьших модулей (ОМНМ), сводимого к решению последовательности задач оценки коэффициентов уравнения регрессии по взвешенному методу наименьших модулей (ВМНМ). В статье предложен алгоритм решения задачи ВМНМ-оценивания, на основе ее сведения к задаче линейного программирования (ЛП) простой структуры. Простота структуры допустимого множества используемой задачи ЛП: пересечение линейного подпространства с параллелепипедом, - позволяет предложить эффективный алгоритм ее решения, основанный на методе проекции градиента. Алгебраическая вычислительная сложность предложенного алгоритма не превосходит величины O(N2M2), где N - количество коэффициентов в исследуемом уравнении, M - количество наблюдаемых значений. Данная оценка вычислительной сложности ВМНМ является наилучшей из известных.

Метод наименьших модулей, модель авторегрессии, линейное программирование, метод проекции градиента, вычислительная сложность

Короткий адрес: https://sciup.org/147232828

IDR: 147232828 | УДК: 519.6 | DOI: 10.14529/mmph190404

Parametric identification of quasilinear difference equation

Identification of the quasilinear difference equation is reduced to the problem of regression analysis with mutually dependent observable variables. This makes the classical solution schemes, based on the least squares method and its variations, ineffective. Finding estimates of the autoregressive equation coefficients is significantly complicated by poor conditionality of the system of equations, which represent necessary conditions for the minimum sum of squared deviations. In this case, estimates of the problem parameters are untenable. For solving such problems, it is possible to use the generalized least absolute deviations (GLAD) method, reduced to problems sequence of estimates of the autoregressive equation coefficients with the weighted least absolute deviations (WLAD) method. The article proposes an algorithm for solving the problem of WLAD-estimation, based on its conversion to the problem of linear programming (LP) of simple structure. The simplicity of the admissible set of the LP problem structure lies in the intersection of a linear subspace with a parallelepiped. It allows to propose an effective algorithm for its solution based on the gradient projection method. The algebraic computational complexity of the proposed algorithm does not exceed the value O(N2M2), where N is the number of coefficients in the equation under study, and M is the number of the observed values. This WLAD computational complexity estimate is considered the best among the known ones.

Текст научной статьи Параметрическая идентификация квазилинейного разностного уравнения

Проблема идентификации является в настоящее время одной из основных проблем системного анализа и его приложений в различных областях [1]. При идентификации предполагается экспериментальное изучение и сопоставление входных и выходных процессов, а задача идентификации состоит в выборе соответствующей математической модели. Модель должна быть такой, что ее реакция и реакция объекта на один и тот же входной сигнал должны быть, в известном смысле, близкими. Поиск модели, как правило, ведется в параметризованных классах, полученных «на основе физических закономерностей и представлений о процессах». Одним из таких классов является класс квазилинейных разностных уравнений. В качестве примеров можно привести:

-

• модели делового цикла [2]:

Y - Y - 1 = u t + S ( Y - 1 - Y - 2 ) + v ( Y - 1 - Y - 2 ) , где Y - доход в момент времени t, ut - налоги (экзогенная переменная), v , s - параметры модели;

-

• модели оценки влияния различных факторов рыночной среды на процессы переноса (трансфера) и освоения инновационных (в том числе информационных) технологий [3]:

dy

— = u (t) + ay (t) + by , dt где y(t) - объём распространения инновации к моменту t; экзогенная функция u(t) и параметры а, b модели отражают суммарное число потенциальных потребителей инновационного продукта на рынке, степень внешних (влияние СМИ, рекламы, публикаций) и внутренних воздействий (непосредственное общение людей) на скорость адаптации;

-

• и др. [4].

Как правило, все подобные модели имеют параметры, являющиеся коэффициентами систем интегро-дифференциальных уравнений. В данном случае исходная проблема идентификации может быть сведена к задаче идентификации коэффициентов разностного уравнения, т. е. к оценке их значений по наблюдаемым возмущенным траекториям. Такой подход правомерен при наличии большого объема априорной информации об искомых параметрах и при несоответствии реальных параметров принятой модели приводит к потере сходимости алгоритма.

В данной работе показано, что идентификация квазилинейного разностного уравнения сводится к задаче регрессионного анализа с взаимно зависимыми наблюдаемыми переменными. В первом разделе задача идентификации квазилинейного уравнения представлена в виде задачи ОМНМ-оценивания [5, 6], которая в соответствии с [7] может быть решена с помощью решения последовательности задач ВМНМ-оценивания, представляющих задачи кусочно-линейного программирования. В третьем разделе подробно рассмотрена задача ВМНМ-оценивания. Показано, что ее решение сводится к задаче линейного программирования (ЛП) простой структуры. Простота структуры допустимого множества используемой задачи ЛП: пересечение линейного подпространства с параллелепипедом, – позволяет предложить эффективный алгоритм ее решения, основанный на методе проекции градиента [8, 9]. Описание алгоритма и доказательство его результативности приведено в разделе 4.

Постановка задачи

Пусть {yt е R}M_m+i - значения переменных состояния (т. е. эндогенных переменных) в моменты времени t еM . Пусть {xtрxt2,.,xtn еR}M=x - значения переменных управления (т. е. экзогенных переменных) в моменты времени t е M . Пусть g^: Rm ^ R, j = 1,2,. m - заданные функции, {^ е R}M=x - случайные ошибки. В статье рассматривается проблема определения неизвестных коэффициентов ax, а2, а3., ат е R, Ъх,Ъ2,b.,Ьп е R квазилинейной модели авторегрессии y. =Еajgj{у.-k}m=i +Zbjxtj + et, t=1»2».»M.

j=1

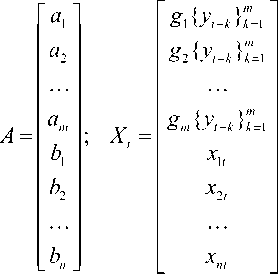

Введем новые обозначения с целью уменьшения громоздкости математических выражений

; t = 1,2, . , M ; N = n + m.

В новых терминах задача (1) примет вид yt = ATXt + 6t, t = 1,2,.,M.(2)

Наиболее известным методом определения коэффициентов уравнения регрессии является метод наименьших квадратов (МНК)

T

A= argmiN Я AX. - y.) , который является параметрическим методом, требующим выполнения ряда строгих ограничений: детерминированности переменных, независимости и нормальности распределения погрешностей измерений [10–12]. Даже незначительные нарушения этих предпосылок резко снижают эффективность оценок МНК [13, 14].

Если допустить погрешности в измеренных значениях эндогенных переменных yt, t = 1,2,.,T), то их наличие в значениях функций gy{yt_^}^=1 очевидно. Кроме того, эти ошибки будут взаимно коррелированы и иметь распределения вероятностей, отличные от нормального распределения. Это делает неэффективными классические схемы решения, основанные на методе наименьших квадратов и его вариациях.

Нахождение оценок коэффициентов уравнения авторегрессии существенно осложняется плохой обусловленностью системы уравнений, представляющих собой необходимые условия минимума суммы квадратов отклонений, при этом оценки становятся несостоятельными.

Альтернативой МНК является метод наименьших модулей (МНМ) [15, 16].

M

A = ^mn Я A T X- - у- I (4)

Возможными обобщениями МНМ являются взвешенный МНМ (ВМНМ)

А* = arg1^ Я ( P - A T X, - У - |), P - еR, - = 1,2, . M

и обобщенный МНМ (ОМНМ)

M

A=argm"in Я p(l AT X-- у-1), где р(*) - выпуклая вверх дифференцируемая функция.

Основной проблемой при применении ВМНМ является отсутствие общих формальных правил выбора весовых коэффициентов. Идентификация квазилинейного уравнения (1) авторегрессии возможна применением ОМНМ с использованием установленной связи между ОМНМ- и ВМНМ-моделями [7], позволяющей решить проблему определения ОМНМ-оценок посредством итеративной процедуры ОМНМ-оценивания с ВМНМ-оценками [5, 6].

Проблема ВМНМ оценивания

Алгоритм ВМНМ-оценивания для задачи (5) приводит к решению задачи кусочно-линейного программирования

M

Я P - A T X - - y - | ^ mill, (7)

i = 1

для заданных Xt е R N , у , pt е R, - = 1,2, . M . Задача (7) эквивалентна задаче линейного программирования

M

Ep,z, ^ min ,(8)

‘ AeRN, z■M

ATX- + z- >у-, - = 1,2,.,M,(9)

-

- AT X + z >- у, - = 1,2,., M.(10)

Двойственной задаче (8)-(10) является задача

M

Я( u- V)у- ^ max, и, ve<

M

ЯХДu- -v-) = 0, j = 1,2,.,N,(12)

i=- u- + V- = P-, i = 1,2,_, M,(13)

ut,v >0, i = 1,2,...,M.(14)

Введем переменные wt = ut - vt , - = 1,2, . , M . Из условий (13)-(14) следует

Pt + W Pt - Wt u = ----L, v = ----L, - = 1,2,.,M.

-

- 2 -2

-

- p - < w - < p - , - = 1,2, . , M .

Поэтому оптимальное значение задачи (11)-(14) равно оптимальному значению задачи

M

E w • у ^ max, w eR M

^Х^ = 0, j = 1,2,..., N , (16)

t = 1

- pt < W t < Pt , t = 1,2,..., M. (17)

Если w* является оптимальным решением задачи (15)-(17), то оптимальное решение задачи (11)-(14) равно

* P, + W* * р, - w*

-

и, = ^---- L, v, = t^ ----L, t = 1,2,..., M .

t 2 t2

Из условия комплементарности для пары взаимно двойственных задач (8)-(10) и (11)-(14) следует

(A*)T X, = у,, t: - pt < w* < p,,(18)

z;=| . °. , =c™ |w^ ^w* (yt - (A ) X), в противном случае , Фактически (A, z*) является оптимальным двойственным решением задачи (15)-(17). Повышение эффективности алгоритма ВМНМ-оценивания Известен точный алгоритм МНМ-оценивания [17]. Этот алгоритм имеет вычислительную сложность O(M2N2+ M4Nlog N + M2Nlog2N) . Кусочно-линейная форма целевой функции и простая структура допустимого множества задачи (15)-(17) дает основание полагаться на возможность ее более эффективного решения задачи. Решения таких задач, как (15)-(17), возможны с помощью алгоритма, основанного на методе проекции градиента [8, 9]. В рассматриваемом здесь случае, благодаря простоте структуры допустимого множества, вычислительная сложность алгоритма не превышает величины O(M2N2) . Алгоритм PrGrad Вход: X е RN хRM, р e(R+)M , y е RM. M Выход: w* = arg max V w. • y.. welm “ i г =1 Шаг 1. /* Инициализация*/ Шаг 1.1. k = 0 /* Счетчик итераций */ Шаг 1.2. w(0) = {и/° = 0}z=i 2м /* Координаты начальной точки */ Шаг 2. /* Текущая итерация к */ Шаг 2.1. Вычислить набор индексов ненасыщенных переменных: 5(k) = {i: - pt< w(k) < pj = 1,2,_, M}. Шаг 2.2. Вычислить подматрицы ненасыщенных переменных: X(k) = {XjV: i е 5(k), j = 1,2,_N}, y(k) = {y; i e 5(k)}. Шаг 2.3. Вычислить матрицу проектирования р(k) = e _ x(k)T^x(k) x(k)T^ 1x(k) и проекцию градиента целевой функции g(k) = P(k)y(k). Шаг 2.4. Проверить необходимое и достаточное условие максимума: если g(k) = 0, то перейти на Шаг 3. Шаг 2.5. Вычислить максимально допустимую длину шага в направлении g(k): а = argmax {а:-pt< w(k) + ag(k) <pt,ie5(k)}. a Шаг 2.6. Вычислить следующую точку (k+1) _ Л.1 k) (k) . Q(k) wi = wi + a* gi , г e 5 . Шаг 2.7. Положить k = k +1 и перейти на Шаг 2.1. Шаг 3. Завершение алгоритма: w* = w(k). Конец описания алгоритма PrGrad Теорема. Алгоритм PrGrad корректно решает проблему (15)–(17). Его вычислительная сложность не превышает величины O(M2N2). Доказательство. Каждая k-я итерация алгоритма состоит из допустимого перемещения из текущей точки w(k) в следующую точку w(k+1) (см. Шаг 2.6) в направлении проекции g(k) градиента y целевой функции (15) на пересечение множества решений системы уравнений (16) и множества решения системы активных ограничений из (17), которые могут быть определены множеством r(k) = {I: |W(K)| = pt} насыщенных переменных. Более того, если выполнено необходимое условие для экстремума, т. е. из g(k) = 0, то для всех i е R(k) выполняются условия w"k)y > 0 . Поэтому градиент у не может быть представлен как неотрицательная линейная комбинация градиентов (т. е. внутренних нормалей) активных ограничений. Поэтому в нашем случае в соответствии с теоремой Куна–Такера необходимое условие экстремума также является достаточным, и тело шага 2 будет выполнено не более чем N раз. Вычислительная сложность шагов 2.1, 2.4–2.6 не превышает величины O(M). Матрица X(k) имеет N строк и не более M столбцов. Поэтому вычислительная сложность шага 2.2 не будет превышать O (MN). Опишем более подробно оценку вычислительной сложности шага 2.3. Вычислительная сложность умножения (N х M) -матрицы на (M х N) -матрицу, т. е. вычисление матрицы в квадратных скобках, не превышает величины O(MN2). Сложность полученной обратной (N х N) -матрицы не превышает значения O(N3). Вычислительная сложность умножения (M х N) -матрицы на (N х N) -матрицу не превышает O(MN2). Вычислительная сложность умножения (M х N) -матрицы на (N х M) -матрицу также не превышает значения O(MN2). Таким образом, вычислительная сложность тела цикла не превышает O(MN2+ N3), а вычислительная сложность алгоритма не превышает O(M2N2), поскольку M > N. Теорема доказана. Заключение Идентификация квазилинейного уравнения (1) авторегрессии порядка m, имеющего n экзогенных переменных, по M отсчетам траектории возможна применением ОМНМ на основе связи между ОМНМ- и ВМНМ-моделями, позволяющей решить проблему определения ОМНМ-оценок посредством итеративной процедуры ОМНМ-оценивания с ВМНМ-оценками. При этом задача ВМНМ-оценивания представляет задачу линейного программирования, содержащую N = n + m переменных и 2M ограничений. С помощью предложенного алгоритма PrGrad данная задача решается за время не превосходящее O(M2N2).

Список литературы Параметрическая идентификация квазилинейного разностного уравнения

- Райбман, Н.С. Что такое идентификация? / Н.С. Райбман. - М.: Наука, 1970. - 119 с.

- Gabisch, G. Business Cycle Theory / G. Gabisch, H.W. Lorenz. - Springer-Verlag, 1989. - 250 p.

- Davies, S. Inter-Firm Diffusion of Process Innovations / S. Davies // European Economic Review. - 1979. - Vol. 12, Iss. 4. - P. 299-317.

- Grabec, I. Synergetics of Measurements, Prediction and Control. Springer Series in Synergetics, Book 68 / I. Grabec, W. Sachse. - Berlin-New York: Springer Verlag, 1997. - 458 p.

- Panyukov, A.V., Stable Identification of Linear Autoregressive Model with Exogenous Variables on the Basis of the Generalized Least Absolute Deviation Method / A.V.Panyukov, Y.A. Mezaal // Вестник ЮУрГУ. Серия "Математическое моделирование и програмирование". - 2018. - Т. 11, № 1. - С. 35-43.

- Panyukov, A.V. Stable Estimation of Autoregressive Model Parameters with Exogenous Variables on the Basis of the Generalized Least Absolute Deviation Method / A.V. Panyukov, Y.A. Mezaal // IFAC-PapersOnLine. - 2018. - Vol. 51, Iss. 11. - P. 1666-1669.

- Panyukov, A.V. Linkage Between Wlad and Glad and its Applications for Autoregressive Analysis / A.V. Panyukov, I.A. Tetin, Y.A. Mezaal // Proceedings of the 4th International Conference "Information Technologies for Intelligent Decision Making Support (ITIDS'2016)". - 2016. - С. 224-227.

- Мину, М. Математическое программирование. Теория и алгоритмы / М. Мину. - М.: Наука, 1990. - 485 с.

- Rosen, J.B. The Gradient Projection Method for Nonlinear Programming, part 1: linear constraints / J.B Rosen // Journal S.I.A.M. - 1960. - Vol. 8. - P. 181-217.

- Гурин, Л.С. О состоятельности оценок метода наименьших квадратов / Л.С. Гурин // Математическое обеспечение космических экспериментов: сб. науч. тр. - М.: Наука, 1978. - С. 69-81.

- Мудров, В.И. Методы обработки измерений: квазиправдоподобные оценки / В.И. Мудров, В.Л. Кушко. - М.: URSS, 2014. - 302 c.

- Shestakov, A.L. The Theory of Optimal Measurements / A.L. Shestakov, A.V. Keller, G.A. Sviridyuk // Journal of Computational and Engineering Mathematics. - 2014. - Vol. 1, № 1. - С. 3-16.

- Huber, P. Robust Statistics / P.Huber, E.M. Ronchetti. - New York, Wiley, 2009. - 354 p.

- Bloomheld, P. Least Absolute Deviations - Theory, Applications, and Algorithms / P. Bloomheld, W. Steiger. - Boston-Basel-Stuttgart: Birkhauser, 1983. - 351 p.

- Pan, J. Weighted Least Absolute Deviations Estimation for ARMA Models with Infinite Variance / J. Pan, H. Wang, Y. Qiwei // Econometric Theory. - 2007. - Vol. 23, Issue 5. - P. 852-879.

- Panyukov, A. Stable Parametric Identification of Vibratory Diagnostics Objects / A. Panyukov, A. Tyrsin // Journal of Vibroengineering. - 2008. - Vol. 10, no. 2. - P. 142-146.

- Тырсин, А.Н. Точные алгоритмы реализации метода наименьших модулей на основе спуска по узловым прямым / А.Н. Тырсин, A. Азарян // Вестник БГУ. Математика. Информатика. - 2017. - № 4. - С. 21-32.