Онтологическая модель сегментации изображений пожаров с помощью адаптивной нейро-нечѐткой сети

Автор: Бобырь М.В., Бонадаренко Б.А.

Журнал: Онтология проектирования @ontology-of-designing

Рубрика: Прикладные онтологии проектирования

Статья в выпуске: 1 (59) т.16, 2026 года.

Бесплатный доступ

Сегментация изображений пожаров является важной задачей для систем раннего обнаружения и мониторинга чрезвычайных ситуаций. Традиционные методы, такие как пороговая обработка и сложные вычислительные модели, имеют ограничения по скорости и точности в условиях реального времени. Цель исследования – обеспечение процесса сегментации изображений в режиме, близком к реальному времени. В статье представлена онтологическая модель сегментации изображений пожаров, основанная на адаптивной нейро-нечѐткой системе с оптимизированным дефаззификатором метода отношения площадей. В модели структурируются процессы обработки данных, включая преобразование изображений в цветовое пространство оттенка, насыщенности и яркости, использование треугольных функций принадлежности и адаптивную настройку параметров для выделения очагов возгорания. В онтологии систематизированы классы, процессы и их взаимосвязи, обеспечивая модульность и гибкость решения. Эксперименты на изображениях ночных пожаров с дымом показали, что предложенная модель достигает высокой точности и скорости, превосходя сравниваемые методы сегментации, и содержит потенциал для применения в системах мониторинга в реальном времени.

Онтология, нейро-нечѐткий алгоритм, сегментация изображений, дефаззификация, искусственный интеллект

Короткий адрес: https://sciup.org/170211635

IDR: 170211635 | УДК: 004.93 | DOI: 10.18287/2223-9537-2026-16-1-60-73

Ontological model for fire image segmentation using an adaptive neuro-fuzzy network

Fire image segmentation is a critical task for early detection and emergency monitoring systems. Traditional methods, such as thresholding and complex computational models, face limitations in terms of speed and accuracy under realtime conditions. The objective of this study is to enable an image segmentation process operating in near real-time. This paper presents an ontological model for fire image segmentation based on an adaptive neuro-fuzzy system with an optimized defuzzifier employing the area ratio method. The proposed model structures data processing workflows, including image transformation into the hue-saturation-brightness color space, the use of triangular membership functions, and adaptive parameter tuning for identifying fire regions. The ontology systematizes classes, processes, and their interrelationships, thereby ensuring modularity and flexibility of the solution. Experiments on images of nighttime fires with smoke showed that the proposed model achieves high accuracy and speed, outperforming the compared segmentation methods, and demonstrates potential for application in real-time monitoring systems.

Текст научной статьи Онтологическая модель сегментации изображений пожаров с помощью адаптивной нейро-нечѐткой сети

Обнаружение и локализация пожаров – важнейшие задачи в области безопасности и мониторинга окружающей среды, особенно в условиях роста числа лесных пожаров и техногенных катастроф. Пожар, как сущность, обладает нечёткими, динамичными и контекстнозависимыми свойствами и может быть смоделирована в рамках нечёткой онтологии, где границы объектов и принадлежность к классу градуальны, а не бинарны. Применяемые методы сегментации не эффективны в связи с высокой вариативностью и неопределённостью визуальных признаков пожара, а глубокие нейросети не обеспечивают интерпретируемости. Использование тепловых датчиков и визуального наблюдения [1] часто ограничено по скорости реакции и точности, особенно в сложных условиях, включая ночное время, сильный дым или горную местность [2]. Онтологии, как инструмент структурирования знаний, позволяют формализовать процессы и данные для анализа динамичных ситуаций. Разработка онтологий является трудной задачей для точной формализации сложной предметной области, при необ- ходимости адаптации к реальным условиям и нехватке стандартизированных инструментов для объединения онтологий с вычислительными системами. Это затрудняет их практическое применение в задачах мониторинга пожаров и делает актуальным продолжение исследований. Развитие методов обработки изображений позволяет автоматизировать процесс обнаружения очагов возгорания через сегментацию изображений, обеспечивая оперативное выделение зон огня даже при ограниченной видимости [3, 4].

Исследования в области локализации пожаров активно развиваются. Например, в [5] предложено применение адаптивных нейро-нечётких систем вывода ( Adaptive Neuro-Fuzzy Inference System, ANFIS ) для моделирования процессов, связанных с пожарами, что может быть использовано для анализа распространения огня с высокой точностью. В [6] представлены мультимодальные наборы данных, включая изображения пожаров, для разработки моделей сегментации. В [7] описан метод анализа пожароопасных ситуаций с использованием сложных вычислительных моделей и отмечена их высокая вычислительная сложность. В [8] показана необходимость разработки методов с минимальной зависимостью от больших объёмов данных.

Современные вычислительные модели, такие как U-Net [9] и Mask R-CNN [10], показали высокую эффективность в задачах сегментации изображений пожаров [11, 12], но их применение ограничено необходимостью значительных вычислительных ресурсов и больших объёмов размеченных данных [13]. В [14] отмечается, что такие модели требуют десятков тысяч изображений для обучения, что затрудняет их использование в условиях реального времени. В [15] предлагаются гибридные подходы на основе генетических алгоритмов для оптимизации пороговой сегментации, которые сложны в настройке.

Пороговая сегментация в цветовом пространстве – тон, насыщенность, яркость ( Hue, Saturation, Brightness, HSV ) – простой и быстрый метод [16], однако его точность снижается при наличии дыма или переменного освещения. В [17] предложен подход с динамической адаптацией порогов HSV для обнаружения огня в условиях лесных пожаров, но он уступает по точности более сложным методам. Нейро-нечёткие системы (например, ANFIS ) эффективно сочетают адаптивность и точность при меньшей зависимости от данных [18, 19].

В данной статье представлена онтологическая модель (ОМ) сегментации изображений пожаров, адаптированная для условий ночного освещения с дымом на фоне гор. Модель структурирует процессы обработки данных и включает преобразование изображений в цветовое пространство HSV , использование треугольных функций принадлежности и адаптивную настройку параметров для выделения очагов возгорания. В онтологии систематизированы классы, процессы и их взаимосвязи, обеспечивая модульность и гибкость решения. Исследования [20–24] подтверждают актуальность таких подходов для мониторинга пожаров и автоматизации анализа данных в чрезвычайных ситуациях.

1 Онтологическая модель сегментации

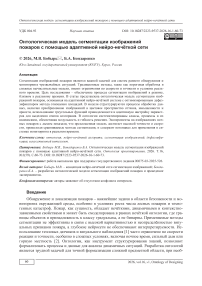

ОМ сегментации изображений (см. рисунок 1) представляет собой структурированное описание концепций, объектов, процессов и их взаимосвязей задаётся в виде кортежа:

I 7 6 9 5 1

О = ( 0с, О I, Ор, 0а к

' к = 1 а = 1 d = 1 x = V где О с - ОМ классов объектов ( с = 1... 7, где с - количество классов объектов); Оi - ОМ изображения ( i = 1... 6, где i - количество подклассов изображения); Ор - ОМ процесса (р = 1.9, где р - количество подклассов процесса); Оа - ОМ атрибутов ( а = 1... 5, где а -количество атрибутов). Данные модели описаны в таблицах 1-4.

Процесс

Изображение

является

является

Исходн. изобр.

выход

HSV-изобр.

Маска

Сегмен. изобр.

Результ. изобр.

Серое изобр.

Подклассы Изображения

Подклассы Процесса

Обновление выход состоит из

Пиксель передает значение обновляется

Вес. коэф.

передает memberships

Функция принадлеж.

сравнивает с

Целевое значение определяет границы

_____________________________________I_______________________________________

Параметры сегментации

преобразуется в

записывает mar2

выход

отображается

выход

выход

* Преобр. цвет. пространства

Создание маски

Нормализация

Бинаризация

Применение маски

Визуализация

Дефаззифика-ция

Рисунок 1 – Онтологическая модель сегментации изображений

Таблица 1 – Онтология классов модели сегментации изображений

|

№ |

Онтология классов |

||

|

Название класса |

Описание |

Взаимосвязь |

|

|

1. |

Изображение |

Представляет входные и выходные изображения, с которыми работает программа. |

Процесс, Пиксель |

|

2. |

Пиксель |

Элементарная единица изображения, характеризуется значением интенсивности (в RGB, HSV или градациях серого). |

Функция принадлежности |

|

3. |

Функция принадлежности |

Математическая модель для оценки степени принадлежности пикселя к определённой категории (например, фон или вода). |

Дефаззификация, Формула (1) |

|

4. |

Параметры сегментации |

Набор значений, определяющих границы для функций принадлежности (например, triangular_params) |

Функция принадлежности |

|

5. |

Весовой коэффициент |

Адаптивный параметр, используемый для настройки дефаз-зификации |

Дефаззификация, Обновление весов |

|

6. |

Целевое значение |

Значение (например, ytarget ), к которому стремится результат сегментации |

Обновление весов |

|

7. |

Процесс |

Операции, выполняемые программой для достижения цели сегментации |

Изображение |

Таблица 2 – Онтология класса «Изображение» модели сегментации изображений

|

№ |

Онтология изображения |

||

|

Название подкласса |

Описание |

Взаимосвязь |

|

|

1. |

Исходное изображение |

Цветное изображение, загружаемое из файла ( RGB ) |

Загрузка изображения, Преобразование цветового пространства, Создание маски, Визуализация |

|

2. |

HSV -изображение |

Преобразованное изображение в цветовом пространстве HSV |

Преобразование цветового пространства, Создание маски |

|

3. |

Маска |

Бинарное изображение, выделяющее объект (например, воду) |

Создание маски, Бинаризация, Серое изображение, Визуализация |

|

4. |

Сегментированное изображение |

Результат применения маски к исходному изображению |

Создание маски, Визуализация |

|

5. |

Серое изображение |

Промежуточное изображение в градациях серого |

Пиксель, Маска |

|

6. |

Результирующее изображение |

Выходное изображение после дефаззификации |

Нормализация, Дефаззификация, Бинаризация, Визуализация |

Таблица 3 – Онтология класса «Процесс» модели сегментации изображений

|

№ |

Онтология процессов |

||

|

Название подкласса |

Описание |

Взаимосвязь |

|

|

1. |

Загрузка изображения |

Отвечает за чтение исходного изображения из файла в память программы. Вход: путь к файлу ( image _ path ). Выход: объект OriginalImage . |

Функция Load Image |

|

2. |

Преобразование цветового про странства |

Преобразует изображение из цветового пространства RGB в HSV для упрощения анализа цветов. Вход: OriginalImage . Выход: HSVImage . |

Функция Convert |

|

3. |

Создание маски |

Создаёт начальную бинарную маску для выделения объекта (например, воды) на основе цветовых диапазонов Вход: HSVImage , границы цвета ( lower_blue, upper_blue ). Выход: Mask . |

Функция Create Mask |

|

4. |

Дефаззификация |

Преобразует нечёткие значения принадлежности пикселей в чёткие значения интенсивности Вход: список memberships, learni , границы ( ymin, ymax ). Выход: результирующее значение mar1 . |

Формула (2), функция defuzzy |

|

5. |

Обновление весов |

Адаптивно корректирует весовой коэффициент learni на основе ошибки между результатом дефаззификации и целевым значением Вход: learni, mar1, ytarget , параметры обучения ( w, t ). Выход: обновлённое значение learni . |

Формула (3) |

|

6. |

Нормализация |

Приводит значения результирующего изображения к стандартному диапазону [0, 255] Вход: ResultImage . Выход: нормализованное изображение. |

Функция Normalize |

|

7. |

Бинаризация |

Преобразует нормализованное изображение в бинарную маску с чёткими границами объекта Вход: нормализованное изображение, порог (50). Выход: BinaryMask . |

Функция Binarize |

|

8. |

Применение маски |

Выделяет сегментированную область на исходном изображении с использованием бинарной маски Вход: OriginalImage, BinaryMask . Выход: SegmentedImage . |

Функция Apply Mask |

|

9. |

Визуализация |

Отображает промежуточные и финальные результаты сегментации на экране Вход: различные изображения ( OriginalImage, ResultImage, BinaryMask, Seg-mentedImage ). Выход: отображение на экране. |

Функция Output |

Таблица 4 - Онтология атрибутов модели сегментации изображений

|

№ |

Онтология атрибутов |

||

|

Название класса |

Атрибут |

Описание |

|

|

1. |

Изображение |

path (строка) |

Путь к файлу изображения |

|

data (массив) |

данные изображения ( RGB, HSV , маска и т.д.). |

||

|

shape (кортеж) |

размеры изображения (высота, ширина, каналы). |

||

|

2. |

Пиксель |

value (число) |

интенсивность пикселя (например, в градациях серого или HSV) |

|

coordinates (кортеж) |

позиция пикселя ( i, j ) |

||

|

3. |

Функция принадлежности |

parameters (кортеж) |

границы треугольной функции ( x, y, z ) |

|

membership_value (число) |

степень принадлежности (от 0 до 1) |

||

|

4. |

Весовой коэффициент |

value (число) |

текущее значение learni |

|

min value (число) |

минимально допустимое значение (0.001) |

||

|

max value (число) |

максимально допустимое значение (10) |

||

|

5. |

Целевое значение |

value (число) |

целевая интенсивность (например, 170) |

Разработанная ОМ сегментации изображения представляет собой структурированное описание ключевых сущностей, процессов и их взаимосвязей, используемых для выделения объектов на изображении с применением нейро-нечёткого подхода. Модель включает основные классы, такие как Изображение, Пиксель, Функция принадлежности, Весовой коэффициент, Параметры сегментации, Целевое значение и Процесс , а также их подклассы, детализирующие этапы обработки данных. Процессы, такие как Загрузка изображения, Преобразование цветового пространства, Дефаззификация, Обновление весов и другие, формируют последовательный поток обработки, начиная с ввода исходного изображения и заканчивая визуализацией сегментированного результата.

Особенностью модели является её ориентация на онтологическую структуру, использующую нечёткие функции принадлежности для представления процессов сегментации изображений пожаров. Визуализация модели в виде графа упрощает анализ и модификацию ОМ.

2 Математическая модель

Работа нейро-нечёткой модели состоит из трёх шагов.

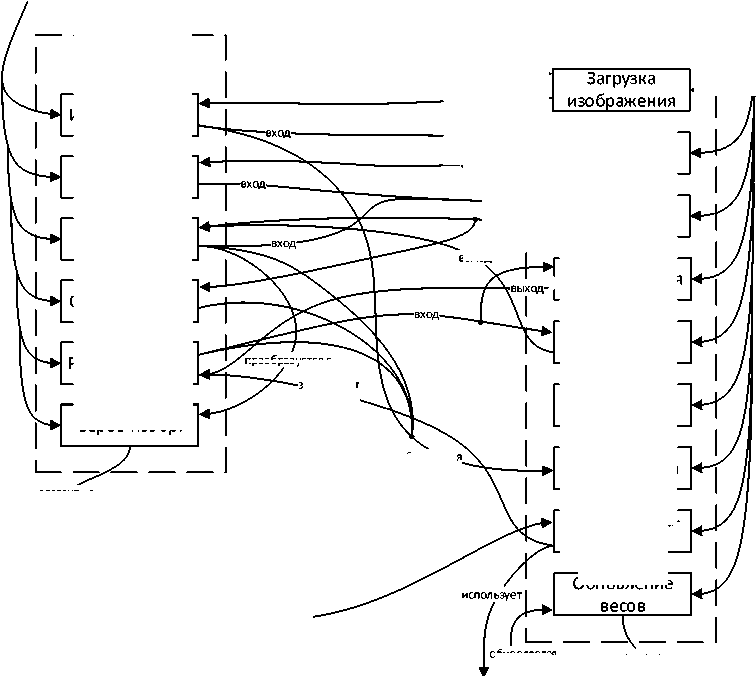

Шаг 1. Фаззификация - формирование треугольной функции принадлежности:

-

-----, если х < s < у;

Степень активации нечётких правил определяется на основе функций принадлежности. При этом max-min композиция, основанная на правилах Заде (нечёткая импликация Мамдани [25]), исключена благодаря применению модифицированного метода отношения площадей в дефаззификаторе, что повышает быстродействие предложенного нечётко-логического вывода. Значения степеней активации, соответствующие классам «Фон» и «Объект», включены в структуру дефаззификатора, что обеспечивает обработку данных без дополнительных про- межуточных этапов.

Шаг 2. Дефаззификация - определение выходного значения на основе модифицированного метода отношения площадей:

∑

MAR2 = [ трпгп ( Ym ах - Ym 1 п] I + Ymin> (3)

I II А Ltc aI IIi_|_ i где M- - значение, полученное из функций принадлежности ^(s,x,y,z), п - число выходных нечётких функций принадлежности, Lеапщ_г - весовой коэффициент (по умолчанию 1), Ymax - максимальное значение ядра, mmп - минимальное значение ядра.

Шаг 3. Процесс обучения - определение выходного значения после обучения:

Lеагщ _ х = Lеапщ + ([MAR 2 - Yarreet] х w), nntiI \MAR 2 - \ < T, (4)

где Leапщ - весовой коэффициент (значение равное Lеаппt _г с этапа дефаззификации); w -скорость обучения (по умолчанию 0.04); Т - пороговый коэффициент (по умолчанию 0.01); Ytargеt - ожидаемое выходное значение после дефаззификации.

3 Метод адаптивной нейро-нечёткой сегментации изображений

На основе ОМ разработанный метод нейро-нечёткой сегментации изображений ANFIS-OMAR (Adaptive Neuro-Fuzzy Inference System - Optimized Method Area Ratio) включает девять этапов.

Рисунок 2 - Функции принадлежности «Фон» и «Объект»

-

1) получение изображения в формате RGB ( Red, Green, Blue - красный, зелёный, синий) с оптико-электронного прибора или из базы данных, где визуальная информация фиксируется в виде трёхканального массива ( RGB ).

-

2) преобразование изображения в формат HSV для определения параметров насыщенности, что улучшает выделение цветовых диапазонов при изменении освещённости благодаря интуитивным характеристикам цвета.

-

3) создание и применение маски по заданным цветовым значениям с последующим обну-

лением или подавлением пикселей, не соответствующих цвету, что фокусирует обработ-

ку на интересующих объектах.

-

4) преобразование в градации серого с использованием взвешенного среднего значений каналов RGB , упрощающее анализ текстуры и интенсивности пикселей для подачи в не-

- чёткую систему.

-

5) фаззификация входных и выходных переменных с двумя треугольными функциями («Фон», «Объект») и выходными значениями, адаптируемыми в зависимости от условий.

-

6) дефаззификация результирующего значения, определяющая принадлежность пикселя к искомому классу на основе выходов нечёткой системы.

-

7) обучение системы, где результат сравнивается с эталонным значением, а весовые коэффициенты корректируются итерационно для повышения точности сегментации.

-

8) нормализация изображения после нечёткого вывода, приводящая значения к стандартной шкале.

-

9) формирование итогового сегментированного изображения, где маска визуализирует классификацию пикселей и пригодна для анализа, сегментации, распознавания или дальнейшей обработки.

Представленный метод адаптивной нейро-нечёткой сегментации изображений позволяет эффективно объединить нечёткие механизмы логического вывода с элементами машинного обучения.

4 Программа сегментации изображений

С целью воспроизводимости предложенного метода разработан программный код для реализации ОМ. На входе в программу поступают изображения, выходными данными являются обработанные изображения, на которых детектируемый объект выделен маской.

Алгоритм сегментации изображений пожаров с использованием модели ANFIS-OMAR , содержит следующие основные этапы.

-

1. Загрузка данных (строки 1-6): Алгоритм принимает входное изображение I в формате RGB размером 1024x720 пикселей и эталонную маску GT . Проверяется успешность загрузки файлов fire1.jpg и fire1_mask.jpg .

-

2. Преобразование в HSV (строки 7-20): Изображение преобразуется из формата RGB в цветовое пространство HSV для анализа оттенка ( H ), насыщенности ( S ) и яркости ( V ). Задаётся диапазон HSV ( lower_red = [0, 40, 70], upper_red = [50, 255, 255]), соответствующий цветам огня (красные и оранжевые оттенки). Создаётся начальная маска огня ( Mask ), где пиксели в заданном диапазоне получают значение 255, остальные – 0.

-

3. Применение маски и преобразование в градации серого (строки 21-22): Маска применяется к исходному изображению для выделения области огня ( FireRegion ), после чего изображение преобразуется в градации серого ( GrayMask ) с использованием стандартных весов (0.114, 0.587, 0.299).

-

4. Инициализация параметров (строки 23-32): Создаётся выходное изображение ResultImage размером с GrayMask , заполненное нулями. Определяются параметры модели.

-

4.1. triangular_params = [(50, 130, 255), (130, 190, 255)] – две треугольные функции принадлежности для классификации пикселей (огонь/фон).

-

4.2. Learni – массив весовых коэффициентов, изначально заполненный единицами.

-

4.3. ^target = 180 – целевая интенсивность для адаптации.

-

4.4. W = 0.004 – скорость обучения.

-

4.5. T = 0.01 – порог ошибки для обновления Learni .

-

4.6. ^min = 0, ^max = 255 – суппорт ядра выходной переменной.

-

4.7. threshold = 30 — порог для бинаризации.

-

-

5. Обработка пикселей (строки 33-47). Для каждого пикселя ( x, y ) в GrayMask .

-

5.1. Вычисляется интенсивность пикселей в маске s .

-

5.2. Определяются степени принадлежности h_1 и h_2 к двум треугольным функциям в цикле из 4 итераций.

-

5.2.1. Вычисляется дефаззифицированное значение defuzzy с использованием оптимизированного метода отношения площадей (3).

-

5.2.2. Значение ограничивается диапазоном [ ^min , ^max ].

-

5.2.3. Если ошибка между defuzzy и ^target превышает T , обновляется Learni ( x, y ) с использованием градиентного спуска (4), ограничивая его в пределах [0.001, 10].

-

5.2.4. Результат записывается в ResultImage(x, y) .

-

-

-

6. Нормализация и бинаризация (строки 48-56): ResultImage нормализуется в диапазон [0, 255] по формуле минимакс-нормализации. Затем создаётся бинарная маска BinaryMask , где пиксели с интенсивностью выше порога (30) получают значение 255, остальные – 0.

-

7. Формирование результата (строки 57-58): Бинарная маска применяется к исходному изображению для получения сегментированного изображения SegmentedImage , которое выводится как результат.

Ниже представлен псевдокод разработанной программы.

Algorithm ANFIS-OMAR Image Segmentation

Require: Image I, GroundTruth GT

Ensure: SegmentedImage

-

1. Load Image I from file "fire1.jpg"

-

2. Load GroundTruth GT from file "fire1_mask.jpg"

-

3. If I or GT is not loaded then

-

4. Output "Error loading image or mask"

-

5. Exit

-

6. End If

-

7. Convert I from BGR to HSV: H, S, V = BGR_to_HSV(I)

-

8. Define HSV range:

-

9. lower_red = [0, 40,70]

-

10. upper_red = [50, 255,255]

-

11. CreateMask:

-

12. For each pixel (x, y)do

-

13. If lower_red[0] ≤ H(x, y) ≤ upper_red[0] and

-

14. lower_red[1] ≤ S(x, y) ≤ upper_red[1]and

-

15. lower_red[2] ≤ V(x, y) ≤ upper_red[2]then

-

16. Mask(x, y) =255

-

17.Else

-

18. Mask(x, y) =0

-

19. End If

-

20. End For

-

21. Apply Mask: FireRegion = I * (Mask / 255)

-

22. Convert to grayscale: GrayMask = 0.114 * FireRegion_B + 0.587 * FireRegion_G + 0.299 * FireRegion_R

-

23. Initialize ResultImage = zeros_like(GrayMask)

-

24. Set Parameters:

-

25. triangular_params = [(50, 130, 255), (130, 190, 255)]

-

26. learni = ones_like(GrayMask)

-

27. ytarget = 180

-

28. w = 0.004

-

29. t = 0.01

-

30. ymin = 0

-

31. ymax = 255

-

32. threshold = 30

-

33. For each pixel (x, y) in GrayMask do

-

34. s = GrayMask(x, y)

-

35. h_1 = TriangularMembership(s, triangular_params[0][0], triangular_params[0][1], triangu-

- lar_params[0][2])

-

36. h_2 = TriangularMembership(s, triangular_params[1][0], triangular_params[1][1], triangu-

- lar_params[1][2])

-

37. memberships = [h_1, h_2]

-

38. For i = 1 to 6 do

-

39. defuzzy = (sum(memberships[j] * (2 - memberships[j]) for j in range(2)) / (2 * learni(x, y))) *

-

40. defuzzy = max(ymin, min(defuzzy, ymax))

-

41. If |defuzzy - ytarget| > t then

-

42. learni(x, y) = learni(x, y) + w * (ytarget - defuzzy)

-

43. learni(x, y) = max(0.001, min(learni(x, y), 10))

-

44. End If

-

45. ResultImage(x, y) = defuzzy

-

46. End For

-

47. End For

-

48. Normalize ResultImage: ResultImage = (ResultImage - min(ResultImage)) / (max(ResultImage) -

- min(ResultImage)) * 255

-

49. Binarize ResultImage:

-

50. For each pixel (x, y) do

-

51. If ResultImage(x, y) > threshold then

-

52. BinaryMask(x, y) = 255

-

53. Else

-

54. BinaryMask(x, y) = 0

-

55. End If

-

56. End For

-

57. Apply BinaryMask: SegmentedImage = I * (BinaryMask / 255)

-

58. Output SegmentedImage

(ymax - ymin) + ymin

End Algorithm

5 Экспериментальные исследования

Эксперименты проведены для оценки эффективности модели ANFIS-OMAR в задаче высокоскоростной сегментации изображений пожаров в сравнении с методами HSV и U-Net . В ходе экспериментов использовались четыре изображения формата 1024x720 пикселей, представляющие ночные пожары с дымом на фоне гор. Каждое изображение сопровождалось эталонной маской, созданной вручную для обозначения областей огня. Цель экспериментов

- определение способности методов сегментировать начинающиеся очаги возгорания при сохранении высокой скорости обработки, что важно для задач мониторинга пожаров в реальном времени. Результаты экспериментов представлены на рисунках 3-6.

а) б) в) г)

Рисунок 3 - Результаты эксперимента 1: а) оригинальное изображение, б) сегментированное моделью ANFIS-OMAR , в) сегментированное методом HSV Threshold, г) сегментированное моделью U-Net

а) б) в) г)

Рисунок 4 - Результаты эксперимента 2: а) оригинальное изображение, б) сегментированное моделью ANFIS-OMAR, в) сегментированное методом HSV Threshold, г) сегментированное моделью U-Net

а)

б)

в)

г)

Рисунок 5 - Результаты эксперимента 3: а) оригинальное изображение, б) сегментированное моделью ANFIS-OMAR, в) сегментированное методом HSV Threshold, г) сегментированное моделью U-Net

Original Image ANFIS-OMAR HSV Threshold U-Net

а) б) в) г)

Рисунок 6 - Результаты эксперимента 4: а) оригинальное изображение, б) сегментированное моделью ANFIS-OMAR, в) сегментированное методом HSV Threshold, г) сегментированное моделью U-Net

ANFIS-OMAR : Использовалась адаптивная нейро-нечёткая система вывода с оптимизированным дефаззификатором метода отношения площадей. Параметры: диапазон HSV ( lower_red = [0, 40, 70], upper_red = [50, 255, 255]), треугольные функции принадлежности ([(50, 130, 255), (130, 190, 255)]), целевая интенсивность Ytar ае t = 180, порог бинаризации 30.

HSV : Пороговая сегментация в том же диапазоне HSV ( lower_red = [0, 40, 70], upper_red = [50, 255, 255]) без дополнительной обработки.

U-Net : Упрощённая свёрточная сеть с предварительным обучением на 300 изображениях (30 эпох), входное изображение масштабировалось до 256x256, порог бинаризации 0.1.

Оценка производилась по метрикам: время выполнения ( Time, s ), среднеквадратичная ошибка ( RMSE ), коэффициент пересечения и объединения ( IoU ), коэффициент Dice и средняя абсолютная процентная ошибка ( MAPE ). Результаты представлены в таблице 5. Анализ

|

результатов показал следующее. Таблица 5 – Результаты экспериментов |

Эксперимент 1: ANFIS-OMAR показал лучшее качество сегментации ( IoU =0.3783, Dice =0.5489) по сравнению с HSV ( IoU =0.2813, Dice =0.4390), хотя MAPE остался выше (72.8% против 70.5%). U-Net показал низкую точность ( IoU =0.0004, Dice =0.0008) из-за переобучения на одном изображении. Эксперимент 2: ANFIS-OMAR сохранил преимущество по IoU (0.2243) и Dice (0.3664) над HSV (0.1306 и 0.2311), но MAPE ухудшился (69.8% против 64.8%). U-Net показал низкие результаты ( IoU =0.0002). Эксперимент 3 : ANFIS-OMAR достиг наилучших показателей ( IoU =0.4041, Dice =0.5756, MAPE =42.1099%), значительно превосходя HSV ( IoU =0.2947, Dice =0.4553, MAPE =27.7%). U-Net улучшился ( IoU =0.0663). Эксперимент 4: ANFIS-OMAR и HSV показали схожие низкие результаты ( IoU=0 .07– |

|||||

|

Time, s |

RMSE |

IoU |

Dice MAPE |

|||

|

Эксперимент 1 |

||||||

|

ANFIS-OMAR |

0.1466 |

0.8877 |

0.3783 |

0.5489 |

72.8 |

|

|

HSV |

0.0020 |

0.8978 |

0.2813 |

0.4390 |

70.5 |

|

|

U-Net |

2.4721 |

2.2161 |

0.0004 |

0.0008 |

142.6 |

|

|

Эксперимент 2 |

||||||

|

ANFIS-OMAR |

0.1576 |

0.9699 |

0.2243 |

0.3664 |

69.8 |

|

|

HSV |

0.0020 |

1.0564 |

0.1306 |

0.2311 |

64.8 |

|

|

U-Net |

2.3706 |

2.0598 |

0.0002 |

0.0004 |

158.6 |

|

|

Эксперимент 3 |

||||||

|

ANFIS-OMAR |

0.1596 |

0.7448 |

0.4041 |

0.5756 |

42.1 |

|

|

HSV |

0.0030 |

0.7873 |

0.2947 |

0.4553 |

27.7 |

|

|

U-Net |

2.3321 |

1.8794 |

0.0663 |

0.1243 |

67.1 |

|

|

Эксперимент 4 |

||||||

|

ANFIS-OMAR |

0.1359 |

0.7464 |

0.0781 |

0.1448 |

50.1 |

|

|

HSV |

0.0020 |

0.7381 |

0.0756 |

0.1406 |

54.8 |

|

|

U-Net |

2.3563 |

1.6388 |

0.0086 |

0.0171 |

135.5 |

|

|

мера очага. U-Net – неэффективен ( IoU =0.0086). |

0.08, Dice=0 .14), вероятно из-за малого раз- |

|||||

ANFIS-OMAR различал огонь и фон (дым, горы), минимизируя ложноположительные пиксели, в отличие от HSV , который чаще включал дым, и от U-Net , который переобучался. Время выполнения ANFIS-OMAR (~0.14–0.16 с) значительно ниже U-Net (~2.3–2.5 с), но больше HSV (~0.002–0.003 с). Это подтверждает пригодность ANFIS-OMAR для реального времени.

Заключение

Исследование показало эффективность ОМ сегментации изображений пожаров на основе ANFIS-OMAR в условиях ночного освещения с дымом на фоне гор. В разработанной ОМ систематизированы ключевые сущности, процессы и их взаимосвязи, включая преобразование изображений в цветовое пространство оттенка, насыщенности и яркости, использование треугольных функций принадлежности и адаптивную настройку параметров с оптимизированным дефаззификатором метода отношения площадей. Модель структурирует процессы обработки данных для выделения очагов возгорания. Эксперименты на четырёх изображениях формата 1024x720 подтвердили, что ANFIS-OMAR превосходит методы HSV и U-Net по ключевым метрикам ( IoU и Dice ), особенно в сложных условиях с переменной интенсивностью огня и дымом. HSV быстрее (~0.002 с), но уступает по точности ( IoU до 0.2947), а U-Net (~2.3 с) демонстрирует низкую эффективность ( IoU до 0.0663) из-за ограниченного обучения.

Малое время обработки ANFIS-OMAR (0.14-0.16 с.) делает модель пригодной для мониторинга пожаров в реальном времени. Онтологический подход, лежащий в основе ANFIS-OMAR , обеспечивает чёткое описание классов, процессов и атрибутов, упрощая анализ и модификацию алгоритма.